优云智算镜像社区 - 海量AI模型一键部署

默认排序

视频生成

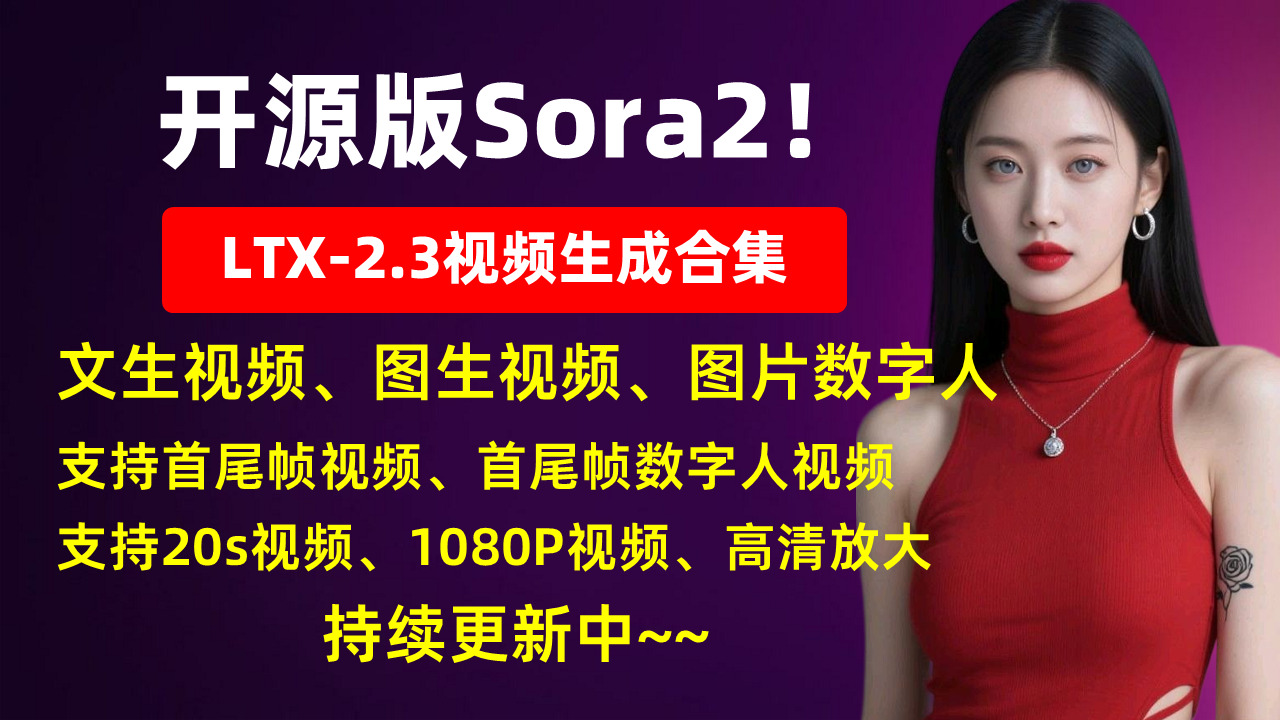

LTX-2.3视频生成合集!支持文生视频、图生视频、数字人视频等

141

141@与AI同行

认证作者

认证作者 2095

2095 4428H

4428H更新时间:2026-03-31

支持自启动

支持自启动开源版Sora2发布,LTX-2.3整合包合集,支持文生视频、图生视频、数字人!支持20s视频、1080P视频直出、批量队列生成、高清放大!

开源版Sora2发布,LTX-2.3整合包合集,支持文生视频、图生视频、数字人!支持20s视频、1080P视频直出、批量队列生成、高清放大!

数字人

LiveTalking

98

98@lipku

认证作者

认证作者 3844

3844 70113H

70113H更新时间:2026-04-13

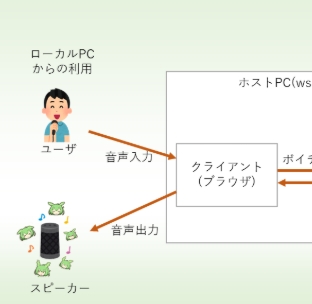

LiveTalking镜像提供实时交互数字人解决方案,支持ERNerf、MuseTalk、Wav2Lip,实现单张人脸照片驱动的超低延迟(<100ms)唇形同步、表情及头部运动控制。

LiveTalking镜像提供实时交互数字人解决方案,支持ERNerf、MuseTalk、Wav2Lip,实现单张人脸照片驱动的超低延迟(<100ms)唇形同步、表情及头部运动控制。

数字人

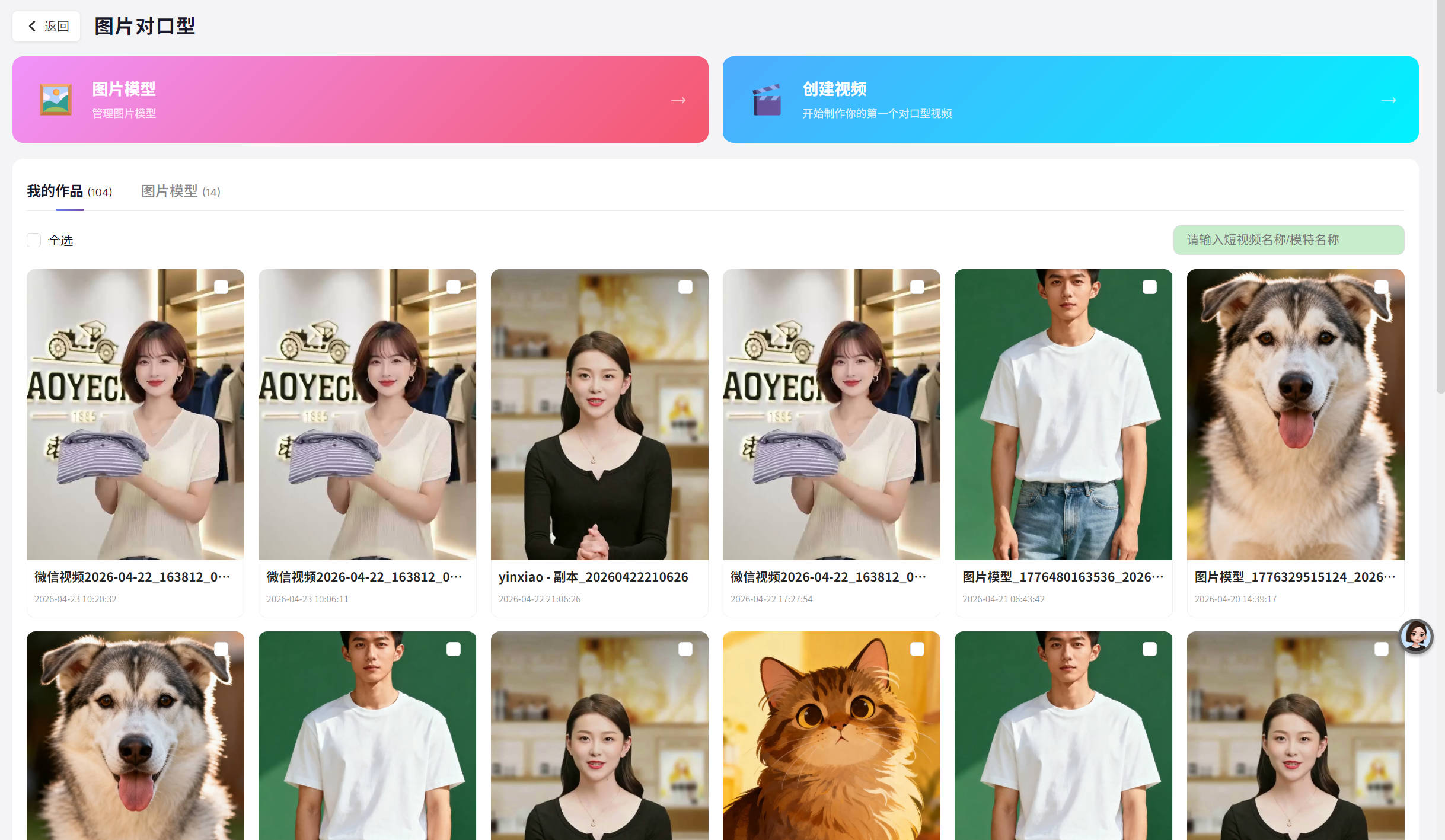

最强AI数字人InfiniteTalk-图片和视频数字人

537

537@与AI同行

认证作者

认证作者 12003

12003 81500H

81500H更新时间:2026-03-31

支持自启动

支持自启动支持图片数字人、视频数字人、双人数字人,支持说话+唱歌对口型、长视频、完整歌曲生成、批量生成、高清放大!

支持图片数字人、视频数字人、双人数字人,支持说话+唱歌对口型、长视频、完整歌曲生成、批量生成、高清放大!

语音合成语音克隆

SVC-Fusion

104

104@aiguoliuguo

认证作者

认证作者 6478

6478 36404H

36404H更新时间:2026-02-27

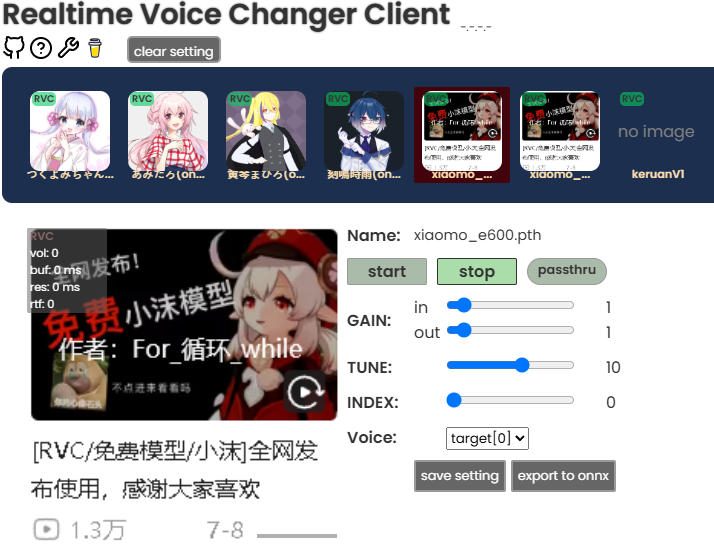

本整合包将整合So-Vits-SVC4.1、DDSP-SVC-6.3/6.1/6.0、ReFlow-VAE-SVC多种SVC模型训练及推理

本整合包将整合So-Vits-SVC4.1、DDSP-SVC-6.3/6.1/6.0、ReFlow-VAE-SVC多种SVC模型训练及推理

AI漫剧Lora训练AI电商

20260506_aitoolkit全能lora模型训练王

0

0@老徐Ai研习社

认证作者

认证作者 0

0 0H

0H更新时间:2026-05-06

支持自启动

支持自启动aitoolkit全能lora模型训练王

aitoolkit全能lora模型训练王

ComfyUILTX视频生成

Sulphur& 10Eros ltx2.3视频生产解锁镜像

0

0@AI-KSK

认证作者

认证作者 3

3 1H

1H更新时间:2026-05-06

支持自启动

支持自启动Sulphur-10Eros-LTX2.3 解锁视频生产镜像,基于 ComfyUI 搭建,内置 Sulphur Distill BF16、10Eros BF16,支持官方工作流和高自由度私域视频创作。

Sulphur-10Eros-LTX2.3 解锁视频生产镜像,基于 ComfyUI 搭建,内置 Sulphur Distill BF16、10Eros BF16,支持官方工作流和高自由度私域视频创作。

ComfyUILTX视频生成

LTX-2.3-10Eros-图生视频-文生视频-多人对话-单人数字人,8G显存可用,自动补帧,支持50系,自定义分辨率,自适应端口,自动提示词,批量任务队列

0

0@刘悦的技术博客

认证作者

认证作者 7

7 5H

5H更新时间:2026-05-06

支持自启动

支持自启动LTX-2.3-10Eros-图生视频-文生视频-多人对话-单人数字人,8G显存可用,自动补帧,支持50系,自定义分辨率,自适应端口,自动提示词,批量任务队列

LTX-2.3-10Eros-图生视频-文生视频-多人对话-单人数字人,8G显存可用,自动补帧,支持50系,自定义分辨率,自适应端口,自动提示词,批量任务队列

ComfyUI图片生成图片编辑

Pmaster-v3.5-Turbo,文生图,图生图,洗图,6G显存可用,4k超分,局部重绘,自动提示词,支持50系,批量任务队列

0

0@刘悦的技术博客

认证作者

认证作者 2

2 0H

0H更新时间:2026-05-06

支持自启动

支持自启动Pmaster-v3.5-Turbo,文生图,图生图,洗图,6G显存可用,4k超分,局部重绘,自动提示词,支持50系,批量任务队列

Pmaster-v3.5-Turbo,文生图,图生图,洗图,6G显存可用,4k超分,局部重绘,自动提示词,支持50系,批量任务队列

ComfyUI图片生成视频生成

sd2-fast在线使用sedance2.0-fast无须排队高并发api企业框架接口视频生成

3

3@鸡你太美

认证作者

认证作者 5

5 6H

6H更新时间:2026-05-07

支持自启动

支持自启动sd2.0-fast企业框架接口免排队在线使用含gpt-image2,veo,grok视频在线生成等

sd2.0-fast企业框架接口免排队在线使用含gpt-image2,veo,grok视频在线生成等

语音合成IndexTTSQwen3-TTS

声音克隆OmniVoice——600+语言音色克隆 - 音色设计 - 多语言语音生成

1

1@星尘小赵

4

4 4H

4H更新时间:2026-05-06

支持自启动

支持自启动支持600+语言音色克隆 - 音色设计 - 多语言语音生成

支持600+语言音色克隆 - 音色设计 - 多语言语音生成

数字人LTX视频生成

LTX-2.3-22B-DISTILLED-1.1-VBVR-文生视频-首尾帧,单图无限时长,自动补帧,支持50系,自定义分辨率,自适应端口,自动提示词,批量任务队列

13

13@刘悦的技术博客

认证作者

认证作者 110

110 117H

117H更新时间:2026-05-04

支持自启动

支持自启动LTX-2.3-22B-DISTILLED-1.1-VBVR-文生视频-首尾帧,单图无限时长,自动补帧,支持50系,自定义分辨率,自适应端口,自动提示词,批量任务队列

LTX-2.3-22B-DISTILLED-1.1-VBVR-文生视频-首尾帧,单图无限时长,自动补帧,支持50系,自定义分辨率,自适应端口,自动提示词,批量任务队列

数字人ComfyUILTX

LTX-2.3-22B-DISTILLED-1.1-VBVR-图片数字人-自动补帧,支持50系,自定义分辨率,自适应端口,自动提示词

9

9@刘悦的技术博客

认证作者

认证作者 70

70 81H

81H更新时间:2026-05-04

支持自启动

支持自启动LTX-2.3-22B-DISTILLED-1.1-VBVR-图片数字人-自动补帧,支持50系,自定义分辨率,自适应端口,自动提示词

LTX-2.3-22B-DISTILLED-1.1-VBVR-图片数字人-自动补帧,支持50系,自定义分辨率,自适应端口,自动提示词

LTXComfyUI视频生成

LTX-2.3-DISTILLED-1.1-多人对话-男女对唱-图片数字人,8G显存可用,自动补帧,支持50系,自定义分辨率,自适应端口,自动提示词,批量任务队列

5

5@刘悦的技术博客

认证作者

认证作者 41

41 51H

51H更新时间:2026-05-04

支持自启动

支持自启动LTX-2.3-DISTILLED-1.1-多人对话-男女对唱-图片数字人,8G显存可用,自动补帧,支持50系,自定义分辨率,自适应端口,自动提示词,批量任务队列

LTX-2.3-DISTILLED-1.1-多人对话-男女对唱-图片数字人,8G显存可用,自动补帧,支持50系,自定义分辨率,自适应端口,自动提示词,批量任务队列

AI漫剧数字人ComfyUI

202604全新ComfyUI整合包,主流模型都有,附带40个实用工作流,体积不到100G

25

25@老徐Ai研习社

认证作者

认证作者 277

277 924H

924H更新时间:2026-05-04

支持自启动

支持自启动ComfyUI整合包20260424

ComfyUI整合包20260424

图片生成ComfyUI

RedMix-Ernie-Image,4k超分,文生图,图生图,自动提示词,批量任务

3

3@刘悦的技术博客

认证作者

认证作者 25

25 12H

12H更新时间:2026-05-02

支持自启动

支持自启动RedMix-Ernie-Image,4k超分,文生图,图生图,自动提示词,批量任务

RedMix-Ernie-Image,4k超分,文生图,图生图,自动提示词,批量任务

LTX视频生成视频编辑

LTX-2.3-DISTILLED-1.1-视频编辑-视频内容修改

5

5@刘悦的技术博客

认证作者

认证作者 23

23 46H

46H更新时间:2026-04-30

支持自启动

支持自启动LTX-2.3-DISTILLED-1.1-视频编辑-视频内容修改

LTX-2.3-DISTILLED-1.1-视频编辑-视频内容修改

语音合成

超强AI语音克隆,VOXCPM-V2合集,语音克隆 | 音色保存 | 多音字 | 批量生成 | 超长文本生成

9

9@与AI同行

认证作者

认证作者 41

41 20H

20H更新时间:2026-04-30

支持自启动

支持自启动超强AI语音克隆,VOXCPM-V2合集,语音克隆 | 音色保存 | 多音字 | 批量生成 | 超长文本生成

超强AI语音克隆,VOXCPM-V2合集,语音克隆 | 音色保存 | 多音字 | 批量生成 | 超长文本生成

其他

sora2文生视频、图生视频工作流

83

83@鸡你太美

认证作者

认证作者 175

175 614H

614H更新时间:2026-05-07

支持自启动

支持自启动增加GPT-image2图片2k4k和gork30秒延长工作流

增加GPT-image2图片2k4k和gork30秒延长工作流

SVC

SVC-Fusion_api_rvc

0

0@杭州

35

35 9H

9H更新时间:2026-04-29

支持自启动

支持自启动支持了rvc模型算法的SVC-Fusion_api

支持了rvc模型算法的SVC-Fusion_api

ComfyUIFlux图片生成

Flux2 Klein 微操级控图 一致性镜像

3

3@AI-KSK

认证作者

认证作者 31

31 31H

31H更新时间:2026-04-30

支持自启动

支持自启动基于 ComfyUI、Flux2 Klein 9B,集成提示词增强、参考图控制、身份保持、颜色锚定和实验采样,适合保脸换姿势、多图合成、图生图精修与高一致性人像编辑。

基于 ComfyUI、Flux2 Klein 9B,集成提示词增强、参考图控制、身份保持、颜色锚定和实验采样,适合保脸换姿势、多图合成、图生图精修与高一致性人像编辑。

AI音乐

最强免费生成音乐,ACE-Step-V1.5-XL,免费版Suno,商业级别音乐效果!

2

2@与AI同行

认证作者

认证作者 15

15 6H

6H更新时间:2026-04-30

支持自启动

支持自启动最强免费生成音乐,ACE-Step-V1.5-XL,免费版Suno,商业级别音乐效果

最强免费生成音乐,ACE-Step-V1.5-XL,免费版Suno,商业级别音乐效果

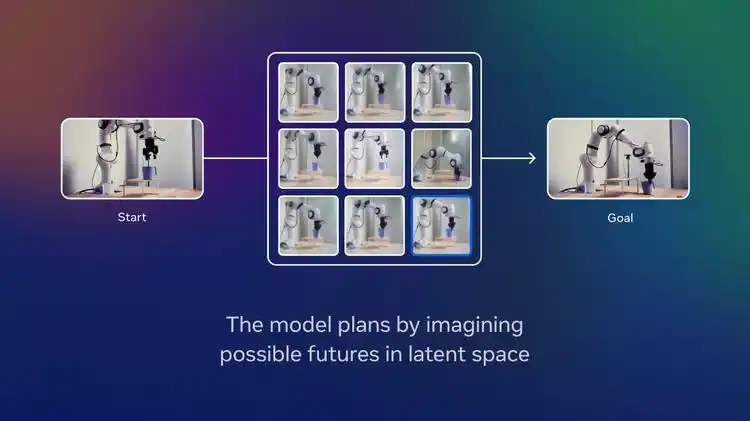

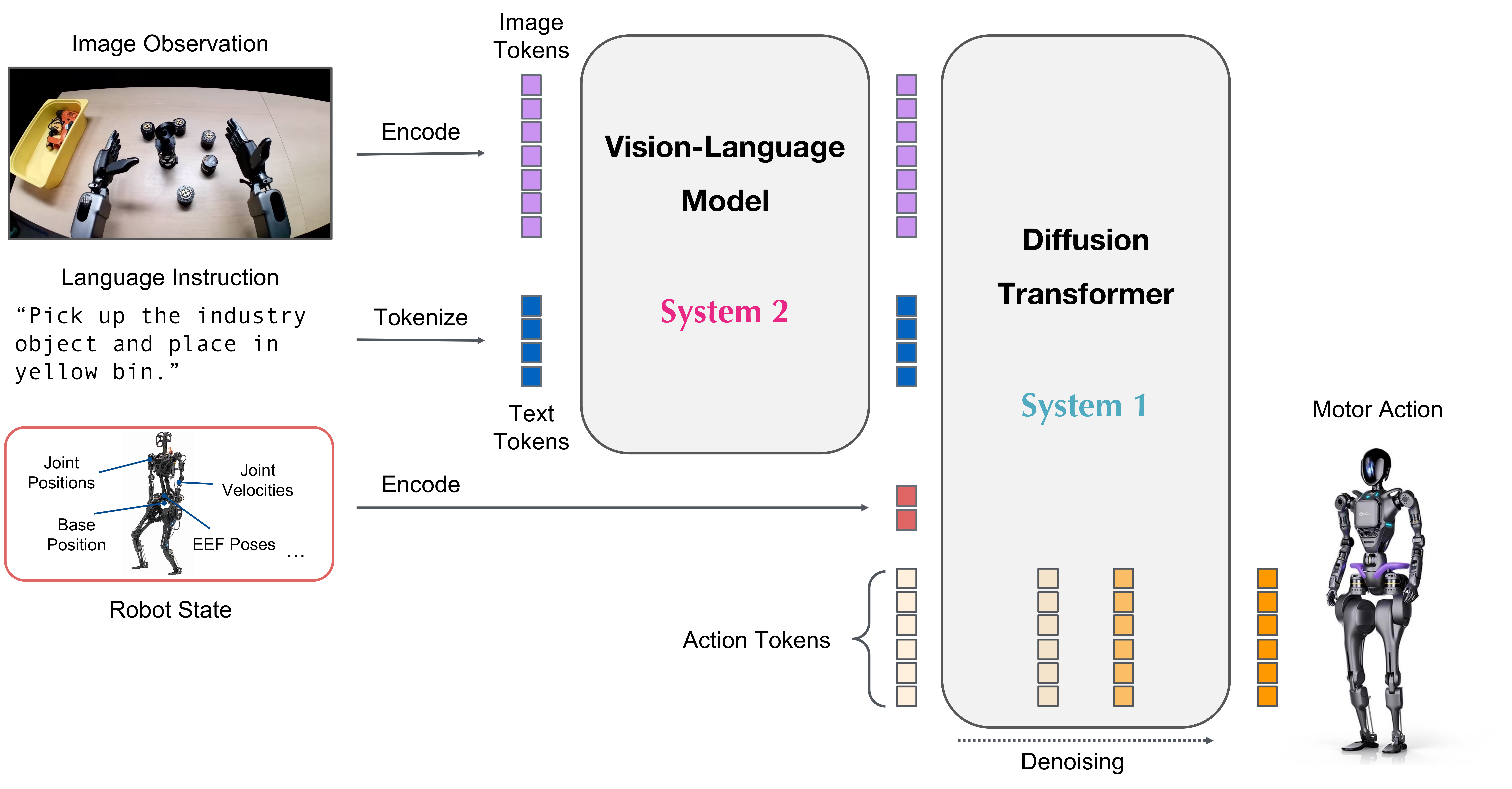

具身智能

openVLA

1

1@

1

1 0H

0H更新时间:2026-04-30

优云首个openvla推理镜像,实现输入图片,得到动作输出

优云首个openvla推理镜像,实现输入图片,得到动作输出

其他

anima炼丹v2

1

1@zhanglang

12

12 33H

33H更新时间:2026-04-30

支持自启动

支持自启动anima炼丹

anima炼丹

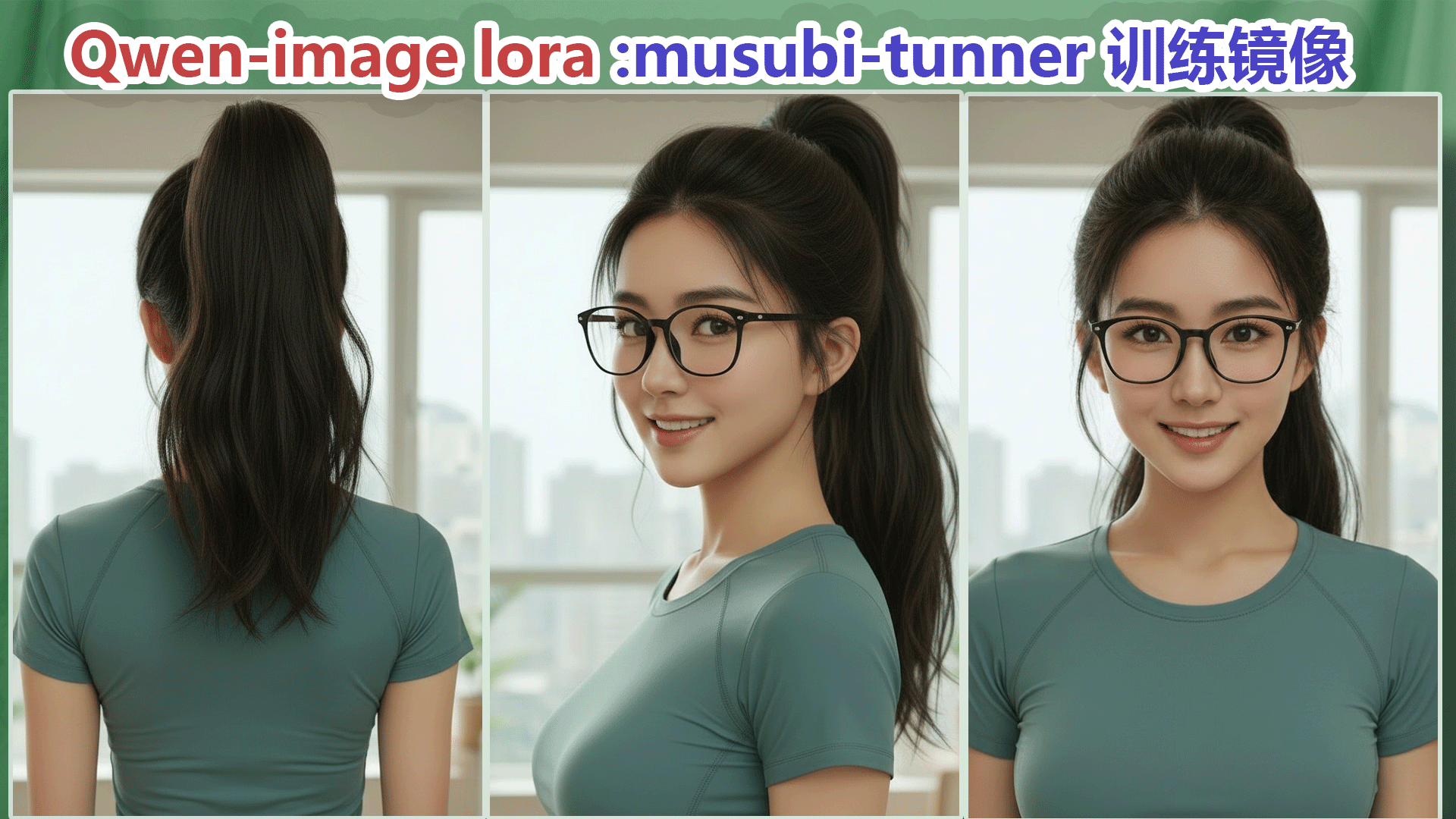

Qwen-imageWanLora训练

AiToolKit汉化版

97

97@Doc_workBox

认证作者

认证作者 1575

1575 17291H

17291H更新时间:2026-04-27

支持自启动

支持自启动Aitoolkit汉化版,自适应UI方便手机端查看训练进度

Aitoolkit汉化版,自适应UI方便手机端查看训练进度

ComfyUILTX数字人

LTX2.3 大丝袜视频工作流 I2V/T2V/V2V/首尾帧/音频一体化镜像

5

5@AI-KSK

认证作者

认证作者 80

80 59H

59H更新时间:2026-04-30

支持自启动

支持自启动LTX2.3 DaSiWa 视频生成整合镜像,基于 ComfyUI 封装,内置 OmniForge 工作流,支持图生视频、文生视频、首尾帧过渡、视频转视频与音频生成

LTX2.3 DaSiWa 视频生成整合镜像,基于 ComfyUI 封装,内置 OmniForge 工作流,支持图生视频、文生视频、首尾帧过渡、视频转视频与音频生成

AI音乐Lora训练ComfyUI

ACE-Step-1.5UI音乐生成和Lora训练

18

18@梦影Erislia

131

131 501H

501H更新时间:2026-04-26

ACE-Step-1.5UI音乐生成和Lora训练

ACE-Step-1.5UI音乐生成和Lora训练

AI漫剧

融光短视频创作平台webUI开源全流程AI视频创作平台自动化工作流

2

2@鸡你太美

认证作者

认证作者 13

13 39H

39H更新时间:2026-04-27

支持自启动

支持自启动可以无卡模式运行改项目

可以无卡模式运行改项目

图片生成图片编辑

GPT-Image-2,4k超分,文生图,图生图,自动提示词,批量任务,基于国内DMXAPI接口平台

4

4@刘悦的技术博客

认证作者

认证作者 44

44 35H

35H更新时间:2026-04-26

支持自启动

支持自启动GPT-Image-2,4k超分,文生图,图生图,自动提示词,批量任务,基于国内DMXAPI接口平台

GPT-Image-2,4k超分,文生图,图生图,自动提示词,批量任务,基于国内DMXAPI接口平台

语音合成语音识别

OmniVoice,批量任务,智能字幕SRT配音,多人对话,接口api使用,速度1比0.3,支持超长文本,声音克隆

2

2@刘悦的技术博客

认证作者

认证作者 29

29 97H

97H更新时间:2026-04-25

支持自启动

支持自启动OmniVoice,批量任务,智能字幕SRT配音,多人对话,接口api使用,速度1比0.3,支持超长文本,声音克隆

OmniVoice,批量任务,智能字幕SRT配音,多人对话,接口api使用,速度1比0.3,支持超长文本,声音克隆

语音合成

OmniVoice维吾尔语TTS在线webui文本转语音声音专版

2

2@鸡你太美

认证作者

认证作者 16

16 16H

16H更新时间:2026-04-27

支持自启动

支持自启动维吾尔语TTS在线webui文本转语音声音专版

维吾尔语TTS在线webui文本转语音声音专版

图片生成

AI图片新王登基,GPT-Image-2合集,超强图片细节,低至0.04元/张!图片生成 | 多图编辑 | 批量生成 | 最火爆的60+种提示词玩法

10

10@与AI同行

认证作者

认证作者 135

135 551H

551H更新时间:2026-04-24

支持自启动

支持自启动AI图片新王登基,GPT-Image-2合集,超强图片细节,低至0.04元/张!图片生成 | 多图编辑 | 批量生成 | 最火爆的60+种提示词玩法

AI图片新王登基,GPT-Image-2合集,超强图片细节,低至0.04元/张!图片生成 | 多图编辑 | 批量生成 | 最火爆的60+种提示词玩法

数字人

infinitetakl数字人云端版本

2

2@pappyai

20

20 42H

42H更新时间:2026-05-02

支持自启动

支持自启动infinitetakl数字人,支持单人对口型,双人对口型以及单人视频对口型

infinitetakl数字人,支持单人对口型,双人对口型以及单人视频对口型

视频编辑

facefusion3.5.1离线全部模型最新TensorRT加速官方原版图片换脸视频换脸高清图片 构建By科哥

30

30@鸡你太美

认证作者

认证作者 412

412 1672H

1672H更新时间:2026-04-27

支持自启动

支持自启动facefusion3.6.1全模型离线

facefusion3.6.1全模型离线

语音合成IndexTTSSVC

动漫短剧多人对话配音ComfyUi_voxcpm2

0

0@星尘小赵

7

7 8H

8H更新时间:2026-04-24

支持自启动

支持自启动支持多种语言的,单多人对话声音克隆配音

支持多种语言的,单多人对话声音克隆配音

ComfyUI图片生成

Ernie-Image-AIO-Rapid,4k超分,文生图,图生图,自动提示词,批量任务,支持50系

5

5@刘悦的技术博客

认证作者

认证作者 38

38 14H

14H更新时间:2026-04-23

支持自启动

支持自启动Ernie-Image-AIO-Rapid,4k超分,文生图,图生图,自动提示词,批量任务,支持50系

Ernie-Image-AIO-Rapid,4k超分,文生图,图生图,自动提示词,批量任务,支持50系

AI音乐ComfyUILTX

202604ComfyUI全能整合包,LTX2.3最新cu130环境更快更稳定

9

9@老徐Ai研习社

认证作者

认证作者 111

111 318H

318H更新时间:2026-04-22

支持自启动

支持自启动cu130环境更快更稳定

cu130环境更快更稳定

IndexTTS语音合成SVC

AI动漫配音—VoxCPM2一键语音克隆、配音、训练、支持LoRA

9

9@星尘小赵

44

44 104H

104H更新时间:2026-04-23

支持自启动

支持自启动VoxCPM2支持AI动漫配音等多种应用场景,一键语音克隆、配音、训练、支持LoRA

VoxCPM2支持AI动漫配音等多种应用场景,一键语音克隆、配音、训练、支持LoRA

文本模型

谷歌最新本地模型gemma4最强智能助理hermes agent一个本地免token的智能助理模型全部离线

5

5@鸡你太美

认证作者

认证作者 58

58 83H

83H更新时间:2026-04-27

支持自启动

支持自启动谷歌最新本地模型gemma4最强智能助理hermes agent一个本地免token的智能助理模型全部离线

谷歌最新本地模型gemma4最强智能助理hermes agent一个本地免token的智能助理模型全部离线

推理框架

ollama

0

0@苍耳阿猫

认证作者

认证作者 11

11 46H

46H更新时间:2026-04-21

ollama-0.21.0

ollama-0.21.0

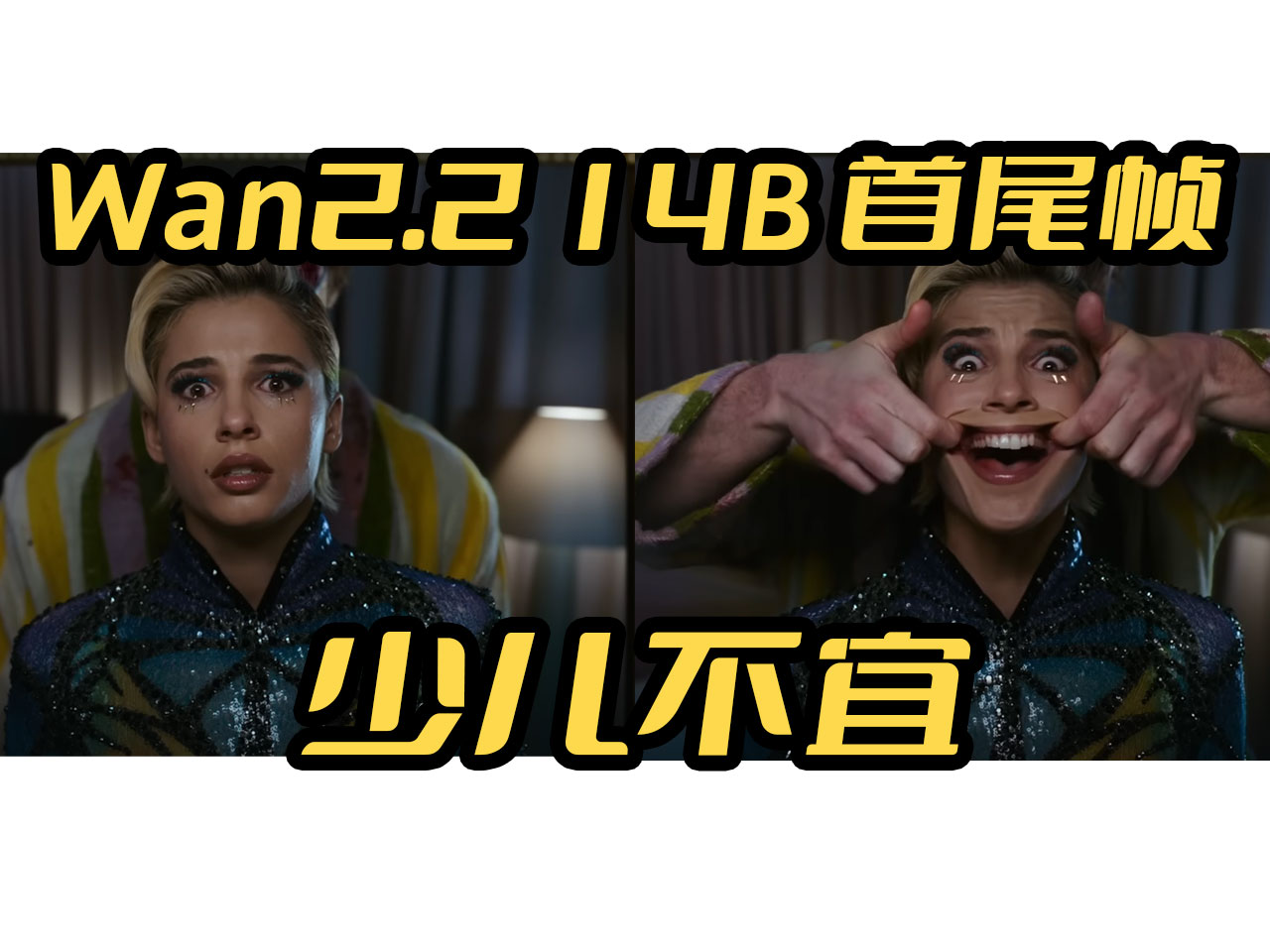

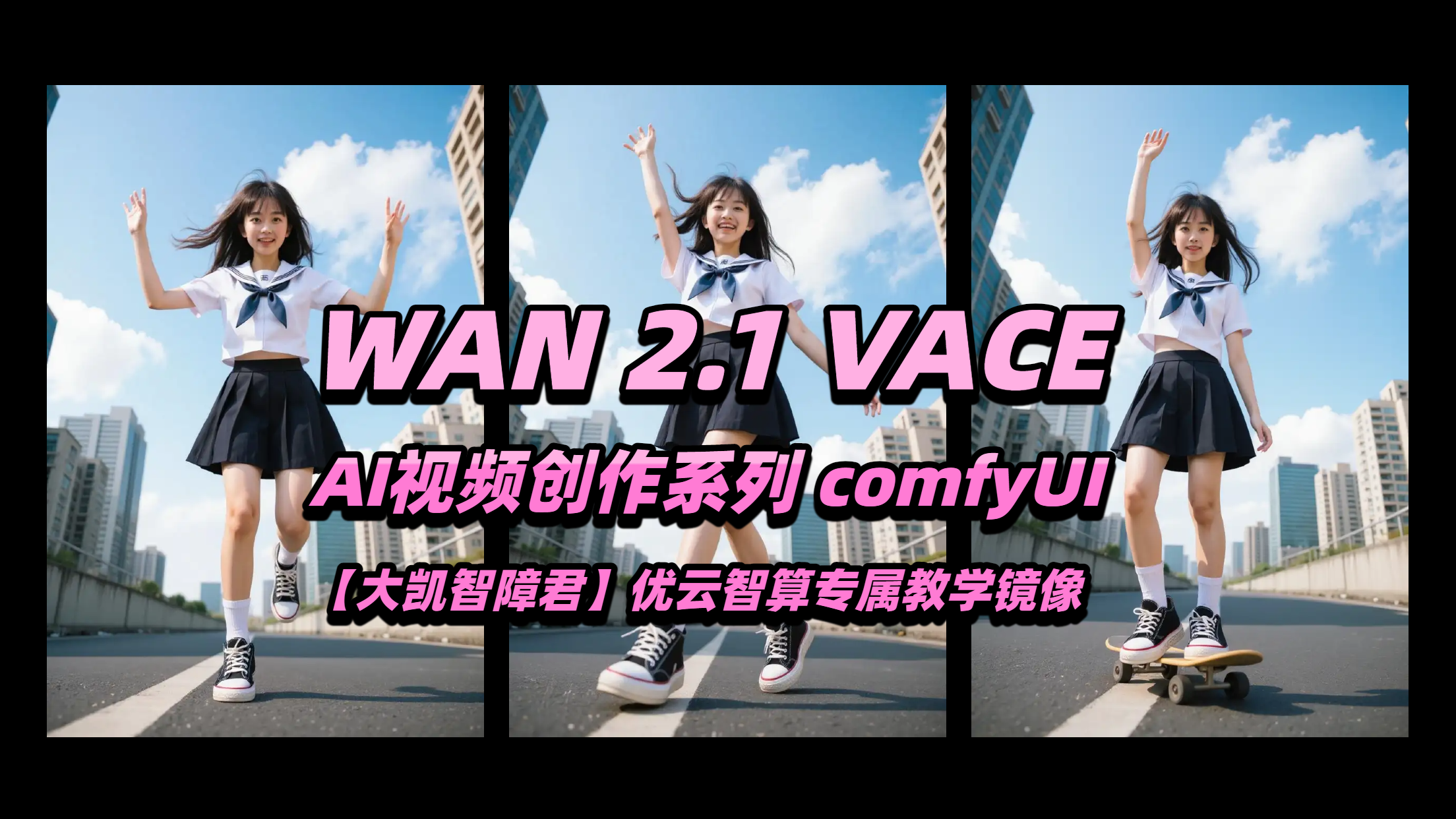

ComfyUIWan视频生成

Wan2.2_LightX2V-260412-文生视频-首尾帧-单图无限时长,自动补帧,自定义分辨率,自适应端口,自动提示词,自动任务控制

19

19@刘悦的技术博客

认证作者

认证作者 136

136 234H

234H更新时间:2026-04-20

支持自启动

支持自启动Wan2.2_LightX2V-260412-文生视频-首尾帧-单图无限时长,自动补帧,自定义分辨率,自适应端口,自动提示词,自动任务控制

Wan2.2_LightX2V-260412-文生视频-首尾帧-单图无限时长,自动补帧,自定义分辨率,自适应端口,自动提示词,自动任务控制

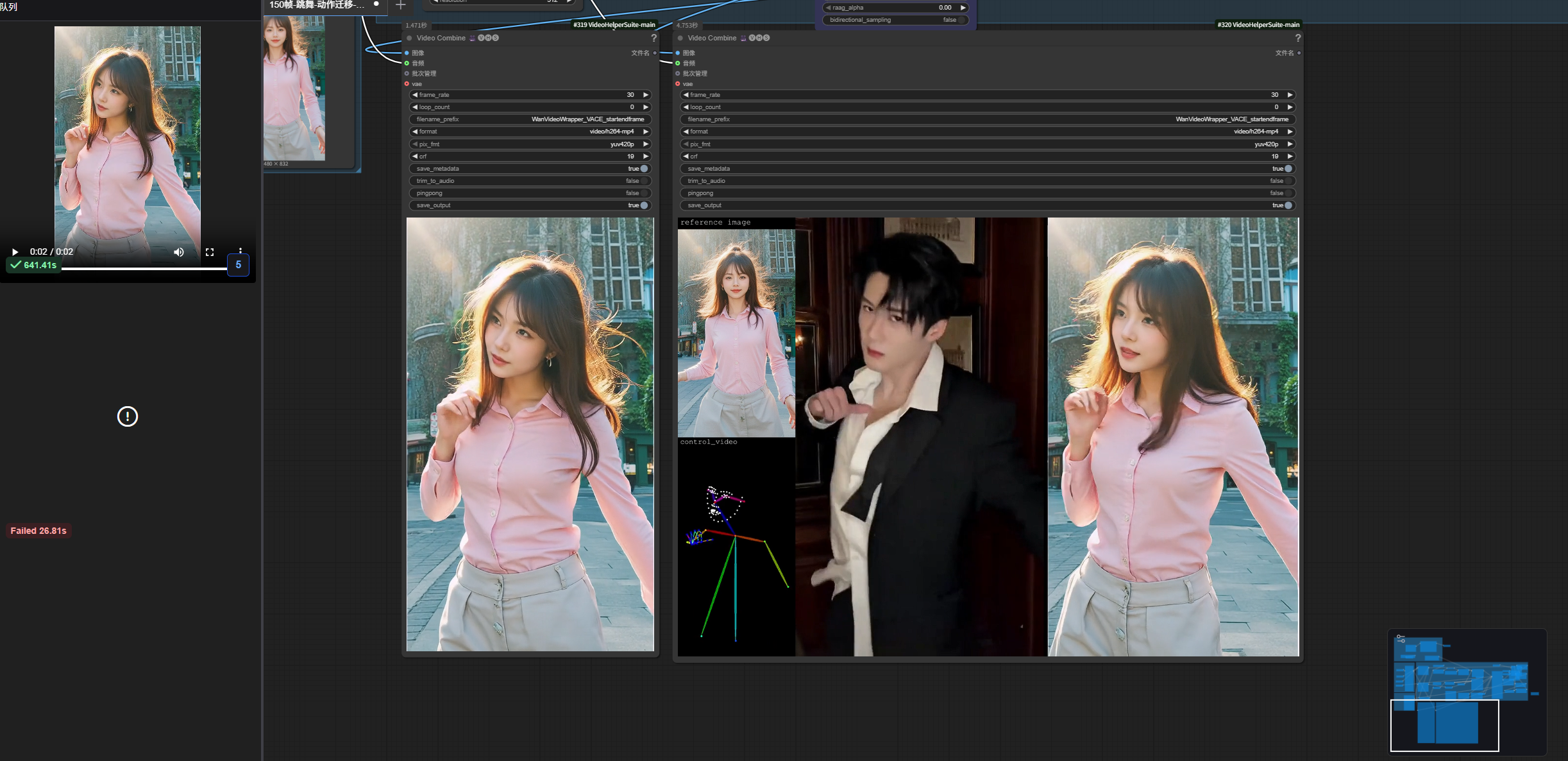

ComfyUILTX视频生成

LTX-2.3-DISTILLED-1.1-IC-Lora-动作迁移,自动补帧,支持50系,自定义分辨率,自适应端口,自动提示词,批量任务队列

10

10@刘悦的技术博客

认证作者

认证作者 143

143 145H

145H更新时间:2026-04-19

支持自启动

支持自启动LTX-2.3-DISTILLED-1.1-IC-Lora-动作迁移,自动补帧,支持50系,自定义分辨率,自适应端口,自动提示词,批量任务队列

LTX-2.3-DISTILLED-1.1-IC-Lora-动作迁移,自动补帧,支持50系,自定义分辨率,自适应端口,自动提示词,批量任务队列

图片生成视频生成其他

猫影短剧AI驱动的小说转短剧全流程生产平台小说文本自动转换为短剧视频 构建by科哥

9

9@鸡你太美

认证作者

认证作者 53

53 105H

105H更新时间:2026-04-27

支持自启动

支持自启动可以无卡模式运行改项目0.15元每小时按秒计费

可以无卡模式运行改项目0.15元每小时按秒计费

图生文图片生成视频生成

火宝AI短视频创作系统可以无卡模型运行该项目使用前阅读使用说明

0

0@鸡你太美

认证作者

认证作者 12

12 60H

60H更新时间:2026-04-27

支持自启动

支持自启动可以无卡模式运行改项目0.15元每小时按秒计费

可以无卡模式运行改项目0.15元每小时按秒计费

图片生成视频生成其他

moyin AI影视生产级工具支持 Seedance 2.0剧本到成片全流程批量化 构建by科哥

11

11@鸡你太美

认证作者

认证作者 52

52 60H

60H更新时间:2026-04-27

支持自启动

支持自启动可以无卡模式运行改项目0.15元每小时按秒计费

可以无卡模式运行改项目0.15元每小时按秒计费

图片生成视频生成

Toonflow一款AI短剧创作工具将小说自动转化为剧本生成 AI 图片和视频的平台 构建by科哥

9

9@鸡你太美

认证作者

认证作者 48

48 43H

43H更新时间:2026-04-27

支持自启动

支持自启动可以无卡模式运行改项目0.15元每小时按秒计费

可以无卡模式运行改项目0.15元每小时按秒计费

语音合成Lora训练

VoxCPM2 一键切片打标训练集准备&训练生成一体化镜像

3

3@AI-KSK

认证作者

认证作者 20

20 16H

16H更新时间:2026-04-19

支持自启动

支持自启动集成 VoxCPM2 一键切片、自动打标、训练集整理、LoRA 训练与生成推理,开箱即用的全流程声音克隆训练镜像。

集成 VoxCPM2 一键切片、自动打标、训练集整理、LoRA 训练与生成推理,开箱即用的全流程声音克隆训练镜像。

数字人ComfyUIInfiniteTalk

InfiniteTalk数字人量化版

2

2@

30

30 41H

41H更新时间:2026-04-20

支持自启动

支持自启动InfiniteTalk数字人量化版4090效果最好,3090也可用

InfiniteTalk数字人量化版4090效果最好,3090也可用

ComfyUI图片生成

ERNIE-Image:开源图像生成新王炸

6

6@AI-KSK

认证作者

认证作者 35

35 101H

101H更新时间:2026-04-17

支持自启动

支持自启动ERNIE-Image ComfyUI镜像,集成百度开源文生图模型,擅长文字排版、复杂指令与结构化出图,适合海报、信息图等场景

ERNIE-Image ComfyUI镜像,集成百度开源文生图模型,擅长文字排版、复杂指令与结构化出图,适合海报、信息图等场景

语音合成

VoxCPM2雨落版整合包

6

6@雨落实战

认证作者

认证作者 54

54 105H

105H更新时间:2026-04-17

支持自启动

支持自启动VoxCPM2雨落版整合包,支持多种业务场景

VoxCPM2雨落版整合包,支持多种业务场景

ComfyUI图片生成

Ernie-Image-Turbo-uncensored,文生图,图生图,自动提示词,批量任务,支持50系

3

3@刘悦的技术博客

认证作者

认证作者 57

57 47H

47H更新时间:2026-04-16

支持自启动

支持自启动Ernie-Image-Turbo-uncensored,文生图,图生图,自动提示词,批量任务,支持50系

Ernie-Image-Turbo-uncensored,文生图,图生图,自动提示词,批量任务,支持50系

数字人视频生成

Musetalk训练专用

0

0@有黑眼圈的小竹熊

3

3 1H

1H更新时间:2026-04-17

支持自启动

支持自启动Musetalk训练专用

Musetalk训练专用

Lora训练图片生成其他

二次元AnimaPreview3的Lora训练UI

23

23@梦影Erislia

224

224 1614H

1614H更新时间:2026-04-15

二次元AnimaPreview3的Lora训练UI

二次元AnimaPreview3的Lora训练UI

语音合成

最强AI语音克隆,LongcatAudio合集,语音克隆 | 音色保存 | 多人对话 | 字幕生成语音| 多音字 | 批量生成

9

9@与AI同行

认证作者

认证作者 67

67 57H

57H更新时间:2026-04-15

支持自启动

支持自启动最强AI语音克隆,LongcatAudio合集,语音克隆 | 音色保存 | 多人对话 | 字幕生成语音| 多音字 | 批量生成,6G显存可用!

最强AI语音克隆,LongcatAudio合集,语音克隆 | 音色保存 | 多人对话 | 字幕生成语音| 多音字 | 批量生成,6G显存可用!

Lora训练图片生成其他

百度ERNIE-Image的Lora训练AI-TOOLKIT

0

0@梦影Erislia

26

26 211H

211H更新时间:2026-04-15

百度ERNIE-Image的Lora训练AI-TOOLKIT

百度ERNIE-Image的Lora训练AI-TOOLKIT

视频生成

VAD-fast3.0 图生视频模型,可批量生成,3分钟出15秒视频

3

3@Ai老邱

31

31 14H

14H更新时间:2026-04-15

支持自启动

支持自启动图生视频模型,可真人批量生成,3分钟出15秒视频

图生视频模型,可真人批量生成,3分钟出15秒视频

文本模型

hermes-webui中文版支持自定义任意大模型支持微信飞书等接入

1

1@鸡你太美

认证作者

认证作者 11

11 42H

42H更新时间:2026-04-27

支持自启动

支持自启动hermes-webui中文版支持自定义任意大模型支持微信飞书等接入

hermes-webui中文版支持自定义任意大模型支持微信飞书等接入

AI应用语音合成

ComfyUI_voxcpm全能生成_那颗星星(支持多人配音,支持lora训练,老版本支持)

10

10@那颗星星

53

53 151H

151H更新时间:2026-04-15

支持自启动

支持自启动最强大的VoxCPM节点,支持多人配音、支持训练lora(包含数据集准备节点,傻瓜式操作)、兼容老模型

最强大的VoxCPM节点,支持多人配音、支持训练lora(包含数据集准备节点,傻瓜式操作)、兼容老模型

ComfyUILora训练语音合成

VoxCPM2语音克隆工作流LORA训练comfy支持

4

4@梦影Erislia

37

37 32H

32H更新时间:2026-04-14

VoxCPM2 TTS语音克隆工作流LORA训练comfy支持

VoxCPM2 TTS语音克隆工作流LORA训练comfy支持

语音合成

最强AI音色克隆,OmniVoice合集,音色克隆 | 语气控制 | 音色保存 | 多音字 | 批量生成

10

10@与AI同行

认证作者

认证作者 489

489 743H

743H更新时间:2026-04-13

支持自启动

支持自启动最强AI音色克隆,OmniVoice合集,音色克隆 | 语气控制 | 音色保存 | 多音字 | 批量生成

最强AI音色克隆,OmniVoice合集,音色克隆 | 语气控制 | 音色保存 | 多音字 | 批量生成

FluxComfyUI图片生成

Flux.2-Klein-9B-GGUF

75

75@刘悦的技术博客

认证作者

认证作者 883

883 1605H

1605H更新时间:2026-04-13

支持自启动

支持自启动Flux.2-Klein-9B-GGUF,局部重绘,文生图,图像编辑,多图编辑,自动提示词,批量任务,支持最新50系和计算卡

Flux.2-Klein-9B-GGUF,局部重绘,文生图,图像编辑,多图编辑,自动提示词,批量任务,支持最新50系和计算卡

语音合成AI音乐

Ace-Step-1.5-XL-Turbo,歌曲生成,音乐生成,文字转歌曲,歌曲创作,支持50系

4

4@刘悦的技术博客

认证作者

认证作者 30

30 279H

279H更新时间:2026-04-12

支持自启动

支持自启动Ace-Step-1.5-XL-Turbo,歌曲生成,音乐生成,文字转歌曲,歌曲创作,支持50系

Ace-Step-1.5-XL-Turbo,歌曲生成,音乐生成,文字转歌曲,歌曲创作,支持50系

IndexTTSQwen3-TTSCosyVoice

咸鱼鱼VoxCPM

2

2@后期咸鱼鱼-小帆

72

72 87H

87H更新时间:2026-04-13

支持自启动

支持自启动VoxCPM2

VoxCPM2

语音合成

VoxCPM2

2

2@鹄仙

认证作者

认证作者 27

27 78H

78H更新时间:2026-04-11

多语言的声音克隆和设计项目,支持lora训练

多语言的声音克隆和设计项目,支持lora训练

语音合成IndexTTS语音识别

LongCat-AudioDiT 剧本创作台

0

0@K哥讲AI

8

8 141H

141H更新时间:2026-04-13

支持自启动

支持自启动LongCat-AudioDiT WebUI 是基于该模型的可视化工具,支持音色库管理、剧本队列编排、长文本切分及音频生成,模块化设计配中文注释,本地部署开源免费,小白可轻松实现高质量语音克隆。

LongCat-AudioDiT WebUI 是基于该模型的可视化工具,支持音色库管理、剧本队列编排、长文本切分及音频生成,模块化设计配中文注释,本地部署开源免费,小白可轻松实现高质量语音克隆。

AI漫剧

AutoAnimation短剧漫剧自动化工具

45

45@IAI666

286

286 1121H

1121H更新时间:2026-04-10

AutoAnimation短剧漫剧自动化工具及配套ComfyUI包含ZImage、flux2-kelin、qwenedit2511、wan2.2、qwen-tts、index-tts

AutoAnimation短剧漫剧自动化工具及配套ComfyUI包含ZImage、flux2-kelin、qwenedit2511、wan2.2、qwen-tts、index-tts

ComfyUILTXLora训练

ltx2.3-aitookit

1

1@有趣的80后程序员

认证作者

认证作者 24

24 22H

22H更新时间:2026-04-13

支持自启动

支持自启动ltx2.3 aitookit Lora训练镜像

ltx2.3 aitookit Lora训练镜像

IndexTTS语音合成AI应用

indextts-v1.52支持api调用deepspeed推理加速,并发请求,为AI直播优化的版本

1

1@屾哥日记

20

20 2771H

2771H更新时间:2026-04-10

支持自启动

支持自启动indextts-v1.52支持api调用deepspeed推理加速,并发请求,为AI直播优化的版本

indextts-v1.52支持api调用deepspeed推理加速,并发请求,为AI直播优化的版本

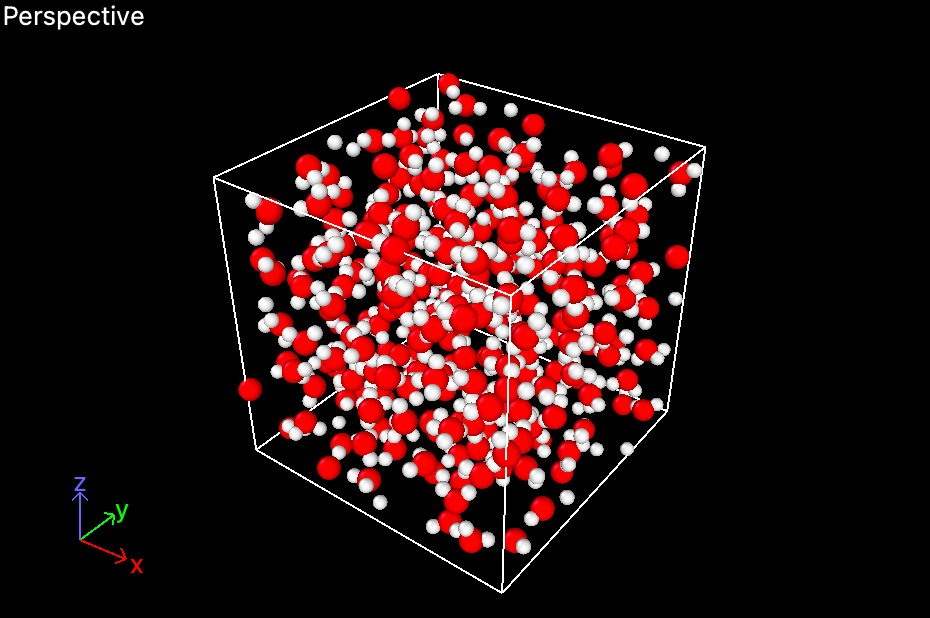

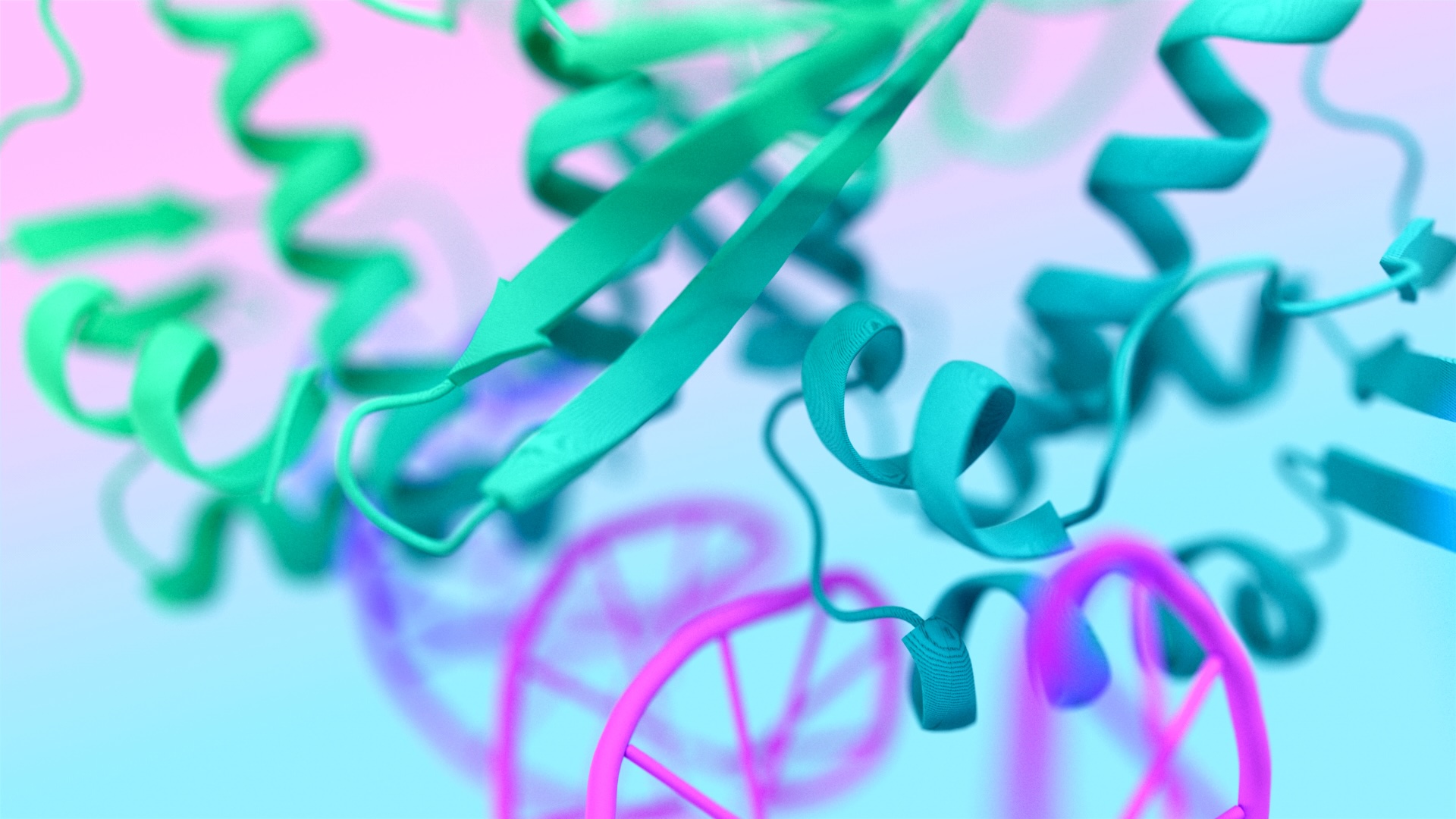

物理模拟分子动力

Gromacs系列

21

21@苍耳阿猫

认证作者

认证作者 500

500 15009H

15009H更新时间:2026-04-09

该镜像集成开源高性能分子动力学模拟软件,通过强化多精度算法与GPU并行加速(支持NVIDIA/AMD显卡)实现纳秒级生物大分子运动模拟,优化AI辅助建模与超大体系计算效率,提供跨平台开箱即用解决方案

该镜像集成开源高性能分子动力学模拟软件,通过强化多精度算法与GPU并行加速(支持NVIDIA/AMD显卡)实现纳秒级生物大分子运动模拟,优化AI辅助建模与超大体系计算效率,提供跨平台开箱即用解决方案

GLMOCR识别

GLM-OCR

1

1@苍耳阿猫

认证作者

认证作者 3

3 1H

1H更新时间:2026-04-09

GLM-OCR

GLM-OCR

语音合成Qwen3-TTSAI电商

【VoxCPM2/Qwen3TTS/IndexTTS2/OmniVoice】N合一AI语音整合TTS ALL in ONE

69

69@淼淼爸的ai笔记

认证作者

认证作者 834

834 4135H

4135H更新时间:2026-04-09

支持自启动

支持自启动本镜像专为AI语音直播项目打造,也可以直接在线推理webui使用,集成VoxCPM2/IndexTTS-2等, 支持API调用,直播带货,tiktok直播,在线克隆,语气语调自然,音色还原度高

本镜像专为AI语音直播项目打造,也可以直接在线推理webui使用,集成VoxCPM2/IndexTTS-2等, 支持API调用,直播带货,tiktok直播,在线克隆,语气语调自然,音色还原度高

语音合成语音识别

VOXCPM2语音合成,TTS,多音字控制,接口API调用,语速调节,支持50系,支持老显卡,音色保存,方言控制,开源阅读,支持超长文本

6

6@刘悦的技术博客

认证作者

认证作者 78

78 73H

73H更新时间:2026-04-08

支持自启动

支持自启动VOXCPM2语音合成,TTS,多音字控制,接口API调用,语速调节,支持50系,支持老显卡,音色保存,方言控制,开源阅读,支持超长文本

VOXCPM2语音合成,TTS,多音字控制,接口API调用,语速调节,支持50系,支持老显卡,音色保存,方言控制,开源阅读,支持超长文本

AI音乐

AI音乐制作ACE-Step-1.5XL官方包

6

6@鹄仙

认证作者

认证作者 41

41 195H

195H更新时间:2026-04-08

专业级别的AI音乐制作项目升级XL

专业级别的AI音乐制作项目升级XL

文本模型推理框架

Gemma-4 + GPT-OSS-120B 双破限大模型 WebUI 开箱即用镜像

17

17@AI-KSK

认证作者

认证作者 80

80 87H

87H更新时间:2026-04-09

支持自启动

支持自启动基于 Ollama + Open WebUI 搭建的双破限大模型共享镜像,集成 Gemma-4 与 GPT-OSS-120B 两类核心模型,支持浏览器直接访问与可视化聊天。

基于 Ollama + Open WebUI 搭建的双破限大模型共享镜像,集成 Gemma-4 与 GPT-OSS-120B 两类核心模型,支持浏览器直接访问与可视化聊天。

图片生成视频生成AI漫剧

Huobao-Drama

22

22@huobao-ai

认证作者

认证作者 96

96 345H

345H更新时间:2026-04-08

支持自启动

支持自启动Huobao Drama 是一个基于 AI 的短剧自动化生产平台,实现从剧本生成、角色设计、分镜制作到视频合成的全流程自动化

Huobao Drama 是一个基于 AI 的短剧自动化生产平台,实现从剧本生成、角色设计、分镜制作到视频合成的全流程自动化

数字人LTXComfyUI

LTX-2.3-VBVR-图片数字人,真正无限时长,分片推理,自动补帧,支持50系,自定义分辨率,自适应端口,自动提示词,批量任务队列

9

9@刘悦的技术博客

认证作者

认证作者 81

81 128H

128H更新时间:2026-04-07

支持自启动

支持自启动LTX-2.3-VBVR-图片数字人,真正无限时长,分片推理,自动补帧,支持50系,自定义分辨率,自适应端口,自动提示词,批量任务队列

LTX-2.3-VBVR-图片数字人,真正无限时长,分片推理,自动补帧,支持50系,自定义分辨率,自适应端口,自动提示词,批量任务队列

视频生成LTX

LTX-2.3-VBVR-文生视频-首尾帧,单图无限时长,自动补帧,支持50系,自定义分辨率,自适应端口,自动提示词,批量任务队列

11

11@刘悦的技术博客

认证作者

认证作者 96

96 102H

102H更新时间:2026-04-07

支持自启动

支持自启动LTX-2.3-VBVR-文生视频-首尾帧,单图无限时长,自动补帧,支持50系,自定义分辨率,自适应端口,自动提示词,批量任务队列

LTX-2.3-VBVR-文生视频-首尾帧,单图无限时长,自动补帧,支持50系,自定义分辨率,自适应端口,自动提示词,批量任务队列

语音合成语音识别

OmniVoice,接口api使用,支持600种语言,4G显存可用,速度1比0.3,文本指令,支持呻吟笑声,文字转语音,支持超长文本,声音克隆,小米k2-fsa团队开源

14

14@刘悦的技术博客

认证作者

认证作者 168

168 680H

680H更新时间:2026-04-05

支持自启动

支持自启动OmniVoice,接口api使用,支持600种语言,4G显存可用,速度1比0.3,文本指令,支持呻吟笑声,文字转语音,支持超长文本,声音克隆,小米k2-fsa团队开源

OmniVoice,接口api使用,支持600种语言,4G显存可用,速度1比0.3,文本指令,支持呻吟笑声,文字转语音,支持超长文本,声音克隆,小米k2-fsa团队开源

语音合成语音识别

LongCat-AudioDiT-1B-3.5B,TTS,音色保存,接口API调用,支持超长文本,支持50系显卡,语速调节,文字转语音,TTS

2

2@刘悦的技术博客

认证作者

认证作者 38

38 40H

40H更新时间:2026-04-05

支持自启动

支持自启动LongCat-AudioDiT-1B-3.5B,6G显存可用,TTS,音色保存,接口API调用,支持超长文本,支持50系显卡,语速调节,文字转语音,TTS

LongCat-AudioDiT-1B-3.5B,6G显存可用,TTS,音色保存,接口API调用,支持超长文本,支持50系显卡,语速调节,文字转语音,TTS

语音合成

ComfyUI-OmniVoice-TTS小米团队开源单人多人声音克隆语音克隆捏声音

3

3@鸡你太美

认证作者

认证作者 37

37 29H

29H更新时间:2026-04-27

支持自启动

支持自启动ComfyUI-OmniVoice-TTS小米团队开源单人多人声音克隆语音克隆捏声音

ComfyUI-OmniVoice-TTS小米团队开源单人多人声音克隆语音克隆捏声音

其他

trading-agents针对国内股票的股票交易Agent

1

1@鸡你太美

认证作者

认证作者 7

7 45H

45H更新时间:2026-04-27

支持自启动

支持自启动trading-agents针对国内股票的股票交易Agent

trading-agents针对国内股票的股票交易Agent

视频生成

最强AI视频抠像,MatAnyone2,超强抠像效果,支持超长视频!

5

5@与AI同行

认证作者

认证作者 64

64 116H

116H更新时间:2026-04-06

支持自启动

支持自启动最强AI视频抠像,MatAnyone2,超强抠像效果,支持超长视频!

最强AI视频抠像,MatAnyone2,超强抠像效果,支持超长视频!

Lora训练

ai-toolkit全能Lora模型训练王

11

11@老徐Ai研习社

认证作者

认证作者 143

143 1929H

1929H更新时间:2026-04-09

支持自启动

支持自启动主流模型都有

主流模型都有

ComfyUI视频生成视频编辑

wan2.2动作迁移

15

15@

149

149 26H

26H更新时间:2026-04-02

wan2.2动作迁移

wan2.2动作迁移

ComfyUIQwen-Image图片编辑

Qwen-Edit-2511-Rapid-V23,图像编辑,表情控制,多图编辑,自动提示词,批量任务,支持50系

19

19@刘悦的技术博客

认证作者

认证作者 221

221 657H

657H更新时间:2026-04-01

支持自启动

支持自启动Qwen-Edit-2511-Rapid-V23,图像编辑,表情控制,多图编辑,自动提示词,批量任务,支持50系

Qwen-Edit-2511-Rapid-V23,图像编辑,表情控制,多图编辑,自动提示词,批量任务,支持50系

AI应用图片编辑图像分割

Live2d神器一键拆分See-through

37

37@梦影Erislia

529

529 1240H

1240H更新时间:2026-03-31

Live2d神器一键拆分See-through

Live2d神器一键拆分See-through

语音合成

MOSS-TTS 语音模型

5

5@刘悦的技术博客

认证作者

认证作者 48

48 62H

62H更新时间:2026-03-31

支持自启动

支持自启动MOSS-TTS,接口API,语音合成,声音克隆,TTS,支持超长文本,支持50系

MOSS-TTS,接口API,语音合成,声音克隆,TTS,支持超长文本,支持50系

ComfyUILTX视频生成

LTX-2.3-Transition-文生视频

6

6@刘悦的技术博客

认证作者

认证作者 107

107 115H

115H更新时间:2026-03-30

支持自启动

支持自启动LTX-2.3-Transition-文生视频-首尾帧,无限时长,支持50系,自定义分辨率,自适应端口,自动提示词,批量任务队列

LTX-2.3-Transition-文生视频-首尾帧,无限时长,支持50系,自定义分辨率,自适应端口,自动提示词,批量任务队列

ComfyUIWan视频生成

Wan 2.2 无限制 3.0

34

34@AI-KSK

认证作者

认证作者 323

323 556H

556H更新时间:2026-04-09

集成 SmoothMix T2V 3.0 与 Remix I2V 3.0,支持无限制文本生视频与图生视频创作,兼顾画质、动态、运镜与一致性,适合快速出片与高完成度表达。

集成 SmoothMix T2V 3.0 与 Remix I2V 3.0,支持无限制文本生视频与图生视频创作,兼顾画质、动态、运镜与一致性,适合快速出片与高完成度表达。

视频生成

X-Dub-WebUI

1

1@鸡你太美

认证作者

认证作者 11

11 8H

8H更新时间:2026-04-27

支持自启动

支持自启动X-Dub-WebUI可灵团队推出的视频驱动唇形生成与任意尺寸视频数字人视频生成 二次开发webui构建By科哥

X-Dub-WebUI可灵团队推出的视频驱动唇形生成与任意尺寸视频数字人视频生成 二次开发webui构建By科哥

LTX视频生成数字人

LTX-2.3-Transition--图片数字人

9

9@刘悦的技术博客

认证作者

认证作者 80

80 91H

91H更新时间:2026-03-30

支持自启动

支持自启动LTX-2.3-Transition--图片数字人,更好的稳定性,无限时长,支持50系,自定义分辨率

LTX-2.3-Transition--图片数字人,更好的稳定性,无限时长,支持50系,自定义分辨率

图片生成图片编辑

最强AI图片编辑,FireRed-Edit整合包合集,商用顶级图片效果!

23

23@与AI同行

认证作者

认证作者 217

217 392H

392H更新时间:2026-03-31

支持自启动

支持自启动最强AI图片编辑,FireRed-Edit整合包合集,商用顶级图片效果!支持多图编辑、局部涂抹编辑、高清放大,解压即用,一键启动!

最强AI图片编辑,FireRed-Edit整合包合集,商用顶级图片效果!支持多图编辑、局部涂抹编辑、高清放大,解压即用,一键启动!

ComfyUI视频编辑视频生成

陈晨的comfyui云端镜像系列

10

10@陈晨

89

89 165H

165H更新时间:2026-03-30

支持自启动

支持自启动内置多个工作流 开箱即用

内置多个工作流 开箱即用

数字人ComfyUI视频生成

图片·声音·视频·2603comfyui全能整合包

30

30@老徐Ai研习社

认证作者

认证作者 284

284 1868H

1868H更新时间:2026-03-26

支持自启动

支持自启动图片·声音·视频·2603comfyui全能整合包

图片·声音·视频·2603comfyui全能整合包

ComfyUILTX视频生成

LTX-2.3 LoRA训练 +AIToolkit 4090/48G/5090 一键开训

5

5@AI-KSK

认证作者

认证作者 56

56 296H

296H更新时间:2026-03-28

集成AIToolkit与LTX-2 LoRA训练全套环境,适配4090 48G/5090预设参数,支持一键启动、缓存优化、依赖预装,开箱即可进行音视频LoRA训练

集成AIToolkit与LTX-2 LoRA训练全套环境,适配4090 48G/5090预设参数,支持一键启动、缓存优化、依赖预装,开箱即可进行音视频LoRA训练

数字人ComfyUIFlux

LTX2.3 创作增强旗舰版

16

16@AI-KSK

认证作者

认证作者 116

116 177H

177H更新时间:2026-03-26

基于LTX2.3深度整合的全功能创作镜像,集成ID-LoRA、换头、局部重绘、多图首尾帧等特色能力,环境完整、依赖丰富,适合视频生成、角色一致性控制与多场景创作。

基于LTX2.3深度整合的全功能创作镜像,集成ID-LoRA、换头、局部重绘、多图首尾帧等特色能力,环境完整、依赖丰富,适合视频生成、角色一致性控制与多场景创作。

LTXLora训练视频生成

LTX2.3Lora训练用AI-toolkit,简单配置一键训练

4

4@梦影Erislia

88

88 1326H

1326H更新时间:2026-03-25

LTX2.3Lora训练用AI-toolkit,简单配置一键训练

LTX2.3Lora训练用AI-toolkit,简单配置一键训练

其他

那颗星星自制香蕉pro和sora2工作流

29

29@那颗星星

272

272 2913H

2913H更新时间:2026-03-25

支持自启动

支持自启动内含我所有自制的comfyui节点和工作流

内含我所有自制的comfyui节点和工作流

ComfyUIWan视频生成

Wan2.2-ReMixV3.0

27

27@刘悦的技术博客

认证作者

认证作者 327

327 564H

564H更新时间:2026-03-30

支持自启动

支持自启动Wan2.2-ReMixV3.0-SVI2-VBVR,文生视频,图生视频,无限时长,首尾帧,自动补帧,自适应端口号,支持50系,支持批量任务

Wan2.2-ReMixV3.0-SVI2-VBVR,文生视频,图生视频,无限时长,首尾帧,自动补帧,自适应端口号,支持50系,支持批量任务

ComfyUILTX图片编辑

Comfy打开即用LTX2.3Dasiwa视频生成qwen图像编辑

8

8@梦影Erislia

61

61 241H

241H更新时间:2026-03-24

Comfy打开即用LTX2.3Dasiwa视频生成qwen图像编辑

Comfy打开即用LTX2.3Dasiwa视频生成qwen图像编辑

数据分析其他

MiroFish一个ai预测系统数据模型预测ai系统 构建by科哥

3

3@鸡你太美

认证作者

认证作者 16

16 34H

34H更新时间:2026-04-27

支持自启动

支持自启动MiroFish一个ai预测系统数据模型预测ai系统 构建by科哥

MiroFish一个ai预测系统数据模型预测ai系统 构建by科哥

ComfyUI视频编辑Wan

Animate动作迁移

29

29@小猪AI-闲鱼

261

261 694H

694H更新时间:2026-03-23

支持自启动

支持自启动完美复刻视频主体动作

完美复刻视频主体动作

AI应用视频编辑图片编辑

MatAnyone2

3

3@刘悦的技术博客

认证作者

认证作者 71

71 82H

82H更新时间:2026-03-23

支持自启动

支持自启动MatAnyone2,视频图片一键去背,换背景,智能提取前景主体,支持GPU和纯CPU推理,绿幕生成器

MatAnyone2,视频图片一键去背,换背景,智能提取前景主体,支持GPU和纯CPU推理,绿幕生成器

语音合成SVC

SVC-WebUI

53

53@乔大峰

认证作者

认证作者 1214

1214 14136H

14136H更新时间:2026-04-22

一键训练SVC模型,支持上传压缩干声文件,训练完成发送提醒,一键清空训练环境,追求的就是高效率

一键训练SVC模型,支持上传压缩干声文件,训练完成发送提醒,一键清空训练环境,追求的就是高效率

AI音乐

SoulX-Singer-SVC

10

10@鹄仙

认证作者

认证作者 90

90 171H

171H更新时间:2026-03-20

一键翻唱神器

一键翻唱神器

Lora训练LTX其他

LTX2.3Lora训练支持Musubi-tuner

3

3@梦影Erislia

63

63 286H

286H更新时间:2026-03-18

LTX2.3Lora训练支持Musubi-tuner

LTX2.3Lora训练支持Musubi-tuner

Qwen3-TTS语音合成语音识别

Faster-Qwen3-TTS

12

12@刘悦的技术博客

认证作者

认证作者 98

98 345H

345H更新时间:2026-03-18

支持自启动

支持自启动Faster-Qwen3-TTS,流式接口API,实时推理,速度1比0.5,多人对话,智能多音字,4G显存可用,批量任务,支持超长文本,支持50系显卡,支持老显卡

Faster-Qwen3-TTS,流式接口API,实时推理,速度1比0.5,多人对话,智能多音字,4G显存可用,批量任务,支持超长文本,支持50系显卡,支持老显卡

语音合成

Fish-Speech-S2-Pro-4B

6

6@刘悦的技术博客

认证作者

认证作者 79

79 179H

179H更新时间:2026-03-18

支持自启动

支持自启动Fish-Speech-S2-Pro-4B,接口api使用,支持62种语言,文本指令,文字转语音,声音克隆,zero-shot

Fish-Speech-S2-Pro-4B,接口api使用,支持62种语言,文本指令,文字转语音,声音克隆,zero-shot

AI音乐

SongGeneration音乐生成

6

6@鹄仙

认证作者

认证作者 20

20 15H

15H更新时间:2026-03-20

音乐生成工具,应用简单

音乐生成工具,应用简单

ComfyUIZ-Image图片生成

Z-Image Turbo 无限制生成控制放大一体化镜像

26

26@AI-KSK

认证作者

认证作者 282

282 646H

646H更新时间:2026-03-13

集成文生图、图生图、ControlNet 控制、提示词优化、放大增强等全员破限工作流。

集成文生图、图生图、ControlNet 控制、提示词优化、放大增强等全员破限工作流。

ComfyUIWan视频超分

视频批量补帧、超分放大与细节修复,ComfyUI视频增强镜像,Seedance2.0黄金搭档

26

26@AI-KSK

认证作者

认证作者 137

137 409H

409H更新时间:2026-03-12

集成 FlashVSR / GIMM / LTX-2 / SeedVR2 的 ComfyUI 视频增强镜像,一键批量补帧、放大、细节修复。

集成 FlashVSR / GIMM / LTX-2 / SeedVR2 的 ComfyUI 视频增强镜像,一键批量补帧、放大、细节修复。

LTXComfyUI数字人

LTX-2.3-GGUF-图片数字人

10

10@刘悦的技术博客

认证作者

认证作者 175

175 324H

324H更新时间:2026-03-18

支持自启动

支持自启动LTX-2.3-GGUF-图片数字人-无限时长,更好的一致性,8步采样,支持50系,自定义分辨率,自动补帧,自动提示词,批量任务队列

LTX-2.3-GGUF-图片数字人-无限时长,更好的一致性,8步采样,支持50系,自定义分辨率,自动补帧,自动提示词,批量任务队列

ComfyUILTX视频生成

LTX-2.3-GGUF-图生视频

22

22@刘悦的技术博客

认证作者

认证作者 323

323 531H

531H更新时间:2026-03-18

支持自启动

支持自启动LTX-2.3-GGUF-图生视频-无限时长,更好的一致性,8步采样,自定义分辨率,自动补帧,自动提示词,批量任务队列

LTX-2.3-GGUF-图生视频-无限时长,更好的一致性,8步采样,自定义分辨率,自动补帧,自动提示词,批量任务队列

Lora训练推理框架文本模型

大模型微调部署测评_LLaMa-Factory>vLLM>opencompass

1

1@影赤

23

23 133H

133H更新时间:2026-03-10

大模型微调部署测评全流程环境已安装

大模型微调部署测评全流程环境已安装

ComfyUILTXWan

图片-声音-视频Comfyui全量整合包-LTX2.3-Wan2.2-Z-Image-Turbo漫剧全能助手

55

55@老徐Ai研习社

认证作者

认证作者 548

548 3243H

3243H更新时间:2026-03-10

支持自启动

支持自启动漫剧全能助手

漫剧全能助手

ComfyUIQwen-Image图片编辑

FireRed-ImageEdit-V1.1-GGUF

19

19@刘悦的技术博客

认证作者

认证作者 147

147 196H

196H更新时间:2026-03-18

支持自启动

支持自启动FireRed-ImageEdit-V1.1-GGUF,局部重绘,图像编辑,4步采样,多图编辑,支持50系,自定义分辨率

FireRed-ImageEdit-V1.1-GGUF,局部重绘,图像编辑,4步采样,多图编辑,支持50系,自定义分辨率

LTXComfyUI视频生成

LTX-2.3 开源音视频一体生成模型|文生视频+图生视频

11

11@AI-KSK

认证作者

认证作者 118

118 361H

361H更新时间:2026-03-10

基于 LTX-2.3 的音视频一体生成模型镜像,支持文生视频、图生视频等常见生成方式

基于 LTX-2.3 的音视频一体生成模型镜像,支持文生视频、图生视频等常见生成方式

Lora训练

Z-Image 模型一站式训练 & 推理-None_Z-trainer

5

5@zypAIGC

26

26 9H

9H更新时间:2026-03-06

支持自启动

支持自启动Z-Image 模型一站式训练 & 推理-None_Z-trainer

Z-Image 模型一站式训练 & 推理-None_Z-trainer

ComfyUIWan视频生成

Wan2.2-SmoothMixV20-SVI2-VBVR,图生视频,无限时长,自动补帧,8步采样,无须手动复制粘贴节点,,支持批量任务,Comfyui

34

34@刘悦的技术博客

认证作者

认证作者 397

397 841H

841H更新时间:2026-03-06

支持自启动

支持自启动Wan2.2-SmoothMixV20-SVI2-VBVR,图生视频,无限时长,自动补帧,8步采样,无须手动复制粘贴节点,,支持批量任务,Comfyui

Wan2.2-SmoothMixV20-SVI2-VBVR,图生视频,无限时长,自动补帧,8步采样,无须手动复制粘贴节点,,支持批量任务,Comfyui

Lora训练

diffusion-pipe+ai-toolkit丹炉

3

3@zypAIGC

6

6 10H

10H更新时间:2026-03-06

支持自启动

支持自启动diffusion-pipe+ai-toolkit

diffusion-pipe+ai-toolkit

ComfyUIZ-Image图片生成

Qwen3-4b-Z-Image-Engineer,文生图,图生图,洗图,6G显存可用,局部重绘,自动提示词,支持50系,批量任务队列

27

27@刘悦的技术博客

认证作者

认证作者 300

300 543H

543H更新时间:2026-03-10

支持自启动

支持自启动Qwen3-4b-Z-Image-Engineer,文生图,图生图,洗图,6G显存可用,局部重绘,自动提示词,支持50系,批量任务队列

Qwen3-4b-Z-Image-Engineer,文生图,图生图,洗图,6G显存可用,局部重绘,自动提示词,支持50系,批量任务队列

视频生成

SoulX-FlashTalk数字人视频图片生成ai数字人说话数字人 webui二次开发 构建by'科哥

3

3@鸡你太美

认证作者

认证作者 0

0 0H

0H更新时间:2026-04-27

支持自启动

支持自启动SoulX-FlashTalk数字人视频图片生成ai数字人说话数字人 webui二次开发 构建by科哥

SoulX-FlashTalk数字人视频图片生成ai数字人说话数字人 webui二次开发 构建by科哥

生物信息分子动力

RFantibody

0

0@苍耳阿猫

认证作者

认证作者 1

1 0H

0H更新时间:2026-03-03

RFantibody

RFantibody

AI应用

OpenClaw / ClawdBot

20

20@优云智算

497

497 10992H

10992H更新时间:2026-03-16

OpenClaw 2026.3.2版本,支持飞书、Telegram接入,支持优云智算模型API

OpenClaw 2026.3.2版本,支持飞书、Telegram接入,支持优云智算模型API

数字人WanLTX

SoulX-FlashHead-图片数字人,支持贴回全身数字人,低配版InfiniteTalk,唱歌数字人,支持长视频

16

16@刘悦的技术博客

认证作者

认证作者 109

109 170H

170H更新时间:2026-03-03

支持自启动

支持自启动SoulX-FlashHead-图片数字人,支持贴回全身数字人,低配版InfiniteTalk,唱歌数字人,支持长视频

SoulX-FlashHead-图片数字人,支持贴回全身数字人,低配版InfiniteTalk,唱歌数字人,支持长视频

Qwen

Qwen3.5_35b_a3b_Q4_K_M

3

3@

44

44 316H

316H更新时间:2026-03-02

qwen3.5

qwen3.5

ComfyUIWan视频生成

Wan2.2双增强:UnifiedReward让文生视频更符合审美预期,VBVR让图生视频更符合真实运动逻辑

9

9@AI-KSK

认证作者

认证作者 177

177 410H

410H更新时间:2026-03-06

这个镜像内置 Wan2.2 两套增强技术:UnifiedReward 让文生视频更好看、更符合偏好,VBVR 让图生视频动作更合理、更符合逻辑。

这个镜像内置 Wan2.2 两套增强技术:UnifiedReward 让文生视频更好看、更符合偏好,VBVR 让图生视频动作更合理、更符合逻辑。

语音识别Qwen3-TTS语音分离

Qwen3-ASR-1.7B,语音转文字字幕,视频转字幕,支持50系显卡,批量任务,支持热词控制

8

8@刘悦的技术博客

认证作者

认证作者 72

72 211H

211H更新时间:2026-02-27

支持自启动

支持自启动Qwen3-ASR-1.7B,语音转文字字幕,视频转字幕,支持50系显卡,批量任务,支持热词控制

Qwen3-ASR-1.7B,语音转文字字幕,视频转字幕,支持50系显卡,批量任务,支持热词控制

InfiniteTalk其他数字人

life学员

4

4@life

34

34 191H

191H更新时间:2026-02-28

life学员专用数字人镜像

life学员专用数字人镜像

ComfyUIWan视频生成

Comfy漫画上色DasiWa视频支持自由拉取C站模型更新等

7

7@梦影Erislia

63

63 258H

258H更新时间:2026-02-27

Comfy漫画上色DasiWa视频支持自由拉取C站模型更新等

Comfy漫画上色DasiWa视频支持自由拉取C站模型更新等

视频生成

超快视频替换背景Video-BGR

15

15@与AI同行

认证作者

认证作者 48

48 38H

38H更新时间:2026-03-31

支持自启动

支持自启动超快视频替换背景Video-BGR

超快视频替换背景Video-BGR

AI音乐AI应用SVC

SVC-Fusion_api

2

2@aiguoliuguo

认证作者

认证作者 121

121 352H

352H更新时间:2026-03-04

支持自启动

支持自启动SVC Fusion-api服务端

SVC Fusion-api服务端

数字人视频超分

HeyGem数字人最新Onnx优化版,多人同时驱动,多人指定面部驱动,接口API调用,支持50系,面部超分,推理速度1比1,唱歌数字人,批量任务

29

29@刘悦的技术博客

认证作者

认证作者 493

493 1488H

1488H更新时间:2026-03-09

支持自启动

支持自启动HeyGem数字人最新Onnx优化版,多人同时驱动,多人指定面部驱动,接口API调用,支持50系,面部超分,推理速度1比1,唱歌数字人,批量任务

HeyGem数字人最新Onnx优化版,多人同时驱动,多人指定面部驱动,接口API调用,支持50系,面部超分,推理速度1比1,唱歌数字人,批量任务

AI应用

DocCaptioner 打标器

13

13@Doc_workBox

认证作者

认证作者 124

124 211H

211H更新时间:2026-02-26

支持自启动

支持自启动Doc的打标器,支持 Qwen3vl及 API 调用

Doc的打标器,支持 Qwen3vl及 API 调用

语音合成语音识别

Ming-omni-tts-0.5B,接口API调用,支持超长文本,情感控制,中英混读,支持50系显卡

5

5@刘悦的技术博客

认证作者

认证作者 38

38 326H

326H更新时间:2026-02-25

支持自启动

支持自启动 Ming-omni-tts-0.5B,接口API调用,支持超长文本,情感控制,中英混读,支持50系显卡

Ming-omni-tts-0.5B,接口API调用,支持超长文本,情感控制,中英混读,支持50系显卡

语音识别

FireRedASR2S语音识别转文字语音转文本音频转文本模型ai系统 二次构建开发 by科哥

2

2@鸡你太美

认证作者

认证作者 20

20 7H

7H更新时间:2026-04-27

支持自启动

支持自启动FireRedASR2S语音识别转文字语音转文本音频转文本模型ai系统 二次构建开发 by科哥

FireRedASR2S语音识别转文字语音转文本音频转文本模型ai系统 二次构建开发 by科哥

ComfyUI视频生成Wan

终极角色动画合集镜像Wan 2.2、SCAIL、SteadyDancer、OneToAll 和VACE Phantom

15

15@AI-KSK

认证作者

认证作者 41

41 28H

28H更新时间:2026-02-26

Wan 2.2、SCAIL、SteadyDancer、OneToAll 和VACE_Skyreels_V3_R2V的“五合一”整合镜像

Wan 2.2、SCAIL、SteadyDancer、OneToAll 和VACE_Skyreels_V3_R2V的“五合一”整合镜像

目标检测

羊羊小栈-YOLO目标检测大模型分析系统

1

1@

11

11 104H

104H更新时间:2026-02-25

支持自启动

支持自启动YOLO模型训练

YOLO模型训练

语音合成

AudioX 统一音频生成平台通过一段提示词一段视频推理一段配音音效 webui汉化构建by科哥

1

1@鸡你太美

认证作者

认证作者 22

22 56H

56H更新时间:2026-04-27

支持自启动

支持自启动AudioX 统一音频生成平台通过一段提示词一段视频推理一段配音音效 webui汉化构建by科哥

AudioX 统一音频生成平台通过一段提示词一段视频推理一段配音音效 webui汉化构建by科哥

文本模型行业模型推理框架

HunYuan-MT-7B-abliterated,40种多国语言无限制双向翻译,长文本翻译,字幕翻译,双语字幕,腾讯开源,不文明用语翻译

2

2@刘悦的技术博客

认证作者

认证作者 11

11 6H

6H更新时间:2026-02-25

支持自启动

支持自启动HunYuan-MT-7B-abliterated,40种多国语言无限制双向翻译,长文本翻译,字幕翻译,双语字幕,腾讯开源,不文明用语翻译

HunYuan-MT-7B-abliterated,40种多国语言无限制双向翻译,长文本翻译,字幕翻译,双语字幕,腾讯开源,不文明用语翻译

ComfyUIQwen-Image图片编辑

FireRed-ImageEdit,图像编辑,多图编辑,支持50系,自定义分辨率,自动提示词,批量任务队列,基于Comfyui

23

23@刘悦的技术博客

认证作者

认证作者 257

257 455H

455H更新时间:2026-02-25

支持自启动

支持自启动FireRed-ImageEdit,图像编辑,多图编辑,支持50系,自定义分辨率,自动提示词,批量任务队列,基于Comfyui

FireRed-ImageEdit,图像编辑,多图编辑,支持50系,自定义分辨率,自动提示词,批量任务队列,基于Comfyui

图片生成AI应用

BitDance-14B高速自回归生图模型,自启动WebUI版测试镜像

0

0@AI-KSK

认证作者

认证作者 24

24 32H

32H更新时间:2026-02-25

支持自启动

支持自启动BitDance-14B自启动 WebUI 测试镜像:开箱即用、中文可用、512/1024 双分辨率支持,面向高效验证与稳定出图。

BitDance-14B自启动 WebUI 测试镜像:开箱即用、中文可用、512/1024 双分辨率支持,面向高效验证与稳定出图。

AI音乐语音识别

SoulX-Singer歌曲翻唱 带官方Midi编辑器

5

5@鹄仙

认证作者

认证作者 50

50 38H

38H更新时间:2026-03-20

SoulX-Singer歌曲翻唱 带官方Midi编辑器完成精细翻唱编辑

SoulX-Singer歌曲翻唱 带官方Midi编辑器完成精细翻唱编辑

语音合成Qwen3-TTS

Qwen3-TTS-AllinOne

38

38@刘悦的技术博客

认证作者

认证作者 430

430 1560H

1560H更新时间:2026-02-27

支持自启动

支持自启动Qwen3-TTS-AllinOne,多音字控制,英文数字发音纠正,批量任务,音色保存,接口API调用,支持超长文本,语速调节,文字转语音,TTS

Qwen3-TTS-AllinOne,多音字控制,英文数字发音纠正,批量任务,音色保存,接口API调用,支持超长文本,语速调节,文字转语音,TTS

图片生成视频生成

Penguin-Magic一个图片视频API在线生成的无限画布的批量生成工作流开源项目 构建by科哥

1

1@鸡你太美

认证作者

认证作者 6

6 13H

13H更新时间:2026-04-27

支持自启动

支持自启动Penguin-Magic一个图片视频API在线生成的无限画布的批量生成工作流开源项目 构建by科哥 版权属于原作者

Penguin-Magic一个图片视频API在线生成的无限画布的批量生成工作流开源项目 构建by科哥 版权属于原作者

数字人

LiveTalking_GPT-SOVITS-V2_Ollama_洛曦AI数字人

26

26@Ikaros

68

68 661H

661H更新时间:2026-02-24

LiveTalking + GPT-SOVITS V2 + Ollama + FunASR 洛曦AI定制版,实时语音对话数字人 + 直播版数字人

LiveTalking + GPT-SOVITS V2 + Ollama + FunASR 洛曦AI定制版,实时语音对话数字人 + 直播版数字人

视频超分

最快AI视频高清修复FlashVSR-支持批量生成

120

120@与AI同行

认证作者

认证作者 2195

2195 9002H

9002H更新时间:2026-03-31

支持自启动

支持自启动最快AI视频高清修复FlashVSR

最快AI视频高清修复FlashVSR

语音合成语音分离AI音乐

SoulX-Singer

14

14@刘悦的技术博客

认证作者

认证作者 87

87 69H

69H更新时间:2026-02-27

支持自启动

支持自启动SoulX-Singer,零样本变声器,AI歌曲翻唱,歌词修改,改歌词,语音内容修改

SoulX-Singer,零样本变声器,AI歌曲翻唱,歌词修改,改歌词,语音内容修改

ComfyUIWanQwen-Image

ComfyUI云端整合包2602

20

20@鹄仙

认证作者

认证作者 218

218 1108H

1108H更新时间:2026-02-13

全面升级到torch2.10+cu130

全面升级到torch2.10+cu130

音乐语音分离语音识别

AI音乐制作项目ACE-Step-1.5官方包

9

9@鹄仙

认证作者

认证作者 80

80 576H

576H更新时间:2026-02-25

专业级别的AI音乐制作项目

专业级别的AI音乐制作项目

AI音乐

ACE-Step-1.5,AI歌曲生成,男女对唱,纯音乐生成

11

11@刘悦的技术博客

认证作者

认证作者 53

53 118H

118H更新时间:2026-02-25

支持自启动

支持自启动ACE-Step-1.5,AI歌曲生成,男女对唱,纯音乐生成

ACE-Step-1.5,AI歌曲生成,男女对唱,纯音乐生成

3D生成

UltraShape-1.0

1

1@苍耳阿猫

认证作者

认证作者 21

21 35H

35H更新时间:2026-02-25

UltraShape-1.0

UltraShape-1.0

AI应用视频生成视频编辑

LingBot-World

0

0@敢敢のwings

认证作者

认证作者 16

16 67H

67H更新时间:2026-02-25

蚂蚁集团旗下具身智能公司灵波科技(Robbyant)正式开源了其世界模型 LingBot-World。这一消息发布后迅速登顶全球社交媒体热榜,引发了人工智能领域的广泛关注

蚂蚁集团旗下具身智能公司灵波科技(Robbyant)正式开源了其世界模型 LingBot-World。这一消息发布后迅速登顶全球社交媒体热榜,引发了人工智能领域的广泛关注

视频生成

最强AI生成数字人,InfiniteTalk官方版 v260209

20

20@与AI同行

认证作者

认证作者 409

409 2594H

2594H更新时间:2026-03-31

支持自启动

支持自启动最强AI生成数字人,InfiniteTalk官方版 v260209,支持图片数字人,支持超长视频、批量队列生成!

最强AI生成数字人,InfiniteTalk官方版 v260209,支持图片数字人,支持超长视频、批量队列生成!

ComfyUIIndexTTSWan

comfyui工作站

13

13@AI绘视玩家

131

131 821H

821H更新时间:2026-02-10

支持自启动

支持自启动集成图片生成|视频生成|数字人|声音编辑|音乐生成!配套Comfyui批量管理生成软件到(B站)【AI绘视玩家】处获取~

集成图片生成|视频生成|数字人|声音编辑|音乐生成!配套Comfyui批量管理生成软件到(B站)【AI绘视玩家】处获取~

ComfyUIWan数字人

Comfyui2月最新整合包,含最新klein、Z-image全系、WAN全系、LTX2.0等

62

62@老许爱吃肉丶

336

336 1472H

1472H更新时间:2026-02-25

支持自启动

支持自启动自用!Comfyui2月最新整合包,含最新klein、Z-image全系、WAN全系、LTX2.0等

自用!Comfyui2月最新整合包,含最新klein、Z-image全系、WAN全系、LTX2.0等

语音合成AI音乐

ACE-Step-1.5官方原版,修复吞歌词问题,音乐重构,音乐重绘,AI歌曲生成,男女对唱,纯音乐生成,相关竞品:DiffRhythm/yuE/HeartMuLa

6

6@刘悦的技术博客

认证作者

认证作者 39

39 27H

27H更新时间:2026-02-25

支持自启动

支持自启动ACE-Step-1.5官方原版,修复吞歌词问题,音乐重构,音乐重绘,AI歌曲生成,男女对唱,纯音乐生成,相关竞品:DiffRhythm/yuE/HeartMuLa

ACE-Step-1.5官方原版,修复吞歌词问题,音乐重构,音乐重绘,AI歌曲生成,男女对唱,纯音乐生成,相关竞品:DiffRhythm/yuE/HeartMuLa

ComfyUI视频生成数字人

LTX2-Rapid-Merges视频生成

46

46@AI-KSK

认证作者

认证作者 248

248 407H

407H更新时间:2026-02-25

包含了文生、图生、首尾帧、对口型 4 大类工作流,提供SFW/NSFW的完整体验

包含了文生、图生、首尾帧、对口型 4 大类工作流,提供SFW/NSFW的完整体验

其他

ROX Quant 3.0 - 量化投研系统可无卡模式运行 投资有风险交易须谨慎

4

4@鸡你太美

认证作者

认证作者 11

11 33H

33H更新时间:2026-04-27

支持自启动

支持自启动ROX Quant 3.0 - 量化投研系统可无卡模式运行 投资有风险交易须谨慎

ROX Quant 3.0 - 量化投研系统可无卡模式运行 投资有风险交易须谨慎

语音合成语音克隆

【Qwen3TTS】声音克隆 音色定制 长文本推理优化镜像

16

16@两只鸽子

195

195 325H

325H更新时间:2026-02-25

支持自启动

支持自启动Qwen3TTS推理镜像

Qwen3TTS推理镜像

InfiniteTalk数字人

InfiniteTalk数字人最新官方更新,上下文循环,一致性和速度优化,4步采样,高清放大,批量任务队列,基于comfyui,工作流

40

40@刘悦的技术博客

认证作者

认证作者 534

534 778H

778H更新时间:2026-02-06

支持自启动

支持自启动InfiniteTalk数字人最新官方更新,上下文循环,一致性和速度优化,4步采样,高清放大,批量任务队列,基于comfyui,工作流

InfiniteTalk数字人最新官方更新,上下文循环,一致性和速度优化,4步采样,高清放大,批量任务队列,基于comfyui,工作流

ComfyUI

ComfyUI-建筑效果图

2

2@

10

10 168H

168H更新时间:2026-02-06

支持自启动

支持自启动用于建筑效果图的生成与编辑

用于建筑效果图的生成与编辑

语音合成AI音乐

K哥配音工作室(indextts2音色克隆+qwen3-tts音色生成+HeartMuLay音乐生成)

15

15@K哥讲AI

282

282 625H

625H更新时间:2026-02-05

支持自启动

支持自启动多功能配音镜像,融合 indextts2.qwen3-tts音色克隆 HeartMuLa音乐生成,支持多角色配音、文本创音色、一键克隆、音乐一键生成,还有 AI 角色分配.基础音色库及多语言.方言配音

多功能配音镜像,融合 indextts2.qwen3-tts音色克隆 HeartMuLa音乐生成,支持多角色配音、文本创音色、一键克隆、音乐一键生成,还有 AI 角色分配.基础音色库及多语言.方言配音

ComfyUILTX

ComfyUI云端整合包LTX-2特别版

19

19@鹄仙

认证作者

认证作者 55

55 200H

200H更新时间:2026-02-12

支持LTX-2 scail wan2.2系列

支持LTX-2 scail wan2.2系列

图片生成Z-Image

red-Z-Image-Base,15步采样,自定义分辨率,文生图,图生图,自动提示词,批量任务

17

17@刘悦的技术博客

认证作者

认证作者 198

198 102H

102H更新时间:2026-02-04

支持自启动

支持自启动red-Z-Image-Base,15步采样,自定义分辨率,文生图,图生图,自动提示词,批量任务

red-Z-Image-Base,15步采样,自定义分辨率,文生图,图生图,自动提示词,批量任务

Qwen语音识别

Qwen-ASR

0

0@有黑眼圈的小竹熊

18

18 61H

61H更新时间:2026-02-04

Qwen3-ASR 系列包括 Qwen3-ASR-1.7B 和 Qwen3-ASR-0.6B,支持 52 种语言和方言的语言识别与语音识别(ASR)。

Qwen3-ASR 系列包括 Qwen3-ASR-1.7B 和 Qwen3-ASR-0.6B,支持 52 种语言和方言的语言识别与语音识别(ASR)。

ComfyUILTX

LTX-2-RapID-GGUF-图生视频-无限时长

17

17@刘悦的技术博客

认证作者

认证作者 123

123 214H

214H更新时间:2026-02-04

支持自启动

支持自启动LTX-2-RapID-GGUF-图生视频-无限时长

LTX-2-RapID-GGUF-图生视频-无限时长

ComfyUILTX

LTX-2-RapID-GGUF-图片数字人-无限时长

8

8@刘悦的技术博客

认证作者

认证作者 41

41 51H

51H更新时间:2026-02-05

支持自启动

支持自启动LTX-2-RapID-GGUF-图片数字人-无限时长

LTX-2-RapID-GGUF-图片数字人-无限时长

推理框架Qwen

nano-vllm

0

0@kq123jk6n9

7

7 35H

35H更新时间:2026-02-03

从0到1,理解vllm的核心内容。包含注释讲解和使用实例,使用教程。帮助大家学习vllm

从0到1,理解vllm的核心内容。包含注释讲解和使用实例,使用教程。帮助大家学习vllm

ComfyUILTX

LTX2-视频生成最新整个大包(202602)

12

12@NiuGee

认证作者

认证作者 94

94 123H

123H更新时间:2026-02-04

支持自启动

支持自启动震惊!LTX-2开源视频模型,人人都能当导演?牛哥一键整合免费AI创作神器!

震惊!LTX-2开源视频模型,人人都能当导演?牛哥一键整合免费AI创作神器!

其他

Sora2API:一个将sora账号转为API服务接口的免费开源系统

2

2@鸡你太美

认证作者

认证作者 10

10 26H

26H更新时间:2026-04-27

支持自启动

支持自启动Sora2API:一个将sora账号转为API服务接口的免费开源系统

Sora2API:一个将sora账号转为API服务接口的免费开源系统

WanQwen-Image数字人

数字人-语音克隆-wan2.2视频换人换装-Qwen-Image-Edit2509整合包

81

81@老徐Ai研习社

认证作者

认证作者 813

813 2535H

2535H更新时间:2026-02-02

支持自启动

支持自启动数字人-语音克隆-wan2.2视频换人换装-Qwen-Image-Edit2511整合包

数字人-语音克隆-wan2.2视频换人换装-Qwen-Image-Edit2511整合包

OCR识别

LightOn-OCR-1B,图片和PDF文字提取,图文混排,实时生成MarkDown文档,MarkDown文档下载,支持PDF全量解析

1

1@刘悦的技术博客

认证作者

认证作者 12

12 0H

0H更新时间:2026-02-02

支持自启动

支持自启动LightOn-OCR-1B,图片和PDF文字提取,图文混排,实时生成MarkDown文档,MarkDown文档下载,支持PDF全量解析

LightOn-OCR-1B,图片和PDF文字提取,图文混排,实时生成MarkDown文档,MarkDown文档下载,支持PDF全量解析

FluxWanComfyUI

Bob同学的comfyui云端镜像系列

345

345@Bob同学

认证作者

认证作者 5599

5599 18048H

18048H更新时间:2026-02-01

支持自启动

支持自启动此版本内置 (Wan2.2\Flux\Kontext)系列的全部基础模型及工作流

此版本内置 (Wan2.2\Flux\Kontext)系列的全部基础模型及工作流

图片生成Z-ImageQwen-Image

最全图片编辑模型大全-qwen2511多角度工作流-flux2-klein-9b全图片编辑模型-z-image-base图片生成模型

22

22@匹夫

认证作者

认证作者 271

271 970H

970H更新时间:2026-02-04

最全图片编辑模型大全-qwen2511多角度工作流-flux2-klein-9b全图片编辑模型-z-image-base图片生成模型

最全图片编辑模型大全-qwen2511多角度工作流-flux2-klein-9b全图片编辑模型-z-image-base图片生成模型

Lora训练Z-Image

Z-Image-Base的Lora训练同时支持FluxKlein-AI-TOOLKIT

7

7@梦影Erislia

125

125 1160H

1160H更新时间:2026-02-02

Z-Image-Base的Lora训练同时支持FluxKlein-AI-TOOLKIT

Z-Image-Base的Lora训练同时支持FluxKlein-AI-TOOLKIT

Lora训练LTXWan

ai-toolkit全能Lora模型训练器

15

15@老徐Ai研习社

认证作者

认证作者 258

258 2006H

2006H更新时间:2026-02-01

支持自启动

支持自启动支持主流模型lora训练

支持主流模型lora训练

图片生成Lora训练

AI图片ZImage模型训练,一键启动WebUI、无需配置

46

46@与AI同行

认证作者

认证作者 426

426 1755H

1755H更新时间:2026-03-31

支持自启动

支持自启动AI图片ZImage模型训练,一键启动WebUI、无需配置

AI图片ZImage模型训练,一键启动WebUI、无需配置

图片生成Z-Image

Nunchaku-ZImage极速出图

4

4@Tanjie7

25

25 4H

4H更新时间:2026-01-30

ZImage Nunchaku版本,已经配置好nunchaku环境,可以直接启动使用comfyui+nunchaku zimage出图

ZImage Nunchaku版本,已经配置好nunchaku环境,可以直接启动使用comfyui+nunchaku zimage出图

ComfyUIWan视频生成

2026最新ComfyUI整合包_图片·视频·声音

20

20@老徐Ai研习社

认证作者

认证作者 225

225 3837H

3837H更新时间:2026-01-30

支持自启动

支持自启动2026最新ComfyUI整合包_图片·视频·声音

2026最新ComfyUI整合包_图片·视频·声音

图片生成Z-Image

Z-Image-Base,35步采样,文生图,图生图,自动提示词,批量任务

14

14@刘悦的技术博客

认证作者

认证作者 146

146 166H

166H更新时间:2026-01-29

支持自启动

支持自启动Z-Image-Base,35步采样,文生图,图生图,自动提示词,批量任务

Z-Image-Base,35步采样,文生图,图生图,自动提示词,批量任务

ComfyUI

Comfyui 一张照片制作一个lora训练数据集

20

20@Prompt娄

158

158 776H

776H更新时间:2026-01-29

支持自启动

支持自启动一张照片制作一个角色一致性lora训练数据集

一张照片制作一个角色一致性lora训练数据集

Z-Image图片生成

Z-Image

18

18@十字鱼

认证作者

认证作者 125

125 892H

892H更新时间:2026-01-30

支持自启动

支持自启动Z-Image是一个拥有6B参数的强大且高效的图像生成模型。

Z-Image是一个拥有6B参数的强大且高效的图像生成模型。

语音克隆

超级AI语音Qwen3-TTS合集,超强音色克隆、音色设计、情绪控制!

46

46@与AI同行

认证作者

认证作者 467

467 1114H

1114H更新时间:2026-03-31

支持自启动

支持自启动超强AI语音生成,Qwen3-TTS整合包合集!超强音色克隆、音色设计、情绪控制,支持音色保存、多音字、超长文本生成。支持批量上传多个文件生成!

超强AI语音生成,Qwen3-TTS整合包合集!超强音色克隆、音色设计、情绪控制,支持音色保存、多音字、超长文本生成。支持批量上传多个文件生成!

图片生成Z-Image

Z-Image系列,Base+Tubro反推生图放大一体化

7

7@社恐的知识树

认证作者

认证作者 44

44 182H

182H更新时间:2026-01-28

支持自启动

支持自启动阿里开源的Z-Image系列模型

阿里开源的Z-Image系列模型

DeepSeekOCR识别

DeepSeek-OCR-2

1

1@敢敢のwings

认证作者

认证作者 74

74 2863H

2863H更新时间:2026-01-29

DeepSeek-OCR 2 是 DeepSeek 团队开源的新一代 OCR 模型,该模型能够像人类一样带着逻辑去阅读文档。

DeepSeek-OCR 2 是 DeepSeek 团队开源的新一代 OCR 模型,该模型能够像人类一样带着逻辑去阅读文档。

ComfyUI

ComfyUI学习版,内置多种基础模型-MumuOpenK

24

24@MumuOpenK

505

505 9796H

9796H更新时间:2026-01-29

支持自启动

支持自启动内置多种基础模型,快速开启comfyui体验

内置多种基础模型,快速开启comfyui体验

数字人语音合成语音克隆

AI音乐、声音克隆:顶级数字人长视频套件V2

4

4@AI-KSK

认证作者

认证作者 28

28 34H

34H更新时间:2026-02-11

镜像打通HeartMuLa音乐、Qwen3-TTS音色克隆、InfiniteTalk/LongCat长对话数字人与LTX2视频:写歌配音→照片开口→长时稳成片。

镜像打通HeartMuLa音乐、Qwen3-TTS音色克隆、InfiniteTalk/LongCat长对话数字人与LTX2视频:写歌配音→照片开口→长时稳成片。

语音合成Qwen3-TTS

Qwen3-TTS语音模型, | 声音克隆 | 语音定制 | 语音预设 |

9

9@社恐的知识树

认证作者

认证作者 112

112 84H

84H更新时间:2026-01-27

阿里千问开源的最新语音类模型,显存占用小,生成速度快,支持10种主流语言。

阿里千问开源的最新语音类模型,显存占用小,生成速度快,支持10种主流语言。

AI音乐

HeartMuLa-HL,支持中文提示词,无须标签式歌词,更自然的AI歌曲生成,开源版Suno

3

3@刘悦的技术博客

认证作者

认证作者 40

40 28H

28H更新时间:2026-01-26

支持自启动

支持自启动HeartMuLa-HL,支持中文提示词,无须标签式歌词,更自然的AI歌曲生成,开源版Suno

HeartMuLa-HL,支持中文提示词,无须标签式歌词,更自然的AI歌曲生成,开源版Suno

AI音乐Qwen3-TTS

HeartMula& Qwen3TTS 歌曲生成与语音设计

0

0@鹄仙

认证作者

认证作者 11

11 2H

2H更新时间:2026-01-29

基于HeartMula和Qwen3TTS的歌曲生成与语音设计

基于HeartMula和Qwen3TTS的歌曲生成与语音设计

FluxLora训练

Flux.Klein模型Lora训练AI-Toolkit

12

12@梦影Erislia

112

112 783H

783H更新时间:2026-01-26

Flux.Klein模型Lora训练AI-Toolkit

Flux.Klein模型Lora训练AI-Toolkit

语音合成Qwen3-TTS

Qwen3-TTS-0.6B,推理速度1比0.5,音色保存,接口API调用,支持超长文本,支持50系显卡,语速调节,音频超分降噪,接入开源阅读,文字转语音,TTS

5

5@刘悦的技术博客

认证作者

认证作者 42

42 25H

25H更新时间:2026-01-26

支持自启动

支持自启动Qwen3-TTS-0.6B,推理速度1比0.5,音色保存,接口API调用,支持超长文本,支持50系显卡,语速调节,音频超分降噪,接入开源阅读,文字转语音,TTS

Qwen3-TTS-0.6B,推理速度1比0.5,音色保存,接口API调用,支持超长文本,支持50系显卡,语速调节,音频超分降噪,接入开源阅读,文字转语音,TTS

语音合成Qwen3-TTS

Qwen3-TTS-语音克隆工作流合集

5

5@匹夫

认证作者

认证作者 58

58 77H

77H更新时间:2026-01-26

Qwen3-TTS-语音克隆工作流合集

Qwen3-TTS-语音克隆工作流合集

语音合成Qwen3-TTS

Qwen3-TTS捏声音自定义声音tts语音克隆语音克隆声音flash_attn加速版Comfyui工作流版 构建by科哥

13

13@鸡你太美

认证作者

认证作者 143

143 291H

291H更新时间:2026-04-27

支持自启动

支持自启动Qwen3-TTS捏声音自定义声音tts语音克隆语音克隆声音flash_attn加速版Comfyui工作流版 构建by科哥

Qwen3-TTS捏声音自定义声音tts语音克隆语音克隆声音flash_attn加速版Comfyui工作流版 构建by科哥

语音合成Qwen3-TTS

Qwen3-TTS-1.7B,Flash-Attn加速,音色保存,接口API调用,支持超长文本,语速调节,音频超分降噪,接入开源阅读,文字转语音,TTS

7

7@刘悦的技术博客

认证作者

认证作者 108

108 167H

167H更新时间:2026-01-26

支持自启动

支持自启动Qwen3-TTS-1.7B,Flash-Attn加速,音色保存,接口API调用,支持超长文本,语速调节,音频超分降噪,接入开源阅读,文字转语音,TTS

Qwen3-TTS-1.7B,Flash-Attn加速,音色保存,接口API调用,支持超长文本,语速调节,音频超分降噪,接入开源阅读,文字转语音,TTS

OCR识别

LightOnOCR-2高效的1B参数视觉语言模型用于OCR识别pdf转文本jpg转文本图片转文本 二次开发构建by科哥

1

1@鸡你太美

认证作者

认证作者 3

3 2H

2H更新时间:2026-04-27

支持自启动

支持自启动LightOnOCR-2高效的1B参数视觉语言模型用于OCR识别pdf转文本jpg转文本图片转文本 二次开发构建by科哥

LightOnOCR-2高效的1B参数视觉语言模型用于OCR识别pdf转文本jpg转文本图片转文本 二次开发构建by科哥

Lora训练LTX

LTX2模型Lora训练AI-Toolkit

2

2@梦影Erislia

17

17 127H

127H更新时间:2026-01-24

LTX2模型Lora训练AI-Toolkit

LTX2模型Lora训练AI-Toolkit

AI音乐

HeartMuLa,AI歌曲生成,开源版Suno

8

8@刘悦的技术博客

认证作者

认证作者 14

14 9H

9H更新时间:2026-01-23

支持自启动

支持自启动HeartMuLa,AI歌曲生成,开源版Suno

HeartMuLa,AI歌曲生成,开源版Suno

AI音乐

歌曲与音效生成

3

3@老徐Ai研习社

认证作者

认证作者 18

18 6H

6H更新时间:2026-01-22

支持自启动

支持自启动HeartMula根据歌词生成音乐,根据画面生成音效

HeartMula根据歌词生成音乐,根据画面生成音效

GLM文本模型

GLM-4.7-Flash

1

1@苍耳阿猫

认证作者

认证作者 33

33 166H

166H更新时间:2026-01-22

GLM-4.7-Flash

GLM-4.7-Flash

语音识别

微软开源VibeVoice ASR TTS集合webui语音到文本 文本到语音模型 二次卡发构建by科哥

1

1@鸡你太美

认证作者

认证作者 14

14 1H

1H更新时间:2026-04-27

支持自启动

支持自启动微软开源VibeVoice ASR TTS集合webui语音到文本 文本到语音模型 二次卡发构建by科哥

微软开源VibeVoice ASR TTS集合webui语音到文本 文本到语音模型 二次卡发构建by科哥

视频生成

超强视频替换人物MoCha

64

64@与AI同行

认证作者

认证作者 412

412 532H

532H更新时间:2026-03-31

支持自启动

支持自启动最新视频替换人物,MoCha-Preview 整合包,支持视频替换人物,卡通动漫效果更佳,支持添加批量任务, 支持高清修复

最新视频替换人物,MoCha-Preview 整合包,支持视频替换人物,卡通动漫效果更佳,支持添加批量任务, 支持高清修复

GLM文本模型

智普开源GLM-4.7-Flash GGUF推理服务编程文本大模型速度很快 webui开发构建by科哥

1

1@鸡你太美

认证作者

认证作者 19

19 55H

55H更新时间:2026-04-27

支持自启动

支持自启动智普开源GLM-4.7-Flash GGUF推理服务编程文本大模型API+webui开发构建by科哥

智普开源GLM-4.7-Flash GGUF推理服务编程文本大模型API+webui开发构建by科哥

LTXLora训练

AIToolkit Ltx-2 Lora Training,4090 24G / 48G / 5090 预设多挡位支持

5

5@AI-KSK

认证作者

认证作者 59

59 374H

374H更新时间:2026-01-22

基于AI Toolkit,内置4090、48G及5090专属精调预设。告别复杂调参,只需加载对应JSON文件,即可解锁硬件最优性能,零门槛获得专家级训练方案。

基于AI Toolkit,内置4090、48G及5090专属精调预设。告别复杂调参,只需加载对应JSON文件,即可解锁硬件最优性能,零门槛获得专家级训练方案。

语音合成

indextts2-IndexTTS2 最新 V23版本的全面升级情感控制更好 构建by科哥

46

46@鸡你太美

认证作者

认证作者 1106

1106 4960H

4960H更新时间:2026-04-27

支持自启动

支持自启动V23版本的全面升级情感控制更好

V23版本的全面升级情感控制更好

语音合成

NovaSR一个开源的音频超分辨率模型低音质转高清音质声音修复模型 webui开发构建by科哥

0

0@鸡你太美

认证作者

认证作者 11

11 3H

3H更新时间:2026-04-27

支持自启动

支持自启动NovaSR一个开源的音频超分辨率模型低音质转高清音质声音修复模型 webui开发构建by科哥

NovaSR一个开源的音频超分辨率模型低音质转高清音质声音修复模型 webui开发构建by科哥

行业模型

sinong南京农业大学开源面向通用农业领域的垂直8B32B全离线模型 webui开发构建by科哥

0

0@鸡你太美

认证作者

认证作者 0

0 0H

0H更新时间:2026-04-27

支持自启动

支持自启动sinong南京农业大学开源面向通用农业领域的垂直8B32B全离线模型 webui开发构建by科哥

sinong南京农业大学开源面向通用农业领域的垂直8B32B全离线模型 webui开发构建by科哥

生物信息行业模型

谷歌最新开源MedGemma医学AI助手 问诊问病例查看CT拍片x光拍片病理答疑问 webui开发构建by科哥

0

0@鸡你太美

认证作者

认证作者 12

12 40H

40H更新时间:2026-04-27

支持自启动

支持自启动谷歌最新开源MedGemma医学AI助手 问诊问病例查看CT拍片x光拍片病理答疑问 webui开发构建by科哥

谷歌最新开源MedGemma医学AI助手 问诊问病例查看CT拍片x光拍片病理答疑问 webui开发构建by科哥

图片生成GLM

GLM-Image

1

1@十字鱼

认证作者

认证作者 17

17 4H

4H更新时间:2026-01-19

支持自启动

支持自启动智谱开源图像生成和编辑模型

智谱开源图像生成和编辑模型

视频超分

sora2视频二次高清工作流视频高清修复flashvsr工作流Comfyui工作流 构建by科哥

7

7@鸡你太美

认证作者

认证作者 69

69 27H

27H更新时间:2026-04-27

支持自启动

支持自启动sora2视频二次高清工作流视频高清修复flashvsr工作流Comfyui工作流 构建by科哥

sora2视频二次高清工作流视频高清修复flashvsr工作流Comfyui工作流 构建by科哥

图片生成Qwen-image

超强AI图片编辑,QwenEdit-2511合集,单图/双图编辑, 超强人脸一致性,精准涂抹编辑、无色差/位移,一键生成24张姿势图、九宫格分镜

83

83@与AI同行

认证作者

认证作者 1008

1008 2812H

2812H更新时间:2026-03-31

支持自启动

支持自启动超强AI图片编辑,QwenEdit-2511合集,单图/双图编辑, 超强人脸一致性,精准涂抹编辑、无色差/位移,一键生成24张姿势图、九宫格分镜

超强AI图片编辑,QwenEdit-2511合集,单图/双图编辑, 超强人脸一致性,精准涂抹编辑、无色差/位移,一键生成24张姿势图、九宫格分镜

FluxComfyUI图片生成

FLUX2-Klein-黑森林开源最强编辑模型,秒级生图,效果可控!

15

15@社恐的知识树

认证作者

认证作者 129

129 254H

254H更新时间:2026-01-19

黑森林团队开源的FLUX2-Klein多功能模型,生成速度快,编辑能力强!

黑森林团队开源的FLUX2-Klein多功能模型,生成速度快,编辑能力强!

行业模型

谷歌最新翻译模型TranslateGemma支持全世界50多种语言的翻译文本多语言翻译 二次webui开发 构建by科哥

0

0@鸡你太美

认证作者

认证作者 4

4 0H

0H更新时间:2026-04-27

支持自启动

支持自启动谷歌最新翻译模型TranslateGemma支持全世界50多种语言的翻译文本多语言翻译 二次webui开发 构建by科哥

谷歌最新翻译模型TranslateGemma支持全世界50多种语言的翻译文本多语言翻译 二次webui开发 构建by科哥

图片生成AI电商

BananaMall一个 AI 驱动的电商详情页生成的ai工具结合谷歌nano banana谷歌香蕉模型 开发构建by科哥

11

11@鸡你太美

认证作者

认证作者 49

49 83H

83H更新时间:2026-04-27

支持自启动

支持自启动BananaMall一个 AI 驱动的电商详情页生成的ai工具结合谷歌nano banana谷歌香蕉模型 开发构建by科哥

BananaMall一个 AI 驱动的电商详情页生成的ai工具结合谷歌nano banana谷歌香蕉模型 开发构建by科哥

Z-Image图片生成

全能图片编辑王flux2_klein|Qwen_Image_Edit2511|Z-image-turbo

24

24@老徐Ai研习社

认证作者

认证作者 195

195 1744H

1744H更新时间:2026-01-21

支持自启动

支持自启动全能图片生成与编辑

全能图片生成与编辑

目标检测

YOLO26

4

4@苍耳阿猫

认证作者

认证作者 37

37 941H

941H更新时间:2026-01-16

YOLO26

YOLO26

具身智能

Alpamayo

1

1@苍耳阿猫

认证作者

认证作者 6

6 32H

32H更新时间:2026-01-20

Alpamayo 1 是一个预训练推理模型,旨在加速自动驾驶(AV)领域的研发。

Alpamayo 1 是一个预训练推理模型,旨在加速自动驾驶(AV)领域的研发。

音乐

NotaGen基于 LLM 范式的高音乐性古典符号化音乐生成模型 二次开发构建by科哥

1

1@鸡你太美

认证作者

认证作者 9

9 11H

11H更新时间:2026-04-27

支持自启动

支持自启动NotaGen基于 LLM 范式的高音乐性古典符号化音乐生成模型 二次开发构建by科哥

NotaGen基于 LLM 范式的高音乐性古典符号化音乐生成模型 二次开发构建by科哥

Wan图片生成视频生成

闪电AI视频、图片生成镜像

9

9@cola

54

54 55H

55H更新时间:2026-01-16

支持自启动

支持自启动基于lightx2v框架加速的视频、图片生成服务,快速生成视频图片,基于模型wan2.2、qwen-image、z-image

基于lightx2v框架加速的视频、图片生成服务,快速生成视频图片,基于模型wan2.2、qwen-image、z-image

Wan视频生成ComfyUI

DaSiWa & Remix:Wan 2.2 双神N版

34

34@AI-KSK

认证作者

认证作者 311

311 829H

829H更新时间:2026-01-16

本镜像高度集成 Wan 2.2 视频生成环境,预装社区领先四套核心工作流,融合 DaSiWa 高保真与 Remix 逻辑优化,提供一站式 T2V 文生视频与 I2V 图生视频解决方案。

本镜像高度集成 Wan 2.2 视频生成环境,预装社区领先四套核心工作流,融合 DaSiWa 高保真与 Remix 逻辑优化,提供一站式 T2V 文生视频与 I2V 图生视频解决方案。

LTX视频生成

LTX-2 Audio-Video:开源首个 · 音画同步生成

14

14@AI-KSK

认证作者

认证作者 132

132 326H

326H更新时间:2026-01-21

双官方流程全覆盖:同时支持 ComfyUI 官方 LTX 工作流示例 + Lightricks 官方 ComfyUI-LTXVideo 自定义节点与全部示例工作流

双官方流程全覆盖:同时支持 ComfyUI 官方 LTX 工作流示例 + Lightricks 官方 ComfyUI-LTXVideo 自定义节点与全部示例工作流

语音合成AI应用

voice pro给视频做多语言配音翻译克隆特定视频声音 直译视频声音本地化 汉化构建by科哥

6

6@鸡你太美

认证作者

认证作者 25

25 11H

11H更新时间:2026-04-27

支持自启动

支持自启动voice pro给视频做多语言配音翻译克隆特定视频声音 直译视频声音本地化 汉化构建by科哥

voice pro给视频做多语言配音翻译克隆特定视频声音 直译视频声音本地化 汉化构建by科哥

LTXLora训练

LTX2官方训练器Lora训练

1

1@梦影Erislia

28

28 109H

109H更新时间:2026-01-21

LTX2官方训练器的lora训练支持,内置模型t2v,小白可以一键运行,也可以根据官方文档进行进阶操作

LTX2官方训练器的lora训练支持,内置模型t2v,小白可以一键运行,也可以根据官方文档进行进阶操作

LTX视频生成

ltx-2全能lora运镜comfyui工作流文生视频图生视频一键运行 构建by科哥

6

6@鸡你太美

认证作者

认证作者 44

44 29H

29H更新时间:2026-04-27

支持自启动

支持自启动ltx-2全能lora运镜comfyui工作流文生视频图生视频一键运行 构建by科哥

ltx-2全能lora运镜comfyui工作流文生视频图生视频一键运行 构建by科哥

Qwen-Image

Tongbi-支持Qwen-Image和Qwen-Image-Edit

44

44@十字鱼

认证作者

认证作者 254

254 8033H

8033H更新时间:2026-02-02

支持自启动

支持自启动阿里通义千问开源最强图像模型,强大的文字渲染能力,强大的图像编辑能力

阿里通义千问开源最强图像模型,强大的文字渲染能力,强大的图像编辑能力

视频生成Wan

TurboDiffusion清华大学等推出的视频生成加速框架 webUI二次修改构建by科哥

3

3@鸡你太美

认证作者

认证作者 48

48 42H

42H更新时间:2026-04-27

支持自启动

支持自启动实现将ai视频生成速度提升百倍!基于wan2.1,wan2.2

实现将ai视频生成速度提升百倍!基于wan2.1,wan2.2

其他

nano banana谷歌香蕉在线绘画在线改图修改图片模型香蕉模型

3

3@鸡你太美

认证作者

认证作者 62

62 15H

15H更新时间:2026-04-27

支持自启动

支持自启动nano banana谷歌香蕉在线绘画在线改图修改图片模型香蕉模型

nano banana谷歌香蕉在线绘画在线改图修改图片模型香蕉模型

语音合成

【音谷官方】indextts2-api

83

83@音谷官方

1967

1967 7890H

7890H更新时间:2026-04-27

支持自启动

支持自启动【音谷官方】音谷对应的API

【音谷官方】音谷对应的API

LTX视频生成

LTX-2 WebUI版

6

6@鹄仙

认证作者

认证作者 43

43 40H

40H更新时间:2026-01-10

基于wangp的LTX-2,WebUI版

基于wangp的LTX-2,WebUI版

视频生成

开源版Veo3!LTX2-视频生成合集,文生视频、图生视频、视频人物配音+口型同步、直出1080P,高清细节放大、提示词增强、支持线条+深度+姿势控制!

55

55@与AI同行

认证作者

认证作者 289

289 190H

190H更新时间:2026-03-31

支持自启动

支持自启动开源版Veo3!LTX2-视频生成合集,文生视频、图生视频、视频人物配音+口型同步、直出1080P,高清细节放大、提示词增强、支持线条+深度+姿势控制!

开源版Veo3!LTX2-视频生成合集,文生视频、图生视频、视频人物配音+口型同步、直出1080P,高清细节放大、提示词增强、支持线条+深度+姿势控制!

LTXComfyUI数字人

LTX-2:首个开源音画同步生成模型,提示词遵从比肩Sora,理解分镜脚本,一键AI成片!

8

8@社恐的知识树

认证作者

认证作者 40

40 45H

45H更新时间:2026-01-22

LTX-2 是由 Lightricks 开源的 DiT 架构音频-视频基础模型,核心特点是:在同一个模型里同步生成视频与音频,超强提示词理解,支持多镜头脚本,关键词自动匹配视频风格,一键AI成片!

LTX-2 是由 Lightricks 开源的 DiT 架构音频-视频基础模型,核心特点是:在同一个模型里同步生成视频与音频,超强提示词理解,支持多镜头脚本,关键词自动匹配视频风格,一键AI成片!

语音合成

Voice Sculptor捏声音基于LLaSA和CosyVoice2的指令化语音合成语音模型 二次开发构建by科哥

4

4@鸡你太美

认证作者

认证作者 17

17 4H

4H更新时间:2026-04-27

支持自启动

支持自启动Voice Sculptor捏声音基于LLaSA和CosyVoice2的指令化语音合成语音模型 二次开发构建by科哥

Voice Sculptor捏声音基于LLaSA和CosyVoice2的指令化语音合成语音模型 二次开发构建by科哥

Qwen-Image图片生成ComfyUI

LTX-2.0音画同步视频生成|Z-Image-Turbo&Qwen-Image-Edit1图片编辑

12

12@老徐Ai研习社

认证作者

认证作者 61

61 66H

66H更新时间:2026-02-05

支持自启动

支持自启动LTX-2.0音画同步视频生成

LTX-2.0音画同步视频生成

ComfyUIWan

Comfy二次元跑图生视频DaSiWa和vace跳舞

19

19@梦影Erislia

151

151 303H

303H更新时间:2026-01-22

Comfy二次元跑图生视频DaSiWa和vace跳舞

Comfy二次元跑图生视频DaSiWa和vace跳舞

语音识别

SenseVoice多语言语音识别情感识别系统 二次开发构建by科哥

2

2@鸡你太美

认证作者

认证作者 10

10 7H

7H更新时间:2026-04-27

支持自启动

支持自启动SenseVoice多语言语音识别情感识别系统 二次开发构建by科哥

SenseVoice多语言语音识别情感识别系统 二次开发构建by科哥

语音识别

FunASR中文语音识别音频转文本声音转文本系统 二次webui开发构建by科哥

2

2@鸡你太美

认证作者

认证作者 21

21 7H

7H更新时间:2026-04-27

支持自启动

支持自启动音频声音识别系统

音频声音识别系统

语音分离

SAM Audio一个Meta开源的音频分割模型声音分离音频音乐分离应用 二次开发构建by科哥

2

2@鸡你太美

认证作者

认证作者 35

35 34H

34H更新时间:2026-04-27

支持自启动

支持自启动可从复杂的音频混合中分离出特定的声音

可从复杂的音频混合中分离出特定的声音

图片编辑

UNet Universal Matting基于UNet模型抠图批量抠图 webUI一键抠图 构建by科哥

0

0@鸡你太美

认证作者

认证作者 12

12 34H

34H更新时间:2026-04-27

支持自启动

支持自启动基于UNet模型抠图批量抠图 webUI一键抠图 构建by科哥

基于UNet模型抠图批量抠图 webUI一键抠图 构建by科哥

ComfyUI

ComfyUI_最新26年01月-Niugee-牛哥整合包-V2

20

20@NiuGee

认证作者

认证作者 243

243 528H

528H更新时间:2026-01-08

整合26年最新版本ComfyUI,已下载好常用图像模型,修改端口到7860方便管理界面一键启动

整合26年最新版本ComfyUI,已下载好常用图像模型,修改端口到7860方便管理界面一键启动

视频生成

最强AI生成长视频,Wan2.2-SVI2Pro整合包!一次性生成一分钟视频,一次性生成30s分镜视频!

49

49@与AI同行

认证作者

认证作者 348

348 1469H

1469H更新时间:2026-03-31

支持自启动

支持自启动最强AI生成长视频,Wan2.2-SVI2Pro整合包!一次性生成一分钟视频,一次性生成30s分镜视频!

最强AI生成长视频,Wan2.2-SVI2Pro整合包!一次性生成一分钟视频,一次性生成30s分镜视频!

ComfyUI

ComfyUI云端整合包2601

7

7@鹄仙

认证作者

认证作者 67

67 347H

347H更新时间:2026-01-23

长视频系列升级 不仅仅是SVI2 pro 长视频、LongCat数字人

长视频系列升级 不仅仅是SVI2 pro 长视频、LongCat数字人

Qwen-ImageLora训练图片生成

Qwen 2512的Lora训练,内置模型,一键训练AI-Toolkit

9

9@梦影Erislia

109

109 575H

575H更新时间:2026-01-23

Qwen 2512的Lora训练,内置模型,一键训练AI-Toolkit

Qwen 2512的Lora训练,内置模型,一键训练AI-Toolkit

AI应用

banana-slides基于谷歌人工智能ai制作幻灯片ai制作ppt制作幻灯片 构建by科哥

3

3@鸡你太美

认证作者

认证作者 15

15 86H

86H更新时间:2026-04-27

支持自启动

支持自启动banana-slides基于谷歌人工智能ai制作幻灯片ai制作ppt制作幻灯片 构建by科哥

banana-slides基于谷歌人工智能ai制作幻灯片ai制作ppt制作幻灯片 构建by科哥

Qwen-Image图片生成ComfyUI

Qwen-Image-2512模型_QwenVL3反推_SeedVR2放大多合一

6

6@社恐的知识树

认证作者

认证作者 83

83 193H

193H更新时间:2026-01-03

集成千问图像2512模型+QwenVL3图像视频反推API+最强放大SeedVR2多合一工作流,Comfyui-v0.7.0

集成千问图像2512模型+QwenVL3图像视频反推API+最强放大SeedVR2多合一工作流,Comfyui-v0.7.0

AI电商

magic-tryon图片视频虚拟试装换装模特换衣 二次webui开发构建by科哥

3

3@鸡你太美

认证作者

认证作者 41

41 2H

2H更新时间:2026-04-27

支持自启动

支持自启动magic-tryon图片视频虚拟试装换装模特换衣

magic-tryon图片视频虚拟试装换装模特换衣

AI应用

图文创作神器一句话一张图片生成小红书图文 构建by科哥

1

1@鸡你太美

认证作者

认证作者 6

6 4H

4H更新时间:2026-04-27

支持自启动

支持自启动图文创作神器一句话一张图片生成小红书图文

图文创作神器一句话一张图片生成小红书图文

Qwen-Image图片生成

阿里千问开源Qwen-Image-2512图像生成模型 二次开发构建by科哥

3

3@鸡你太美

认证作者

认证作者 13

13 6H

6H更新时间:2026-04-27

支持自启动

支持自启动需要80gb显存运行该项目

需要80gb显存运行该项目

物理模拟分子动力

gromacs_deepmd机器学习训练水分子力场

0

0@tty

14

14 350H

350H更新时间:2026-01-26

内含deepmd机器学习力场训练水分子,gromacs调用运行例子

内含deepmd机器学习力场训练水分子,gromacs调用运行例子

物理模拟分子动力

deepmd_lammps训练和运行镜像

0

0@tty

15

15 100H

100H更新时间:2026-01-26

内含ch4简单例子,也可用来训练自己的模型,3080ti版本

内含ch4简单例子,也可用来训练自己的模型,3080ti版本

混元

HY-Motion1.0腾讯混元开源的文本到3D动作生成模型 汉化构建by科哥

2

2@鸡你太美

认证作者

认证作者 13

13 22H

22H更新时间:2026-04-27

HY-Motion1.0腾讯混元开源的文本到3D动作生成模型 汉化构建by科哥

HY-Motion1.0腾讯混元开源的文本到3D动作生成模型 汉化构建by科哥

Wan视频编辑

wan2.1-scail动作迁移

22

22@匹夫

认证作者

认证作者 205

205 347H

347H更新时间:2026-01-26

wan2.1-scail动作迁移

wan2.1-scail动作迁移

Qwen-Image图片生成

Qwen‑Image‑Edit‑2511-LoRA训练 x AI Toolkit

6

6@AI-KSK

认证作者

认证作者 114

114 841H

841H更新时间:2026-01-01

这是一个集成了 Qwen-Image-Edit-2511模型与 AI Toolkit 训练框架的预配置环境,旨在支持用户高效微调出具备精准图像编辑、风格迁移及多主体一致性能力的定制化 LoRA 模型。

这是一个集成了 Qwen-Image-Edit-2511模型与 AI Toolkit 训练框架的预配置环境,旨在支持用户高效微调出具备精准图像编辑、风格迁移及多主体一致性能力的定制化 LoRA 模型。

语音合成

ChatterBox多语言语音合成语言克隆声音克隆 webui二次开发构建by科哥

4

4@鸡你太美

认证作者

认证作者 30

30 11H

11H更新时间:2026-04-27

支持自启动

支持自启动支持23个国家的语言声音克隆

支持23个国家的语言声音克隆

数字人

LatentSync 1.6 纯净版

3

3@knzskl

30

30 23H

23H更新时间:2026-01-26

字节跳动、北京交通大学联合推出的端到端唇形同步框架。Latent Sync利用稳定扩散和TREPA的力量,为动态和逼真的视频生成提供精确的高分辨率唇形同步。

字节跳动、北京交通大学联合推出的端到端唇形同步框架。Latent Sync利用稳定扩散和TREPA的力量,为动态和逼真的视频生成提供精确的高分辨率唇形同步。

SDLora训练

SDXL及系列衍生模型训练,内置WD打标编辑,任意C站模型导入,小白也能轻松上手,AI-Toolkit

59

59@梦影Erislia

998

998 6769H

6769H更新时间:2025-12-30

SDXL及系列衍生模型训练,内置WD打标编辑,任意C站模型导入,小白也能轻松上手,AI-Toolkit

SDXL及系列衍生模型训练,内置WD打标编辑,任意C站模型导入,小白也能轻松上手,AI-Toolkit

视频生成图片生成ComfyUI

启梦光影高质量出图二合一

1

1@麦子AI

34

34 98H

98H更新时间:2026-01-28

支持自启动

支持自启动高质量文生图、图生视频。只适配40系显卡

高质量文生图、图生视频。只适配40系显卡

Wan视频编辑

StoryMem基于wan2.2逐镜脚本生成高连贯电影级1分钟多镜头叙事视频 二次开发构建by科哥

10

10@鸡你太美

认证作者

认证作者 38

38 19H

19H更新时间:2026-04-27

支持自启动

支持自启动StoryMem基于wan2.2逐镜脚本生成高连贯电影级1分钟多镜头叙事视频 二次开发构建by科哥

StoryMem基于wan2.2逐镜脚本生成高连贯电影级1分钟多镜头叙事视频 二次开发构建by科哥

ComfyUI

ComfyUI学习版_torch_2.8.0

6

6@智绘Store

认证作者

认证作者 48

48 120H

120H更新时间:2026-03-17

支持自启动

支持自启动此版本镜像,5090、4090、3090、3080Ti等系列显卡可用,P40显卡不可用

此版本镜像,5090、4090、3090、3080Ti等系列显卡可用,P40显卡不可用

ComfyUI

ComfyUI学习版镜像_torch-2.7.1

10

10@智绘Store

认证作者

认证作者 28

28 100H

100H更新时间:2026-03-17

支持自启动

支持自启动ComfyUI学习版镜像_torch-2.7.1,高性价比镜像,可开P40显卡,5090显卡勿用,会报错

ComfyUI学习版镜像_torch-2.7.1,高性价比镜像,可开P40显卡,5090显卡勿用,会报错

Qwen-Image

qwen-image工作流合集edit2511-z-image-turbo

8

8@匹夫

认证作者

认证作者 80

80 151H

151H更新时间:2026-01-27

qwen-image工作流合集

qwen-image工作流合集

语音合成

VoxCPM1.5面壁智能开源的端到端语音合成模型附训练lora训练器 构建by科哥

1

1@鸡你太美

认证作者

认证作者 24

24 23H

23H更新时间:2026-04-27

支持自启动

支持自启动语音合成模型+训练lora训练器

语音合成模型+训练lora训练器

Qwen-ImageLora训练图片生成

Qwen-2511和Z图像的Lora训练AI-TOOLKIT

7

7@梦影Erislia

53

53 306H

306H更新时间:2026-01-27

Qwen-2511和Z图像的Lora训练AI-TOOLKIT

Qwen-2511和Z图像的Lora训练AI-TOOLKIT

Wan视频生成

Egox任意视频一键转第一人称视角视频基于wan2.1模型 webui二次开发构建by科哥

2

2@鸡你太美

认证作者

认证作者 9

9 8H

8H更新时间:2026-04-27

支持自启动

支持自启动将任意视频一键转第一人称视角视频

将任意视频一键转第一人称视角视频

视频生成图片生成ComfyUI

启梦光影VIP快速出图二合一

2

2@麦子AI

10

10 155H

155H更新时间:2026-01-27

支持自启动

支持自启动2s出图,超级快。注意!本镜像需要部署在50系列显卡上。

2s出图,超级快。注意!本镜像需要部署在50系列显卡上。

数字人

One-to-All-Animation单图片转换动画视频数字人视频动作模仿器 构建by科哥

1

1@鸡你太美

认证作者

认证作者 8

8 5H

5H更新时间:2026-04-27

支持自启动

支持自启动单图片转换动画视频数字人视频动作模仿器

单图片转换动画视频数字人视频动作模仿器

数字人

personaLive实时数字人系统

10

10@有趣的80后程序员

认证作者

认证作者 81

81 205H

205H更新时间:2025-12-27

支持自启动

支持自启动实时数字人系统,直播室直接生成分身,低延迟

实时数字人系统,直播室直接生成分身,低延迟

Qwen-Image图片生成

Qwen-Image-Edit-2511阿里通义推出的全能图像编辑模型 webui二次修改构建by科哥

4

4@鸡你太美

认证作者

认证作者 74

74 1109H

1109H更新时间:2026-04-27

支持自启动

支持自启动图片编辑模型 一致性更加好 中文支持更好

图片编辑模型 一致性更加好 中文支持更好

语音克隆语音合成

超强AI音色克隆,VoxCPM-V1.5,支持超长文本生成、批量生成,支持音色保存、多音字修改、语速调节,速度超快!

24

24@与AI同行

认证作者

认证作者 1014

1014 643H

643H更新时间:2026-03-31

支持自启动

支持自启动超强AI音色克隆,VoxCPM-V1.5,支持超长文本生成、批量生成,支持音色保存、多音字修改、语速调节,速度超快!

超强AI音色克隆,VoxCPM-V1.5,支持超长文本生成、批量生成,支持音色保存、多音字修改、语速调节,速度超快!

ComfyUIWanQwen-Image

2025.12全新模型ComfyUI整合包

17

17@老徐Ai研习社

认证作者

认证作者 121

121 466H

466H更新时间:2025-12-26

支持自启动

支持自启动ComfyUI2025.12整合包

ComfyUI2025.12整合包

ComfyUI

ComfyUI云端整合包2512

14

14@鹄仙

认证作者

认证作者 67

67 1429H

1429H更新时间:2026-01-27

ComfyUI云端整合包2512 支持Z-Image 混元1.5,新增到63个插件,带文件管理系统

ComfyUI云端整合包2512 支持Z-Image 混元1.5,新增到63个插件,带文件管理系统

Qwen-Image视频编辑

千问2511与动作迁移三剑客

3

3@鹄仙

认证作者

认证作者 17

17 33H

33H更新时间:2025-12-27

一个基于Wan2GP的图像编辑与动作迁移视频生成的WebUI项目

一个基于Wan2GP的图像编辑与动作迁移视频生成的WebUI项目

Wan视频生成ComfyUI

TurboDiffusion 100–200×加速ComfyUI-Wan图到视频生成

13

13@AI-KSK

认证作者

认证作者 135

135 347H

347H更新时间:2025-12-25

这是一个超快的AI视频生成工具,1分钟就能把图片变成短视频,速度是普通AI的200倍。

这是一个超快的AI视频生成工具,1分钟就能把图片变成短视频,速度是普通AI的200倍。

语音合成

VoxCPM1.5雨落版整合包

6

6@雨落实战

认证作者

认证作者 80

80 190H

190H更新时间:2025-12-24

支持自启动

支持自启动VoxCPM1.5的雨落版整合包

VoxCPM1.5的雨落版整合包

AI应用图片生成

PromptFill专为AI绘画设计的开源结构化提示词生成工具 构建by科哥

2

2@鸡你太美

认证作者

认证作者 7

7 0H

0H更新时间:2026-04-27

支持自启动

支持自启动专为AI绘画设计的开源结构化提示词生成工具

专为AI绘画设计的开源结构化提示词生成工具

LongCat数字人

最强长视频数字人:LongCat-Avatar尝鲜版,其他热门生图、视频也都备好了!

15

15@老许爱吃肉丶

64

64 172H

172H更新时间:2026-01-27

支持自启动

支持自启动最强长视频数字人:LongCat-Avatar尝鲜版,其他热门生图、视频也都备好了!

最强长视频数字人:LongCat-Avatar尝鲜版,其他热门生图、视频也都备好了!

LongCat数字人

SOTA级音频驱动数字人-LongCat-Video-Avatar

12

12@AI-KSK

认证作者

认证作者 58

58 58H

58H更新时间:2026-01-27

实现身份永续、动作自然的数字人生成

实现身份永续、动作自然的数字人生成

视频生成数字人

AI数字人LongCatAvatar,超强口型+表情+姿势效果,支持长视频!

54

54@与AI同行

认证作者

认证作者 348

348 356H

356H更新时间:2026-03-31

支持自启动

支持自启动AI数字人LongCatAvatar,超强口型+表情+姿势效果,支持长视频!

AI数字人LongCatAvatar,超强口型+表情+姿势效果,支持长视频!

3D生成

SHARP–苹果开源的3D场景生成AI模型图片转3d模型 二次开发构建by科哥

2

2@鸡你太美

认证作者

认证作者 26

26 540H

540H更新时间:2026-04-27

支持自启动

支持自启动SHARP–苹果开源的3D场景生成AI模型图片转3d模型

SHARP–苹果开源的3D场景生成AI模型图片转3d模型

GLM语音识别

GLM-ASR智谱开源的语音识别、语音转文本模型 二次开发构建By科哥

0

0@鸡你太美

认证作者

认证作者 5

5 1H

1H更新时间:2026-04-27

支持自启动

支持自启动智谱开源的语音识别语音转文本声音转文本模型

智谱开源的语音识别语音转文本声音转文本模型

分子动力生物信息

Rosetta

2

2@苍耳阿猫

认证作者

认证作者 2

2 1H

1H更新时间:2025-12-23

Rosetta

Rosetta

AI应用视频生成

Pixelle-Video|一句话生成短视频

7

7@鸡你太美

认证作者

认证作者 25

25 11H

11H更新时间:2026-04-27

支持自启动

支持自启动零门槛,零剪辑经验,让视频创作成为一句话的事

零门槛,零剪辑经验,让视频创作成为一句话的事

其他

ai小说ai在线写作系统ai智能写作系统 构建by科哥

7

7@鸡你太美

认证作者

认证作者 19

19 44H

44H更新时间:2026-04-27

支持自启动

支持自启动ai小说ai在线写作系统ai智能写作系统

ai小说ai在线写作系统ai智能写作系统

Lora训练

ai-toolkit炼丹炉,支持多种常见模型训练,内置多种模型

4

4@MumuOpenK

66

66 460H

460H更新时间:2026-01-29

支持自启动

支持自启动ai-toolkit炼丹炉(汉化版)

ai-toolkit炼丹炉(汉化版)

语音合成GLM

智谱开源的AI文本转语音模型支持声音克隆GLM-TTS 语音合成系统 二次开发构建by科哥

0

0@鸡你太美

认证作者

认证作者 32

32 24H

24H更新时间:2026-04-27

支持自启动

支持自启动智谱开源的AI文本转语音模型支持声音克隆GLM-TTS 语音合成系统 二次开发构建by科哥

智谱开源的AI文本转语音模型支持声音克隆GLM-TTS 语音合成系统 二次开发构建by科哥

ComfyUIQwen-Image图片生成

Twinflow双流加速千问生图1秒1张

5

5@smthem

20

20 14H

14H更新时间:2025-12-20

支持自启动

支持自启动最快千问生图方法,顶配1秒1张

最快千问生图方法,顶配1秒1张

AI应用

next-ai-draw-io

0

0@苍耳阿猫

认证作者

认证作者 0

0 0H

0H更新时间:2025-12-19

next-ai-draw-io

next-ai-draw-io

3D生成ComfyUI

Trellis2代一键图片生成3D模型

9

9@smthem

150

150 290H

290H更新时间:2025-12-19

支持自启动

支持自启动一键图片生成3D模型,输出glb和obj格式,带贴图和法线,自动脱底

一键图片生成3D模型,输出glb和obj格式,带贴图和法线,自动脱底

Wan视频生成ComfyUI

TurboDiffusion-ultra-fast-wan

6

6@有趣的80后程序员

认证作者

认证作者 68

68 107H

107H更新时间:2025-12-18

让阿里wan模型的视频生成速度提升200倍

让阿里wan模型的视频生成速度提升200倍

语音合成

cosyvoce3阿里最新开源声音克隆应用普通话粤语英语日语方言更加精准情感丰富 二次开发构建By科哥

6

6@鸡你太美

认证作者

认证作者 59

59 60H

60H更新时间:2026-04-27

支持自启动

支持自启动cosyvoce3阿里最新开源声音克隆应用普通话粤语英语日语方言更加精准情感丰富 二次开发构建By科哥

cosyvoce3阿里最新开源声音克隆应用普通话粤语英语日语方言更加精准情感丰富 二次开发构建By科哥

分子动力

cp2k

1

1@苍耳阿猫

认证作者

认证作者 6

6 14H

14H更新时间:2025-12-18

cp2k-v2025.2

cp2k-v2025.2

语音合成

CosyVoice3,多音字控制,音色保存,接口API调用,流式接口,音频降噪

35

35@刘悦的技术博客

认证作者

认证作者 371

371 4785H

4785H更新时间:2026-01-28

支持自启动

支持自启动CosyVoice3,多音字控制,音色保存,接口API调用,流式接口,音频降噪

CosyVoice3,多音字控制,音色保存,接口API调用,流式接口,音频降噪

ComfyUIAI电商

电商换装到视频-全流程

19

19@积木comfyui

148

148 141H

141H更新时间:2026-01-28

支持自启动

支持自启动换装-换模特-换姿势-换背景-打光-放大-模特图生视频-全流程

换装-换模特-换姿势-换背景-打光-放大-模特图生视频-全流程

文本模型

Nemotron3

0

0@敢敢のwings

认证作者

认证作者 0

0 0H

0H更新时间:2025-12-18

Nemotron 3系列是NVIDIA推出的开放模型家族,包含开放权重、训练数据和训练配方,旨在为构建专业化AI智能体提供领先的效率和准确性。

Nemotron 3系列是NVIDIA推出的开放模型家族,包含开放权重、训练数据和训练配方,旨在为构建专业化AI智能体提供领先的效率和准确性。

分子动力

DeePMD-kit

0

0@苍耳阿猫

认证作者

认证作者 4

4 4H

4H更新时间:2025-12-16

DeePMD-kit-v3.1.2

DeePMD-kit-v3.1.2

分子动力

LAMMPS

1

1@苍耳阿猫

认证作者

认证作者 29

29 247H

247H更新时间:2025-12-16

lammps

lammps

Wan视频生成数字人

LiveAvatar

9

9@十字鱼

认证作者

认证作者 24

24 20H

20H更新时间:2026-01-28

支持自启动

支持自启动流式实时音频驱动头像生成,无限长度

流式实时音频驱动头像生成,无限长度

AI应用

AI命理预测系统ai算命系统ai大模型算命系统 二次开发构建by科哥

1

1@鸡你太美

认证作者

认证作者 17

17 39H

39H更新时间:2026-04-27

使用最新的ai大模型结合中国传统命理系统开发 可以无卡模式运行这个项目

使用最新的ai大模型结合中国传统命理系统开发 可以无卡模式运行这个项目

OCR识别

PaddleOCR-VL

21

21@十字鱼

认证作者

认证作者 135

135 469H

469H更新时间:2026-01-28

支持自启动

支持自启动支持 109 种语言 擅长识别文本、表格、公式和图表

支持 109 种语言 擅长识别文本、表格、公式和图表

语音合成GLM

GLM-TTS

7

7@十字鱼

认证作者

认证作者 40

40 1201H

1201H更新时间:2026-01-28

支持自启动

支持自启动可控且富有情感表达的零样本TTS

可控且富有情感表达的零样本TTS

数字人

知鱼-焕焕镜像

1

1@

9

9 140H

140H更新时间:2026-01-28

支持自启动

支持自启动数字人视频生成/Digital Human Video Generation

数字人视频生成/Digital Human Video Generation

GLMAI应用

Open-AutoGLM

0

0@敢敢のwings

认证作者

认证作者 1

1 1H

1H更新时间:2025-12-13

支持自启动

支持自启动Open-AutoGLM是由智谱AI在2024年10月推出的开源手机操作智能体框架

Open-AutoGLM是由智谱AI在2024年10月推出的开源手机操作智能体框架

GLMAI应用

AutoGLM-Phone-9B

0

0@Ikaros

10

10 20H

20H更新时间:2025-12-12

支持自启动

支持自启动AutoGLM-Phone-9B一键启动镜像

AutoGLM-Phone-9B一键启动镜像

Wan视频生成

Wan2.2-14B加速版TTP图片放大ttp加速插画图片放大图片高清图片细节放大 科哥构建

4

4@鸡你太美

认证作者

认证作者 33

33 81H

81H更新时间:2026-04-27

支持自启动

支持自启动专注图片细节放大工作流

专注图片细节放大工作流

LongCat图片生成图片编辑

LongCat-Image

4

4@十字鱼

认证作者

认证作者 23

23 6H

6H更新时间:2025-12-09

支持自启动

支持自启动美团龙猫开源图像模型,包含LongCat-Image文生图和LongCat-Image-Edit图像编辑

美团龙猫开源图像模型,包含LongCat-Image文生图和LongCat-Image-Edit图像编辑

Z-ImageLora训练

z-image-turbo lora炼丹炉ai-toolkit lora模型训练器

45

45@老徐Ai研习社

认证作者

认证作者 617

617 5729H

5729H更新时间:2026-01-22

支持自启动

支持自启动z-image-turbo lora炼丹炉ai-toolkit lora模型训练器

z-image-turbo lora炼丹炉ai-toolkit lora模型训练器

数字人

Heygem数字人视频生成系统批量版webui版 二次开发构建by科哥

17

17@鸡你太美

认证作者

认证作者 254

254 902H

902H更新时间:2026-04-27

支持自启动

支持自启动一键批量生成 一键打包下载视频

一键批量生成 一键打包下载视频

OCR识别

PaddleOCR在线webui文字文稿识别多种识别pdf文字识别 二次开发构建by科哥

1

1@鸡你太美

认证作者

认证作者 25

25 38H

38H更新时间:2026-04-27

支持自启动

支持自启动PaddleOCR在线webui文字文稿识别多种识别pdf文字识别 二次开发构建by科哥

PaddleOCR在线webui文字文稿识别多种识别pdf文字识别 二次开发构建by科哥

LongCat图片生成图片编辑

LongCat:双语超强图像生成与编辑,引领写实与精准创作新标准。

3

3@AI-KSK

认证作者

认证作者 6

6 0H

0H更新时间:2025-12-08

LongCat 是美团开源的双语图像生成与编辑模型,具备高效写实表现、强中文渲染与精准一致性编辑能力,在开源领域表现领先。

LongCat 是美团开源的双语图像生成与编辑模型,具备高效写实表现、强中文渲染与精准一致性编辑能力,在开源领域表现领先。

语音合成

VoxCPM

5

5@十字鱼

认证作者

认证作者 40

40 49H

49H更新时间:2025-12-08

支持自启动

支持自启动面壁智能开源语音克隆 全新1.5版本

面壁智能开源语音克隆 全新1.5版本

语音合成

VoxCPM 1.5B

3

3@鹄仙

认证作者

认证作者 65

65 122H

122H更新时间:2025-12-07

全新VoxCPM1.5B,增强长音频输出稳定性

全新VoxCPM1.5B,增强长音频输出稳定性

语音合成

VibeVoice语音合成系统二次webui开发构建by科哥

0

0@鸡你太美

认证作者

认证作者 9

9 0H

0H更新时间:2026-04-27

支持自启动