0

0Yuan2.0-2B WebDemo部署

YuanLLM 模型,源2.0 是浪潮信息发布的新一代基础语言大模型,包括源2.0-102B,源2.0-51B和源2.0-2B。源2.0是在源1.0的基础上,利用更多样的高质量预训练数据和指令微调数据集,令模型在语义、数学、推理、代码、知识等不同方面具备更强的理解能力。算法方面,源2.0提出并采用了一种新型的注意力算法结构:局部注意力过滤增强机制(LFA:Localized Filtering-based Attention)。LFA通过先学习相邻词之间的关联性,然后再计算全局关联性的方法,能够更好地学习到自然语言的局部和全局的语言特征,对于自然语言的关联语义理解更准确、更人性,提升了模型的自然语言表达能力,进而提升了模型精度。

镜像快速使用教程

1. 待实例初始化完成后,在控制台-应用中打开”JupyterLab“

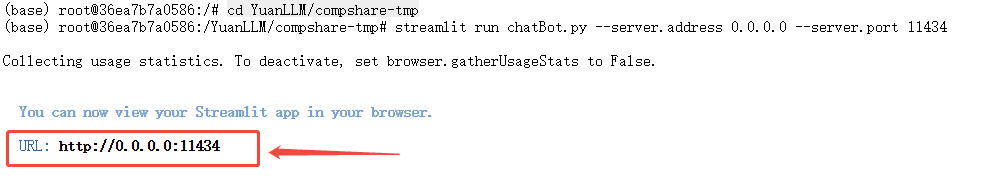

2. 进入Jupyter后,新建一个终端Terminal,输入以下指令

cd YuanLLM/compshare-tmp

streamlit run chatBot.py --server.address 0.0.0.0 --server.port 11434

3. 运行出现如下结果时,即可在浏览器中访问 http://0.0.0.0:11434 ,其中0.0.0.0替换为外网ip,外网ip可以在控制台-基础网络(外)中获取

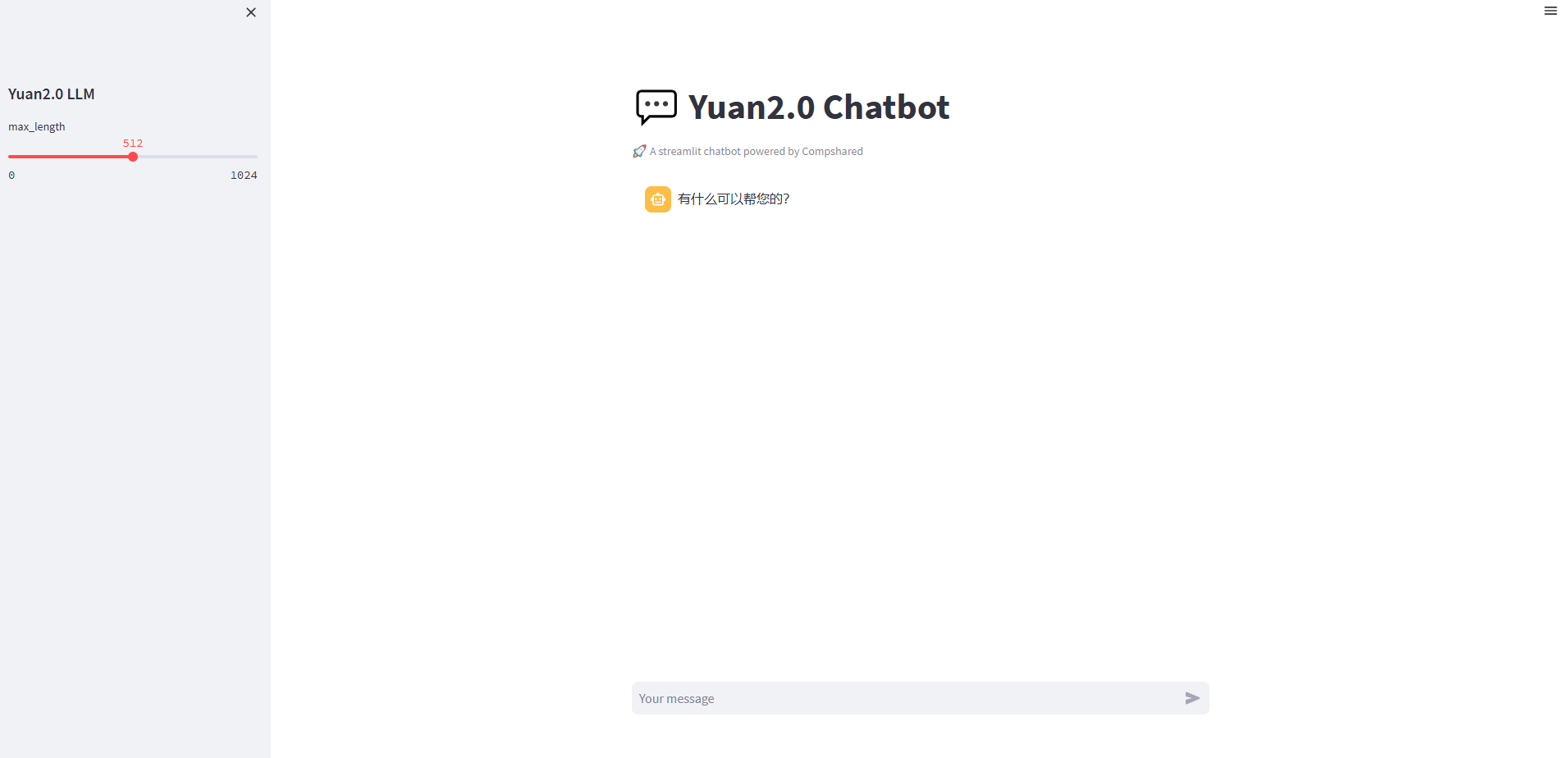

成功进入web界面如下图所示

环境准备

打开其中的终端,开始环境配置、模型下载和运行演示。 pip 换源加速下载并安装依赖包

# 更换 pypi 源加速库的安装

pip config set global.index-url https://pypi.tuna.tsinghua.edu.cn/simple

# 安装 einops modelscope streamlit

pip install einops modelscope streamlit==1.24.0

pip install transformers==4.37.0

pip install sentencepiece==0.1.99

pip install accelerate==0.24.1

pip install transformers_stream_generator==0.0.4

模型下载

使用 modelscope 中的 snapshot_download 函数下载模型,第一个参数为模型名称,参数 cache_dir 为模型的下载路径。

这里可以先进入autodl平台,初始化机器对应区域的的文件存储,文件存储路径为/YuanLLM/compshare-tmp。 该存储中的文件不会随着机器的关闭而丢失,这样可以避免模型二次下载。 然后运行下面代码,执行模型下载。模型大小为 4.5GB,下载大概需要 5 分钟。

from modelscope import snapshot_download

model_dir = snapshot_download(IEITYuan/Yuan2-2B-Mars-hf, cache_dir=/YuanLLM/compshare-tmp)

代码准备

在/YuanLLM/compshare-tmp路径下新建 chatBot.py 文件并在其中输入以下内容,粘贴代码后记得保存文件。下面的代码有很详细的注释,大家如有不理解的地方,欢迎提出issue。

chatBot.py代码如下

# 导入所需的库

from transformers import LlamaTokenizer, AutoModelForCausalLM

import torch

import streamlit as st

# 在侧边栏中创建一个标题和一个链接

with st.sidebar:

st.markdown(## Yuan2.0 LLM)

# 创建一个滑块,用于选择最大长度,范围在0到1024之间,默认值为512

max_length = st.slider(max_length, 0, 1024, 512, step=1)

# 创建一个标题和一个副标题

st.title(💬 Yuan2.0 Chatbot)

st.caption(🚀 A streamlit chatbot powered by Compshared)

# 定义模型路径

path = /YuanLLM/compshare-tmp/IEITYuan/Yuan2-2B-Mars-hf

# 定义一个函数,用于获取模型和tokenizer

@st.cache_resource

def get_model():

print(Creat tokenizer...)

tokenizer = LlamaTokenizer.from_pretrained(path, add_eos_token=False, add_bos_token=False, eos_token=<eod>)

tokenizer.add_tokens([<sep>, <pad>, <mask>, <predict>, <FIM_SUFFIX>, <FIM_PREFIX>, <FIM_MIDDLE>,<commit_before>,<commit_msg>,<commit_after>,<jupyter_start>,<jupyter_text>,<jupyter_code>,<jupyter_output>,<empty_output>], special_tokens=True)

print(Creat model...)

model = AutoModelForCausalLM.from_pretrained(path, torch_dtype=torch.bfloat16, trust_remote_code=True).cuda()

return tokenizer, model

# 加载model和tokenizer

tokenizer, model = get_model()

# 如果session_state中没有messages,则创建一个包含默认消息的列表

if messages not in st.session_state:

st.session_state[messages] = [{role: assistant, content: 有什么可以帮您的?}]

# 遍历session_state中的所有消息,并显示在聊天界面上

for msg in st.session_state.messages:

st.chat_message(msg[role]).write(msg[content])

# 如果用户在聊天输入框中输入了内容,则执行以下操作

if prompt := st.chat_input():

# 将用户的输入添加到session_state中的messages列表中

st.session_state.messages.append({role: user, content: prompt})

# 在聊天界面上显示用户的输入

st.chat_message(user).write(prompt)

# 调用模型

input_str = <n>.join(msg[content] for msg in st.session_state.messages) + <sep>

inputs = tokenizer(input_str, return_tensors=pt)[input_ids].cuda()

outputs = model.generate(inputs,do_sample=False,max_length=4000)

output = tokenizer.decode(outputs[0])

response = output.split(<sep>)[-1].replace(<eod>, )

# 将模型的输出添加到session_state中的messages列表中

st.session_state.messages.append({role: assistant, content: response})

# 在聊天界面上显示模型的输出

st.chat_message(assistant).write(response)

# print(st.session_state)

Web Demo运行

在终端中运行以下命令,启动streamlit服务,然后在浏览器中打开链接 http://(外部IP):11434,即可看到聊天界面。

streamlit run chatBot.py --server.address 0.0.0.0 --server.port 11434

``

认证作者

认证作者