5

5Srt-AI-Voice-Assistant

【更新提示】

-

额外增加IndexTTS2支持的新的多合一镜像已经发布https://www.compshare.cn/images/M0sem5L49kmr?referral_code=IHlncJt4RcQDdxKLEZ6pAY

-

此为在优云智算提供的搭配GPT-SoVITS的在线镜像版本(已更新至4.6.1+GSV2507) 如不是最新可按命令说明手动更新版本。同时额外预装了Ollama并附带2个GSV微调的模型(胡桃、梦见月瑞希)。部署后和本地使用整合包功能一致

-

本项目可利用多个AI-TTS为你的字幕或文本文件配音。

并提供包括字幕识别、翻译在内的多种便捷的辅助功能。 -

GitHub仓库地址:https://github.com/YYuX-1145/Srt-AI-Voice-Assistant

特性

- ✅ 代码开源,界面友好,本地运行,可局域网访问

- ✅ 支持多个TTS项目:BV2,GSV,CosyVoice2,AzureTTS,以及你可以自定义API!

- ✅ 保存个性化设置和预设

- ✅ 批量模式

- ✅ 字幕编辑

- ✅ 字幕批量翻译

- ✅ 单句重新抽卡

- ✅ 支持多角色配音

- ✅ 字幕重新导出

- ✅ 扩展功能:音视频字幕转录

- ✅ I18n

声明和注意事项

GPT-SoVITS以MIT协议开源, Srt-AI-Voice-Assistant以AGPL-3.0协议开源。 作者不对软件具备任何控制力, 使用软件者、传播软件导出的声音者自负全责。如不认可该条款, 则不能使用或引用软件包内任何代码和文件。内置的微调后的GSV模型版权归米哈游所有,禁止用于商业用途,禁止用于违反中华人民共和国现行法律的用途,否则后果自负。

在遵守AGPL-3.0开源协议的情况下,我并不反对你将Srt-AI-Voice-Assistant作为在线网页服务部署。(完整版条款请自行前往GitHub阅读。允许商用,但你必须在服务页面上声明本项目的GitHub仓库链接,并向用户以相同协议开放你所使用的全部的修改后源代码)

镜像作者教学视频

镜像使用指南

1. 镜像准备

推荐租用:3080Ti、3090、4090。个人推荐最佳体验是16G显存的显卡但这里没有。不过也没关系,3080Ti的12G也够用,只不过用完Ollama翻译后需要手动卸载模型避免爆显存。

2. 开始使用

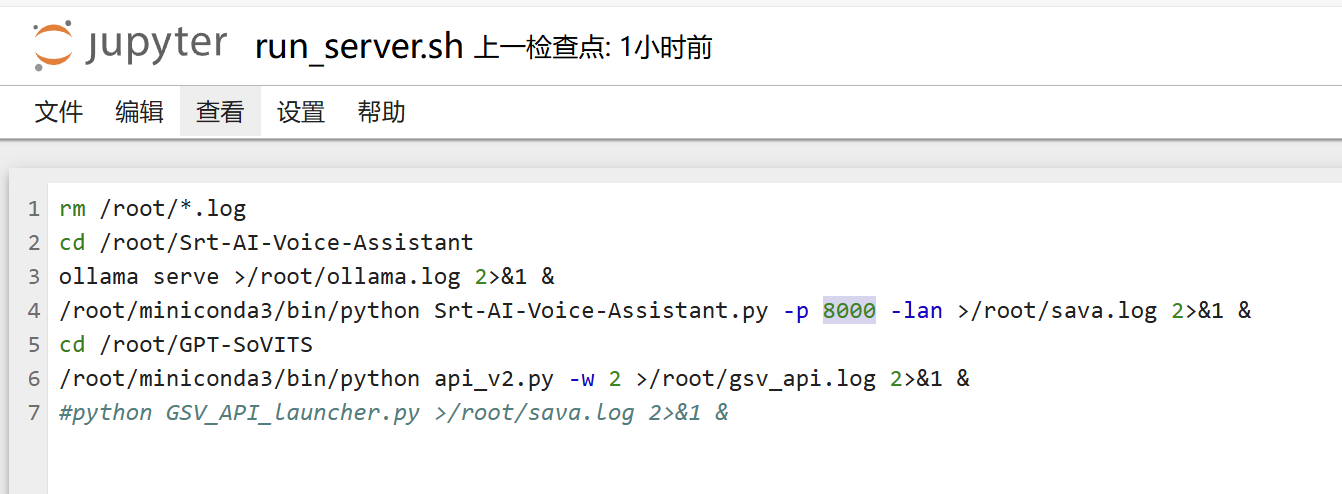

服务会自动启动,默认端口8000,可自行修改设置(下一节提到)。输入IP加端口访问页面。

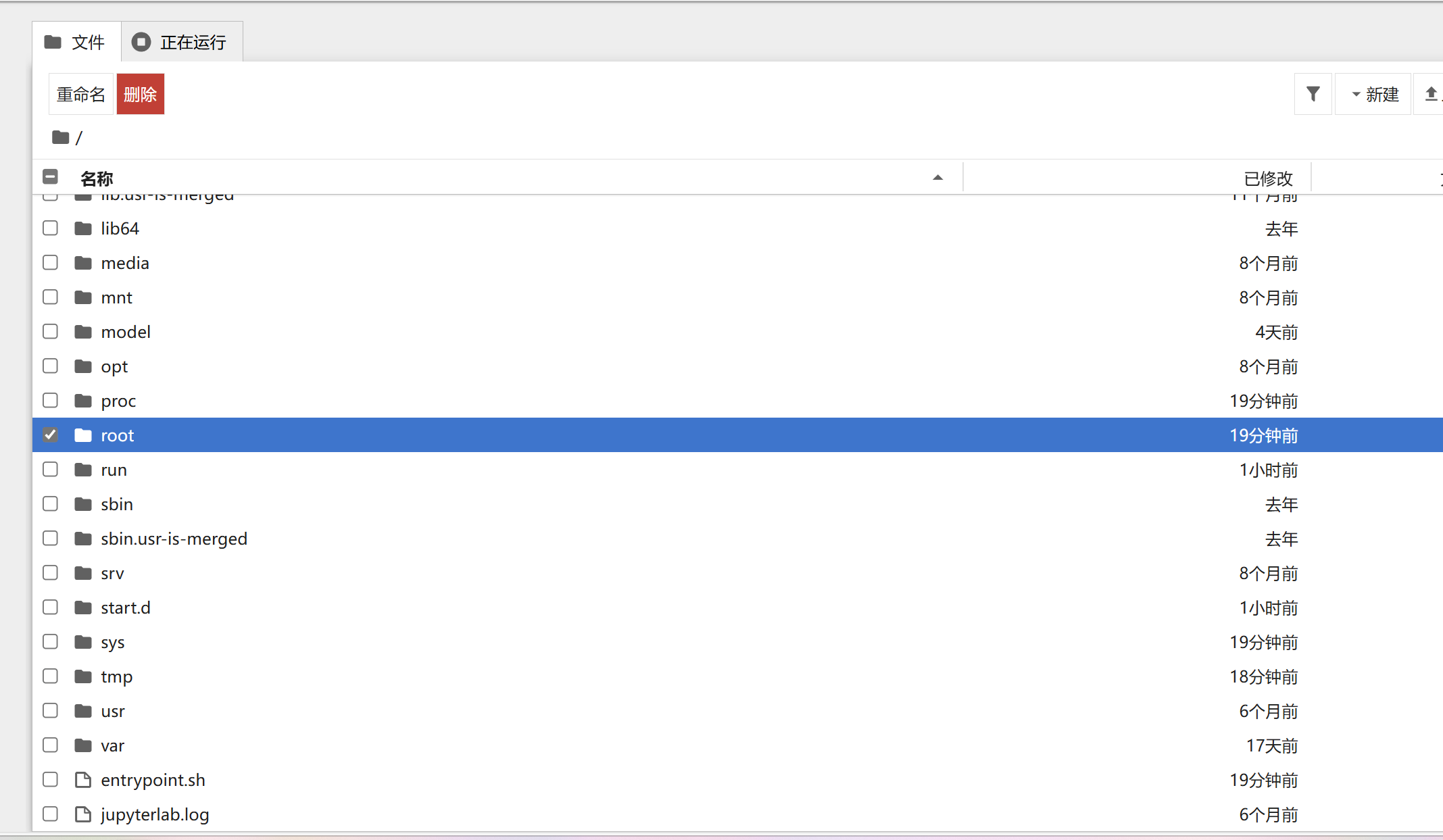

3. 镜像管理:打开Jupyter Notebook(如上面第一张图)

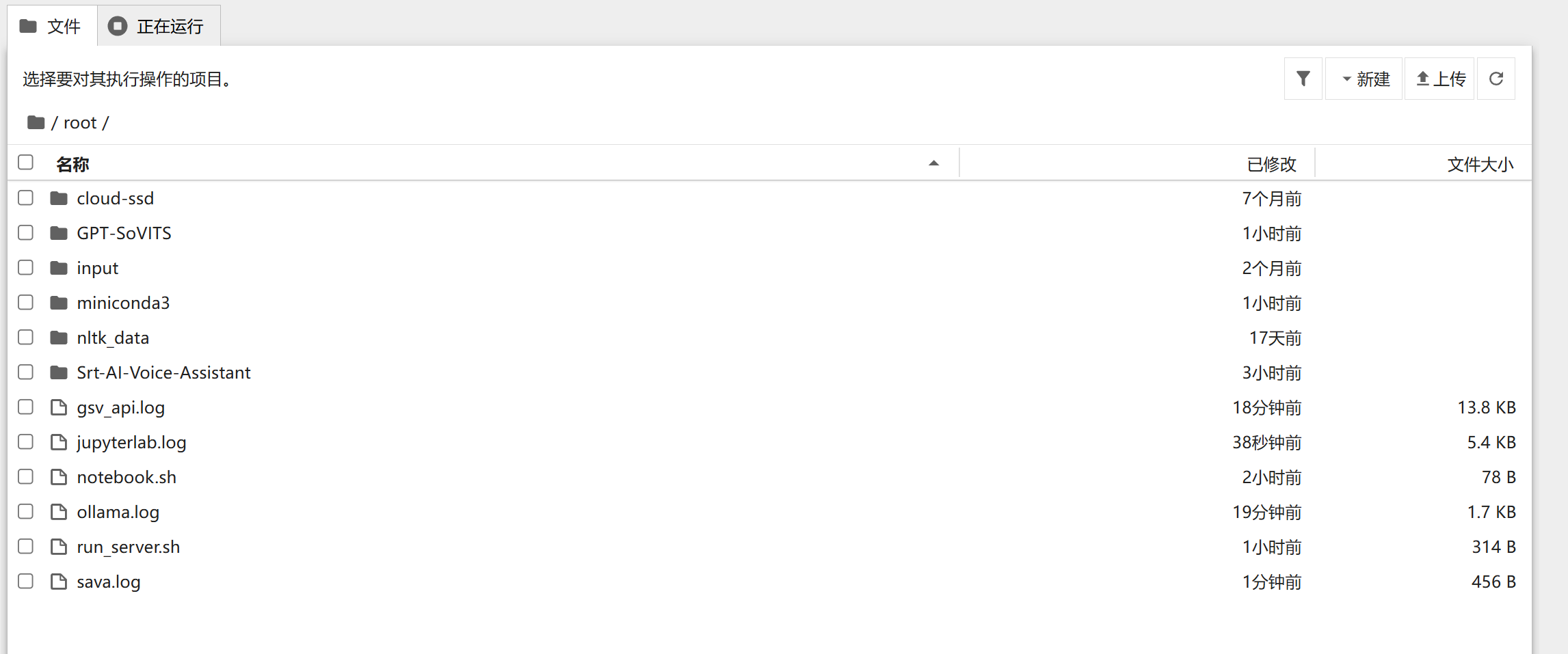

- 进入root目录

- 这是当前的工作目录。默认情况下各个组件的运行输出会保存在对应的log文件内

- 这是开机启动脚本的内容。你可以编辑它修改默认端口。

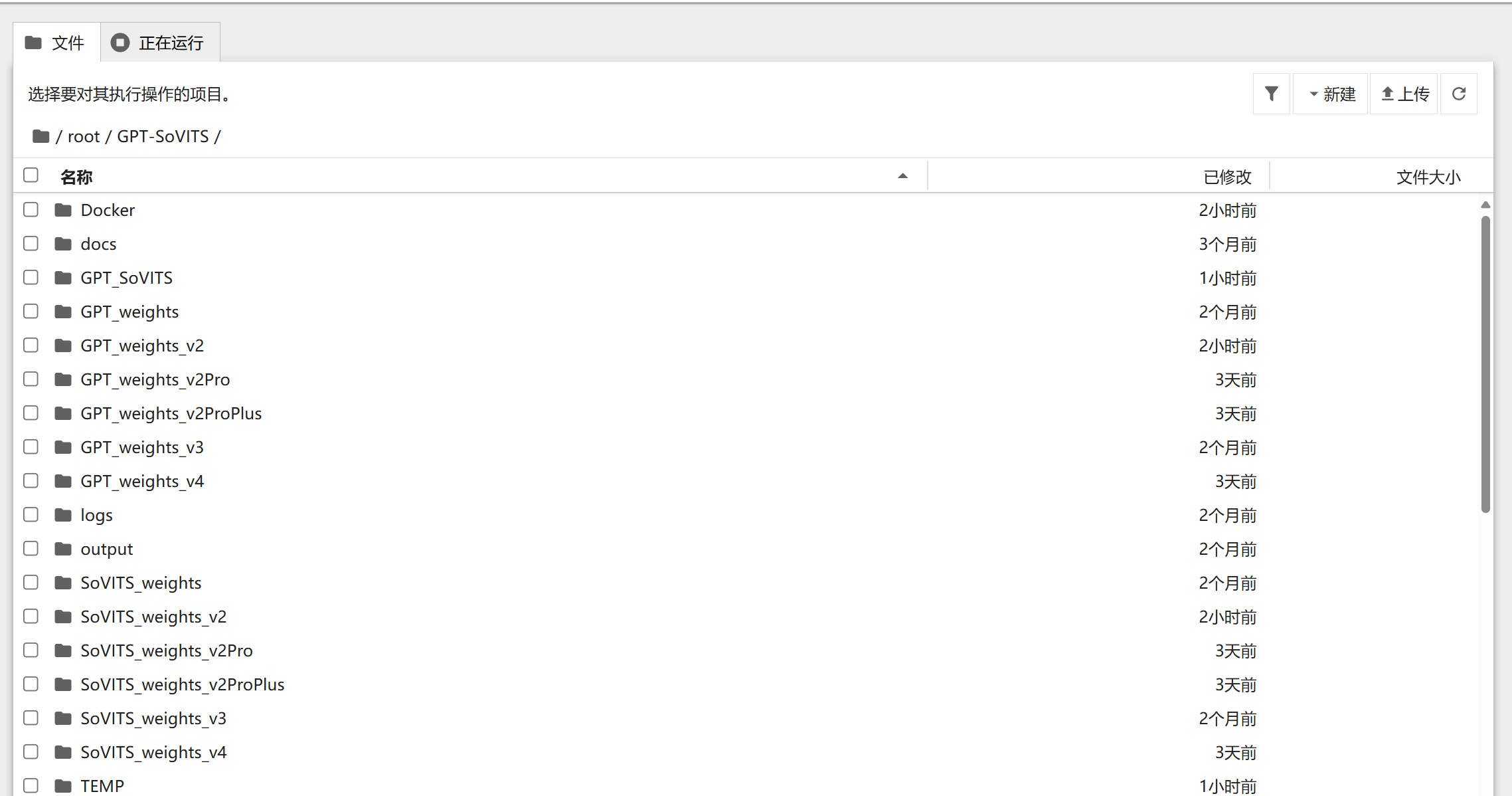

- 你可以进入GPT-SoVITS文件夹拖拽上传你自己的模型

4.终端常用命令

4.终端常用命令 - 基础命令

pwd #显示当前路径 cd root #进入到指定的目录(例子里是root) ls -l #列出当前目录文件 rm -rf #递归地删除目录和文件 别作死执行rm -rf /* git pull #进入到项目目录后拉取代码(可能要先执行git reset --hard还原代码更改) nvidia-smi #查看显卡状态

- 更新GSV

cd /root/GPT-SoVITS/ git reset --hard # 如果对代码做了影响合并的更改,请执行这条命令 git pull - 更新Srt-AI-Voice-Assistant

然后重启生效cd /root/Srt-AI-Voice-Assistant/ git reset --hard git pull

-

启动原版WebUI,但我没测试过云端微调训练

cd /root/GPT-SoVITS python webui.py # 然后输入ip:9874端口访问原版UI -

杀死进程(慎用,如果你想进行训练首先得结束推理进程释放显存)

ps -ef #这条命令会列出运行的所有进程详细信息 #然后你会看到进程的pid kill 123(替换成pid)

认证作者

认证作者

支持自启动

支持自启动