4

4FunClip 视频剪辑工具

FunClip 视频剪辑工具介绍

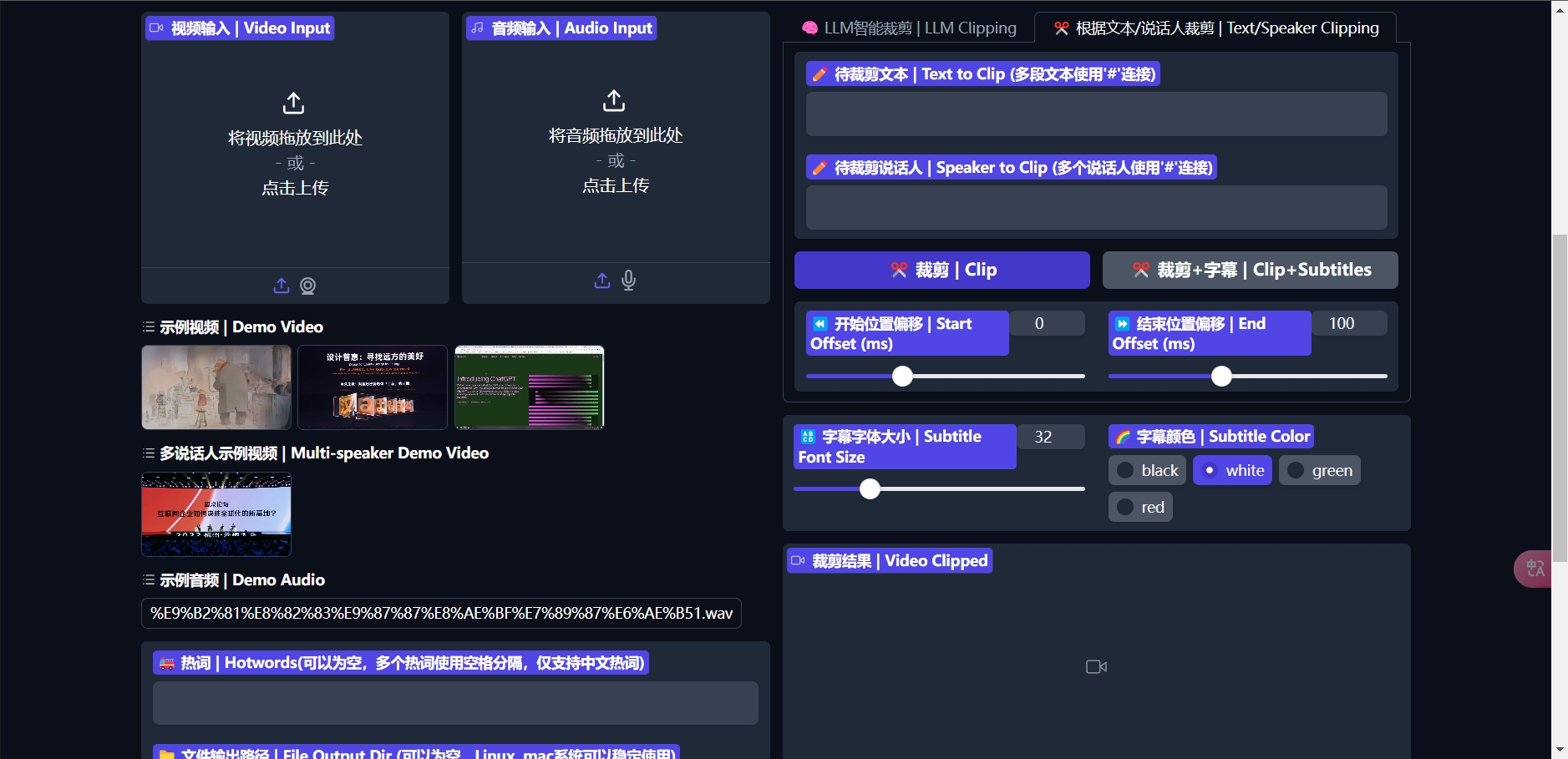

FunClip 是一款完全开源、本地部署的自动化视频剪辑工具。

FunClip 通过调用阿里巴巴通义实验室开源的 FunASR Paraformer 系列模型进行视频的语音识别。

FunClip 可以使用户自由选择识别结果中的文本片段或说话人,点击裁剪按钮即可获取对应片段的视频。

FunClip 视频剪辑工具用途

FunClip 旨在为视频剪辑提供一个更为智能、自动化的解决方案。

FunClip 通过集成先进的 AI 技术,降低了视频剪辑的难度,使得非专业人士也能够轻松制作出专业水准的视频内容。

FunClip 不仅适用于专业视频编辑人员,也适合于普通用户,无论是进行内容创作、教育视频制作,还是企业宣传视频的编辑,FunClip 都能提供强大的支持。

FunClip 视频剪辑工具特点

- 自动化语音识别: 利用阿里巴巴通义实验室的 FunASR Paraformer 系列模型,对视频进行语音识别将语音转换成文字。

- 热词定制化: 通过集成的 SeACo-Paraformer 模型,用户可以指定一些实体词、人名等作为热词,以提升特定词汇的识别准确率。

- 说话人识别: 集成 CAM++ 说话人识别模型,允许用户根据自动识别的说话人 ID 裁剪出特定说话人的视频段落。

- 视频裁剪: 用户可以选择识别结果中的文本片段或指定说话人,通过点击裁剪按钮获取对应视频片段。

- Gradio 交互界面: 通过 Gradio 实现的交互界面,简化了视频剪辑的操作流程,用户可以在服务端搭建服务并通过浏览器进行剪辑。

- 多段剪辑支持: FunClip 支持用户对视频进行多段剪辑,提供了灵活的编辑能力。

- 自动生成字幕: 剪辑后的视频可以自动生成全视频和目标段落的 SRT 字幕文件,方便用户添加或编辑字幕。

- 命令行调用: 除了图形界面,FunClip 还支持通过命令行进行视频识别和裁剪,提供了更灵活的使用方式。

FunClip 视频剪辑工具使用

此 FunClip 镜像已经包含了所有常用情况下的模型依赖,可以直接进行使用,具体操作流程如下。

1. 先选择GPU型号,再点击”立即部署“

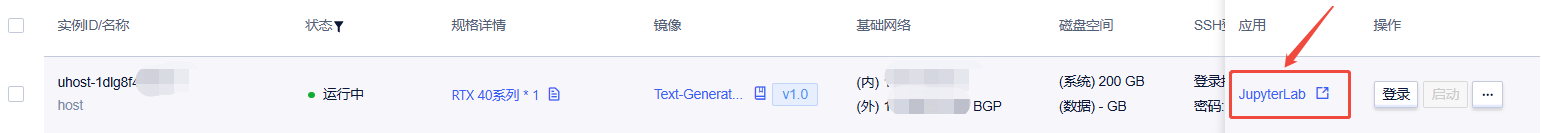

2. 待实例初始化完成后,在控制台-应用中打开”JupyterLab“

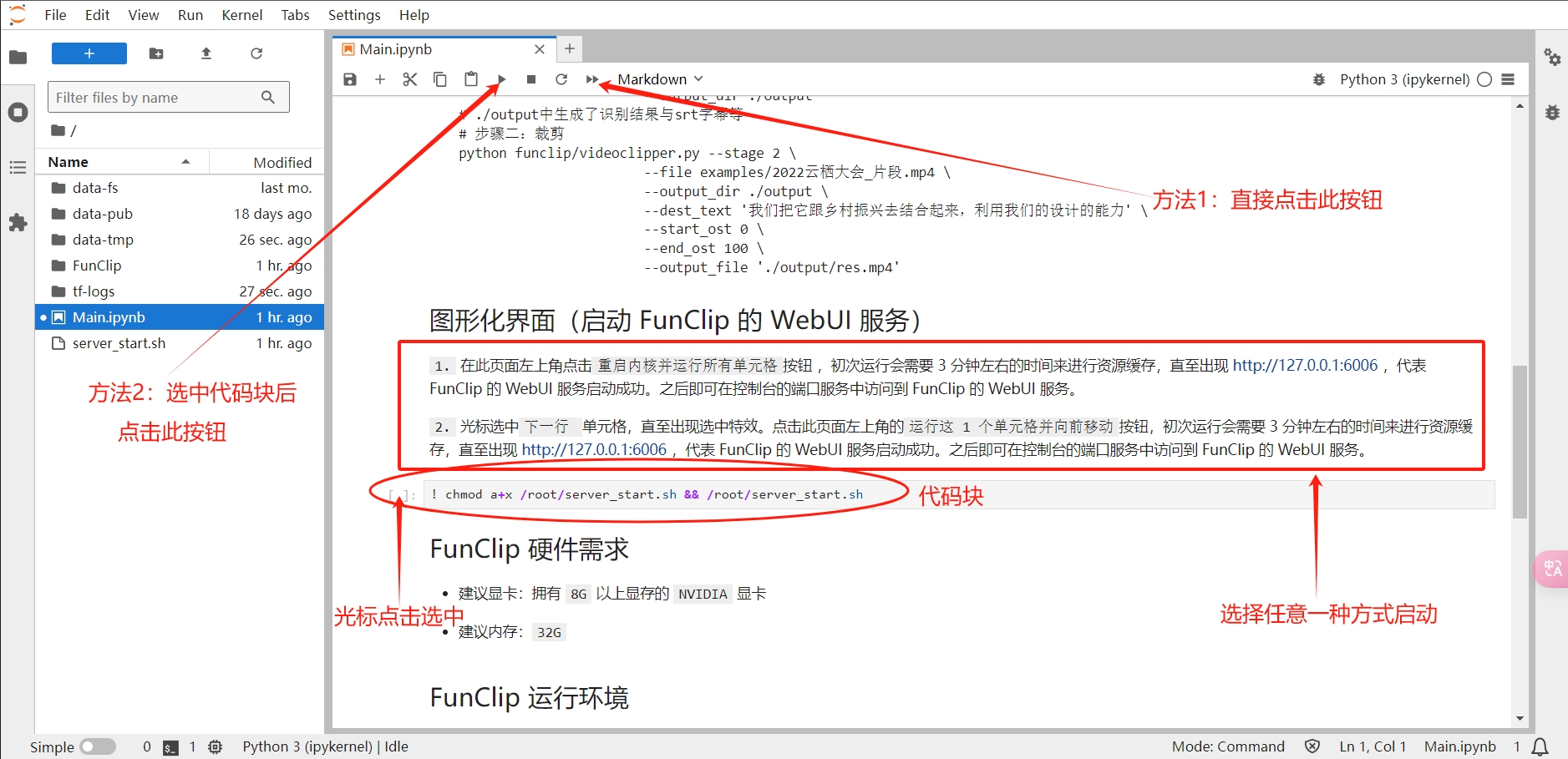

3. 进入JupyterLab后,有命令行调用和图形化界面两种使用方式,推荐使用图形化界面更易上手

命令行调用(运行 FunClip 的 Python 文件)

# 步骤一:识别

python funclip/videoclipper.py --stage 1 \\

--file examples/2022云栖大会_片段.mp4 \\

--output_dir ./output

# ./output中生成了识别结果与srt字幕等

# 步骤二:裁剪

python funclip/videoclipper.py --stage 2 \\

--file examples/2022云栖大会_片段.mp4 \\

--output_dir ./output \\

--dest_text 我们把它跟乡村振兴去结合起来,利用我们的设计的能力 \\

--start_ost 0 \\

--end_ost 100 \\

--output_file ./output/res.mp4

图形化界面(启动 FunClip 的 WebUI 服务):进入JupyterLab后,进入”Main.ipynb“这个文件,按照下图所示步骤运行

1. 在 JupyterLab 的默认 NoteBook 页面左上角点击重启内核并运行所有单元格按钮 ,初次运行会需要 3 分钟左右的时间来进行资源缓存,直至出现 http://0.0.0.0:3389 ,代表 FunClip 的 WebUI 服务启动成功。之后即可在控制台的端口服务中通过外部地址映射访问到 FunClip 的 WebUI 服务。

2. 在 JupyterLab 的默认 NoteBook 页面使用光标光标选中下一行 单元格,直至出现选中特效。点击此页面左上角的运行这 1 个单元格并向前移动按钮,初次运行会需要 3 分钟左右的时间来进行资源缓存,直至出现 http://0.0.0.0:3389 ,代表 FunClip 的 WebUI 服务启动成功,将0.0.0.0替换为外网ip,外网ip可以在控制台-基础网络(外)中获取。之后即可在控制台的端口服务中通过外部地址映射访问到 FunClip 的 WebUI 服务。

FunClip 硬件需求

- 建议显卡:拥有

8G以上显存的NVIDIA显卡 - 建议内存:

32G

FunClip 运行环境

framework_name: PyTorch

framework_version: 2.5.1

cuda_version: 12.4

python_version: 3.10

联系作者

bilibili:

wechat: