xinference_GPU

Xorbits Inference (Xinference) 是一个开源平台,用于简化各种AI 模型的运行和集成。 借助Xinference,可以使用任何开源LLM、Embedding模型和Rerank模型在云端或本地环境中运行推理

0

00元/小时

v1.0

Xinference 镜像使用教程

Xinference 项目介绍

Xorbits Inference (Xinference) 是一个开源平台,用于简化各种AI 模型的运行和集成。 借助Xinference,可以使用任何开源LLM、Embedding模型和Rerank模型在云端或本地环境中运行推理。

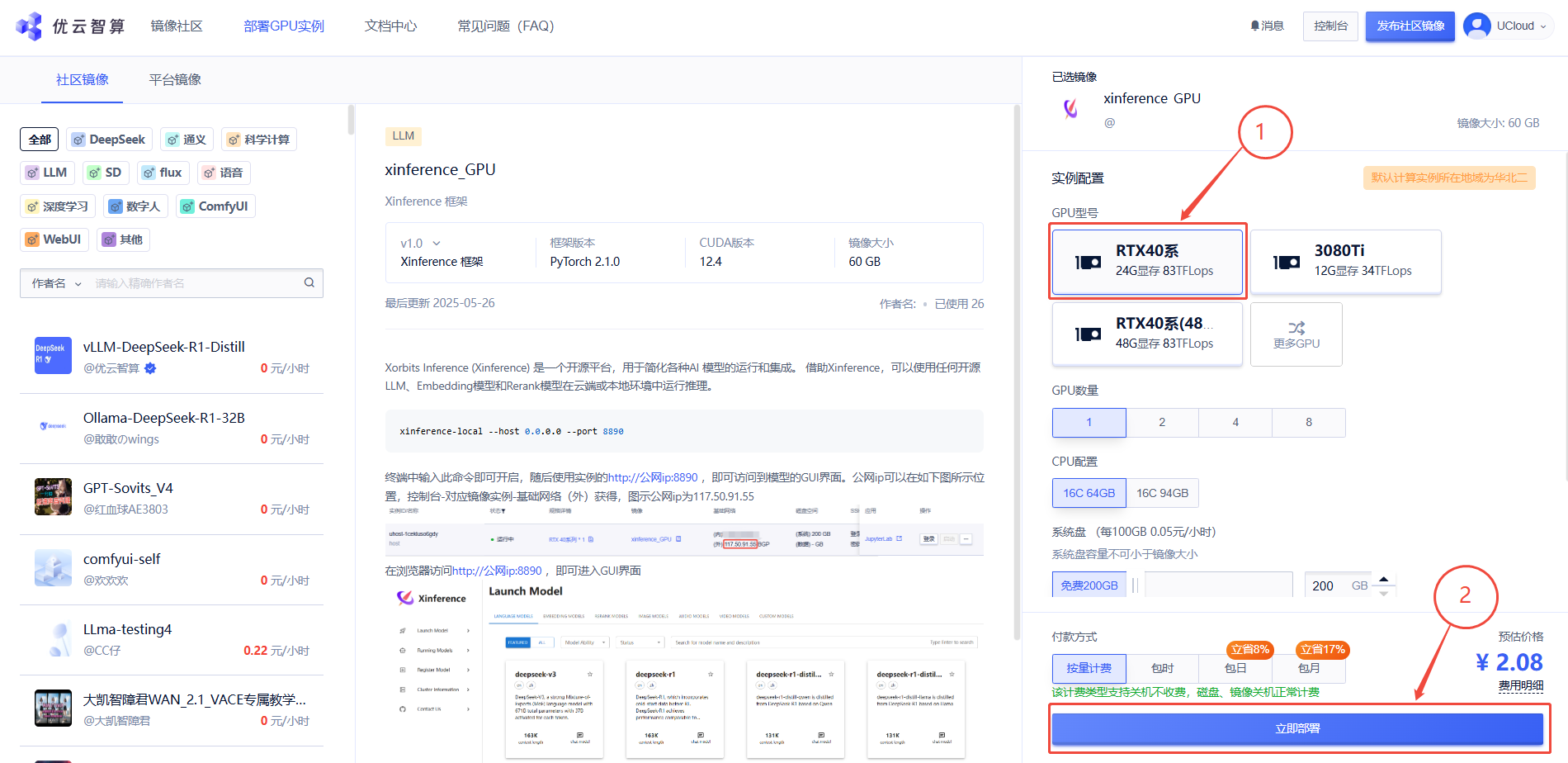

镜像快速部署教程

1. 在镜像详情界面,点击“使用该镜像创建实例”

2. 先选择GPU型号(以RTX40系为例,也可选择镜像支持的其它型号),再点击“立即部署”

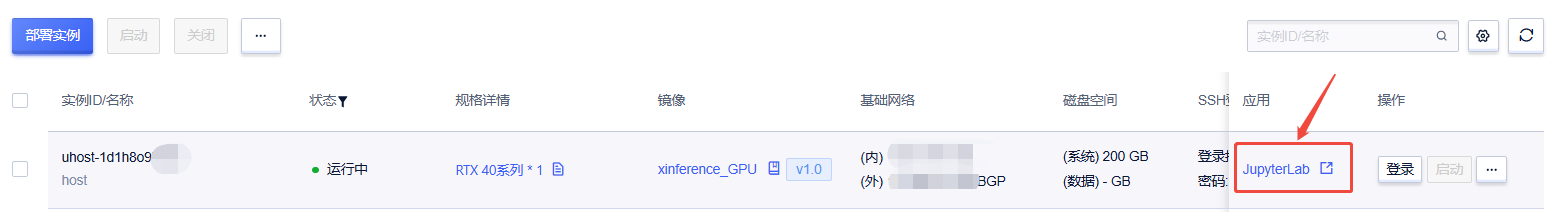

3. 待实例初始化完成后,在控制台-应用中点击“JupyterLab”

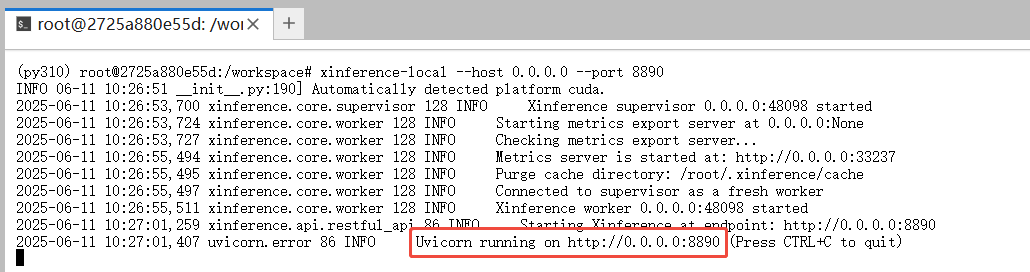

4. 进入JupyterLab后,新建终端Terminal,输入以下指令

xinference-local --host 0.0.0.0 --port 8890

当运行出现以下结果时,即可在浏览器中通过 ip:8890 进入web界面

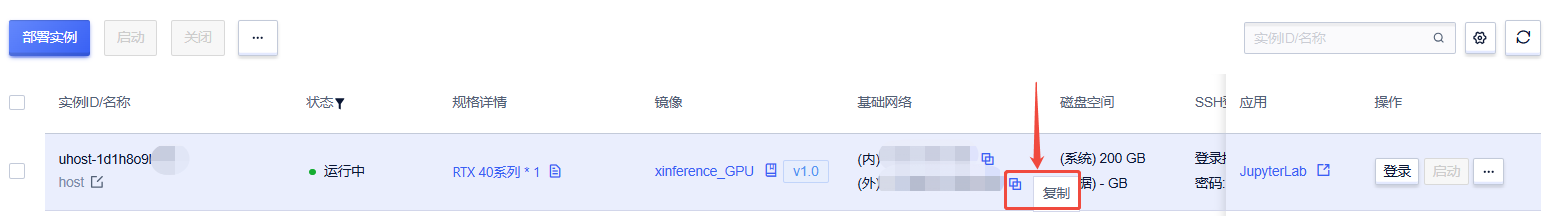

ip可以在控制台-基础网络(外)通过复制得到

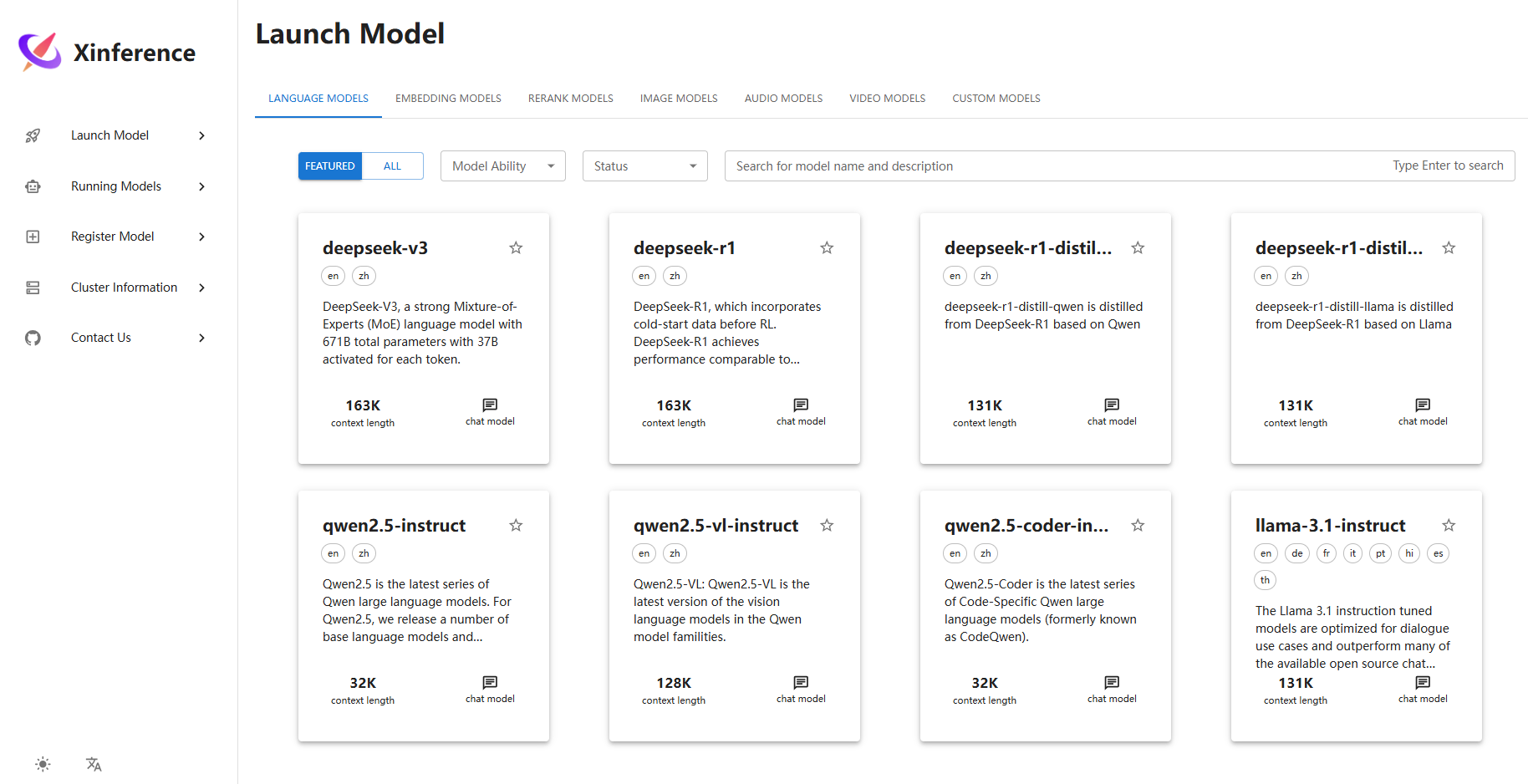

进入web界面后如下图所示即启动成功

@

镜像信息

已使用37 次

运行时长

263 H

镜像大小

60GB

最后更新时间

2025-07-14

支持卡型

RTX40系20803080Ti309048G RTX40系2080TiH20A800P40A100RTX50系V100SV100S

+13

框架版本

CUDA版本

12.4

应用

JupyterLab: 8888

版本

v1.0

2025-07-14