6

6MuseTalk 镜像

镜像简介

本镜像是专业的MuseTalk数字人模型,支持通过音频输入驱动生成高质量、口型精准的虚拟人视频。建议使用48G及以上显存的GPU环境,以确保流畅稳定的高性能生成体验。适用于虚拟主播、企业宣传、在线教育及创意内容制作等对画质与表现力有高要求的专业场景。

注意事项

- 建议选择显存48G及以上的GPU

- 如果选择24G的GPU,在realtime推理时,请将batch_size调整到4以下

- 使用realtime推理可以生成数字人模型

使用方法

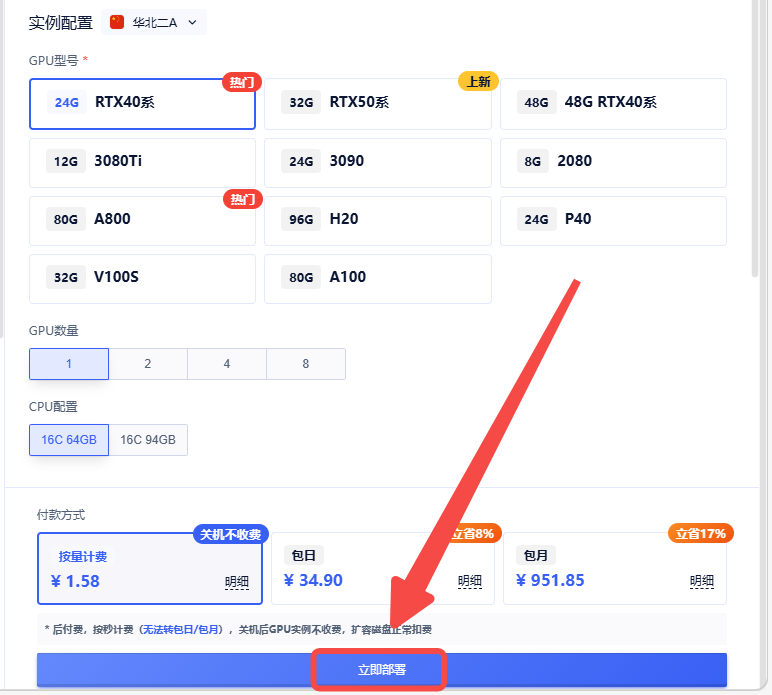

创建实例

初始化环境

在终端输入以下代码

cd /root/workspace/MuseTalk

conda activate MuseTalk

普通推理

- 使用demo

# MuseTalk 1.5 (Recommended)效果更好

sh inference.sh v1.5 normal

# MuseTalk 1.0

sh inference.sh v1.0 normal

此时,生成的demo视频会在/root/workspace/MuseTalk/results/test目录下

-

使用自定义的素材进行推理

-

将要使用的音频文件放在/root/workspace/MuseTalk/data/audio目录下,音频文件需要是wav格式

-

将要使用的视频文件放在/root/workspace/MuseTalk/data/video目录下,视频文件需要是mp4格式,分辨率不要太高,建议480P或720P

-

修改/root/workspace/MuseTalk/configs/inference/test.yaml

# task_0:

# video_path: "data/video/yongen.mp4"

# audio_path: "data/audio/yongen.wav"

# task_1:

# video_path: "data/video/yongen.mp4"

# audio_path: "data/audio/eng.wav"

# bbox_shift: -7

task_2:

video_path: "data/video/test.mp4"

audio_path: "data/audio/test.wav"

将原有的内容注释掉,在下面添加新的配置,例如task_2,将video_path和audio_path修改为你自己文件的路径

realtime推理

- 使用demo

# MuseTalk 1.5 (Recommended)

sh inference.sh v1.5 realtime

# MuseTalk 1.0

sh inference.sh v1.0 realtime

生成的视频会在/root/workspace/MuseTalk/results/avatars/avator_n/vid_output/ 或 /root/workspace/MuseTalk/results/v15/avatars/avator_n/vid_output/

avator_n是数字人的在配置文件中的id

avator_n这个文件夹就是数字人模型

-

使用自定义的素材进行推理

-

将要使用的音频文件放在/root/workspace/MuseTalk/data/audio目录下,音频文件需要是wav格式

-

将要使用的视频文件放在/root/workspace/MuseTalk/data/video目录下,视频文件需要是mp4格式,分辨率不要太高,建议480P或720P

-

修改/root/workspace/MuseTalk/configs/inference/realtime.yaml

# avator_1:

# preparation: True # your can set it to False if you want to use the existing avator, it will save time

# bbox_shift: 5

# video_path: "data/video/yongen.mp4"

# audio_clips:

# audio_0: "data/audio/yongen.wav"

# audio_1: "data/audio/eng.wav"

avator_2:

preparation: True # your can set it to False if you want to use the existing avator, it will save time

bbox_shift: 5

video_path: "data/video/yongen.mp4"

audio_clips:

audio_0: "data/audio/yongen.wav"

将原有的内容注释掉,在下面添加新的配置,例如task_2,将video_path和audio_path修改为你自己文件的路径.

preparation为True表示会生成一个新的数字人模型,如果之前已经有数字人模型,你可以将这个值修改为False

训练