SAM3 常见使用案例大全

SAM 3提出的PCS任务从根本上突破了这一限制,模型需要检测、分割并追踪输入图像或视频中所有符合该概念的实例。

0

00元/小时

v1.0

SAM3 常见使用案例大全

镜像简介

计算机视觉领域的图像分割技术经历了从传统方法到深度学习的根本性变革。早期的分割算法依赖于手工设计的特征和规则,如阈值分割、边缘检测和区域生长等方法,这些技术在处理复杂场景时往往力不从心。随着卷积神经网络的兴起,FCN、U-Net、Mask R-CNN等模型相继问世,将分割精度提升到了新的高度,但这些模型通常需要针对特定类别进行训练,泛化能力受限。

2023年,Meta AI推出了Segment Anything Model(SAM),首次实现了真正意义上的"通用分割"能力。SAM通过提示驱动的交互方式,能够在零样本条件下对任意对象进行分割,彻底改变了分割任务的范式。随后发布的SAM 2将这一能力扩展到视频领域,引入了跨帧追踪机制。而2025年发布的SAM 3则进一步突破,引入了"可提示概念分割"(Promptable Concept Segmentation, PCS)这一全新任务定义,使模型能够理解自然语言描述的抽象概念,并在图像和视频中定位所有符合该概念的实例。

本文将深入剖析SAM 3的技术架构与实现细节,结合实际代码示例,帮助读者全面理解这一前沿技术,并掌握其在图像分割、视频追踪以及三维重建等场景中的应用方法。

镜像使用指南

1.创建实例

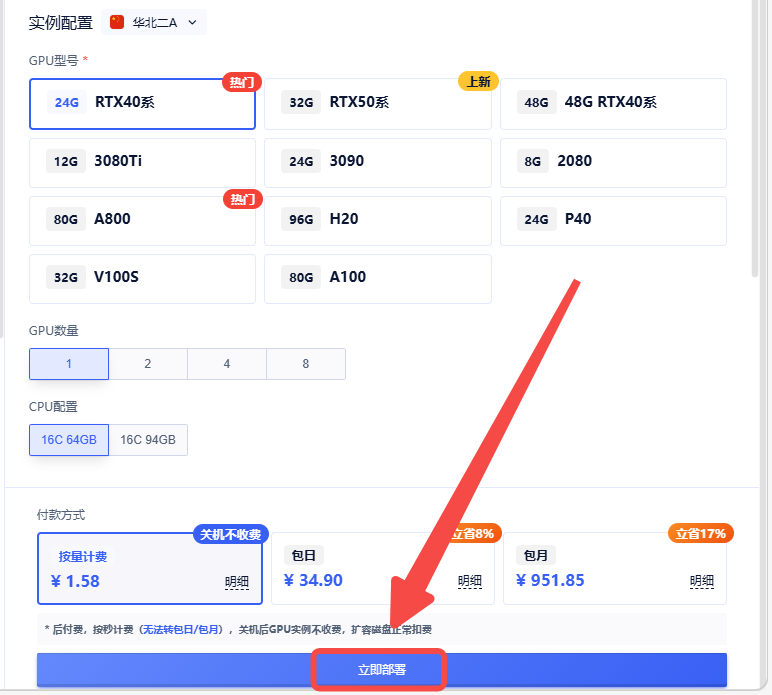

2.选择合适的机型,立即部署

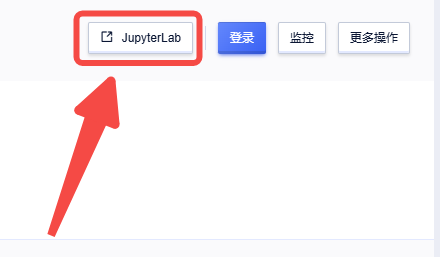

3.返回实例页面,点击【JupyterLab】

下面是一些常见的案例,全部案例放在csdn 中,你可以先从下面这些来完成学习验证

python 基础图像分割.py

python 交互式分割.py

python 结果可视化.py

python 视频分割.py

python 验证安装.py

python 自动标注流程.py

@敢敢のwings 认证作者

认证作者

认证作者

认证作者

镜像信息

已使用18 次

运行时长

19 H

镜像大小

100GB

最后更新时间

2026-01-29

支持卡型

RTX40系

+1

框架版本

CUDA版本

CUDA12.8

应用

JupyterLab: 8888

版本

v1.0

2026-01-29