大模型微调部署测评_LLaMa-Factory>vLLM>opencompass

大模型微调部署测评全流程环境已安装

1

10元/小时

v1.3

大模型微调部署测评_LLaMa-Factory>vLLM>opencompass

镜像简介

- LLaMa-Factory: 预装

llamafactory==0.9.5.dev0用于大模型微调和量化,使用source /mnt/LLaMA-Factory_learn/.venv/bin/activate启动 - vLLM: 预装

vllm==0.16.0用于模型服务部署,使用source /mnt/vLLM_learn/.venv/bin/activate启动 - OpenCompass: 预装

opencompass==0.5.1用于大模型测评,使用source /mnt/opencompass_learn/.venv/bin/activate启动

环境与依赖

本镜像构建和运行所需的基础环境。

- 框架及版本: PyTorch 2.9.1+cu126

- CUDA版本: CUDA 12.6

- 其他依赖: Python 3.12,uv

配置方法

环境基于官方项目源码进行安装,项目均处于/mnt文件夹下,可参照官方或第三方教程直接启动对应的功能;opencompass建议使用命令行的方式运行。

环境验证代码

请先进入各环境,建议准备好模型文件(国内网络建议一并完成网络配置)。

LLaMA-Factory

- 修改文件

/mnt/LLaMA-Factory_learn/examples/train_lora/qwen2.5_lora_sft.yaml内的模型路径,或改为模型名称以联网下载; - 使用命令

time llamafactory-cli train examples/train_lora/qwen2.5_lora_sft.yaml启动LoRA微调.

vLLM

- 使用命令

vllm serve \

Qwen/Qwen2.5-1.5B-Instruct \

--dtype=half \

--trust-remote-code \

--enforce-eager \

--no-enable-chunked-prefill

启动vLLM服务,模型名称可更换为已下载的模型地址;

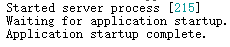

- 等待模型启动完成(日志出现下图字样)

- 使用命令

curl http://0.0.0.0:8000/v1/completions \

-H "Content-Type: application/json" \

-d '{

"prompt": "San Francisco is a",

"max_tokens": 7,

"temperature": 0

}'

进行模型调用测试。

OpenCompass

- 请先使用vLLM或外部方式,启动一个模型服务;

- 进入项目目录

cd /mnt/opencompass_learn/; - 根据需要,修改

/mnt/opencompass_learn/opencompass/configs/models/eval_api_demo_2.py文件的 models > dict 内参数,特别注意path、openai_api_base、tokenizer_path参数; - 使用命令

time python opencompass/run.py --datasets cmmlu_gen --models eval_api_demo_2 --work-dir eval_results --debug

启动测评

相关链接

- 项目源码: LLaMA-Factory、vLLM、opencompass

- 框架文档: Pytorch Docs、LLaMA-Factory Docs、vLLM Docs 、OpenCompass Docs

常见问题

Q1: 部分项目的fast_start笔记内出现“P40”字样,该镜像是否支持P40等显卡?

A1: 该镜像安装的vllm、llama-factory环境不支持P40等CUDA capability过低的显卡。

Q2: 发现部分环境内transformers库版本旧,是否可以升级?

A2: 环境内transformers版本经过测试不建议更换,较新或较旧版本都可能导致Qwen等模型无法使用。

@影赤

镜像信息

已使用21 次

运行时长

120 H

镜像大小

40GB

最后更新时间

2026-03-10

支持卡型

3080TiRTX40系RTX50系48G RTX40系2080Ti30902080A100A800H20

+10

框架版本

CUDA版本

12.6

应用

JupyterLab: 8888

版本

v1.3

2026-03-10