3

3egox将任意视频一键转第一人称视角视频

镜像简介

本镜像基于wan2.1模型与EgoX开源项目,实现将任意视频一键转换为沉浸式第一人称视角。通过优化的WebUI界面,用户可便捷上传并处理视频,快速生成以主观视角呈现的动态内容。适用于游戏录制、VR体验模拟、教育培训视频及创意短片制作等场景,提供简单高效的视角转换解决方案。

镜像使用指南

1、在社区镜像区域,选择镜像:

2、在打开的新页面 点击“使用该镜像创建实例”:

2、在打开的新页面 点击“使用该镜像创建实例”:

3、选择一个合适的显卡【GPU】根据情况选择,点击“开始部署”,然后等待部署完成:

3、选择一个合适的显卡【GPU】根据情况选择,点击“开始部署”,然后等待部署完成:

4、实例运行后打开SD-WebUI即可

webUI运行使用界面

EgoX WebUI 用户使用手册

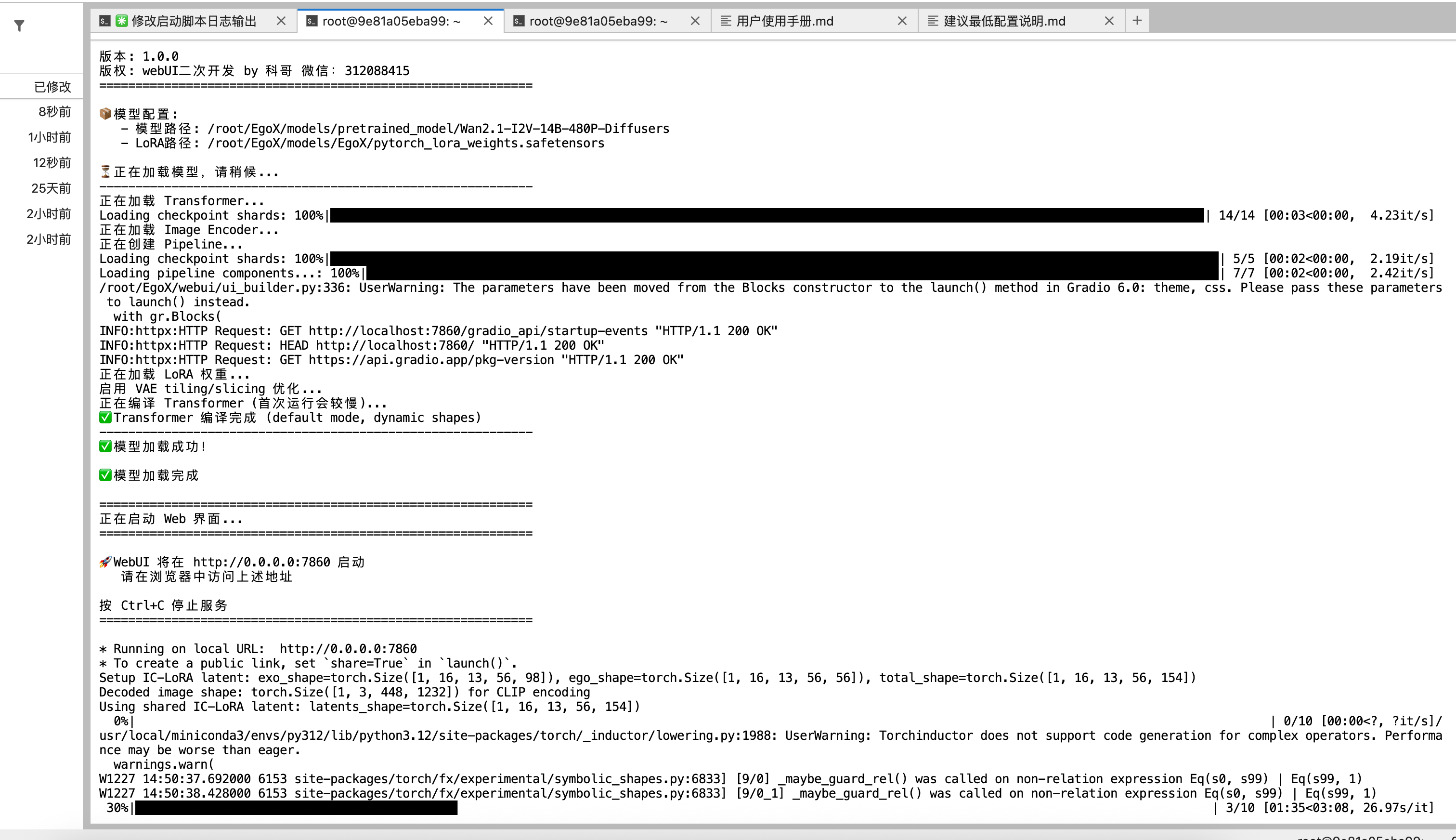

版本: 1.0.0 更新日期: 2025-12-27 版权: webUI二次开发 by 科哥 微信:312088415

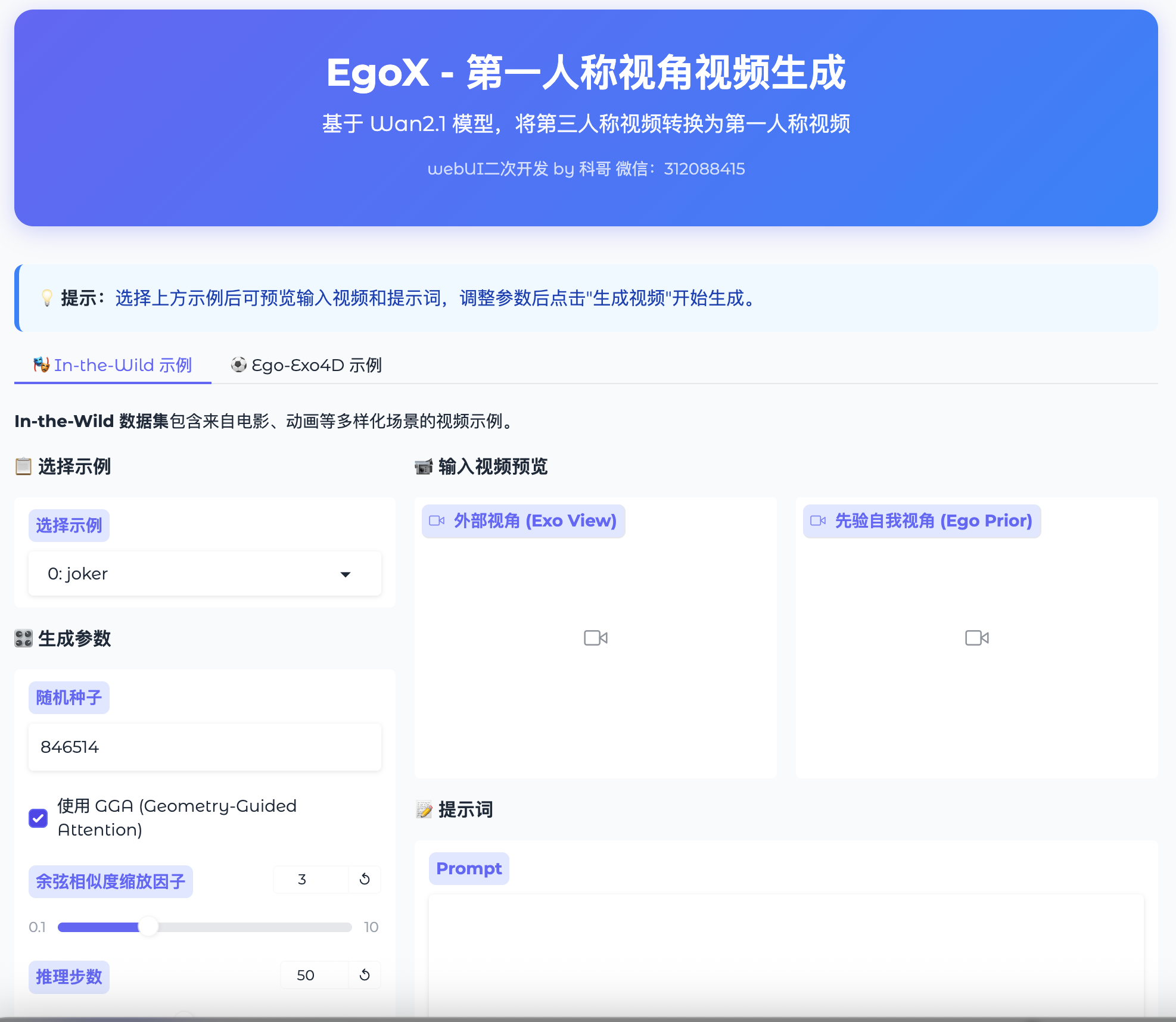

一、界面概览

EgoX WebUI 提供了一个简洁易用的中文界面,用于将第三人称(外部视角)视频转换为第一人称(自我视角)视频。

界面布局

┌─────────────────────────────────────────────────────────────┐

│ EgoX - 第一人称视角视频生成 │

│ 基于 Wan2.1 模型,将第三人称视频转换为第一人称视频 │

│ webUI二次开发 by 科哥 微信:312088415 │

└─────────────────────────────────────────────────────────────┘

┌─────────────────────────────────────────────────────────────┐

│ 💡 提示:选择上方示例后可预览输入视频和提示词... │

└─────────────────────────────────────────────────────────────┘

┌─────────────────────────────────────────────────────────────┐

│ [ 🎭 In-the-Wild 示例 ] [ ⚽ Ego-Exo4D 示例 ] │

├─────────────────────────────────────────────────────────────┤

│ │

│ 📋 选择示例 │ 📹 输入视频预览 │

│ ┌─────────────────┐ │ ┌─────────────┬─────────────┐ │

│ │ [下拉选择框] │ │ │ 外部视角 │ 先验自我视角 │ │

│ └─────────────────┘ │ └─────────────┴─────────────┘ │

│ │ 📝 提示词 │

│ 🎛️ 生成参数 │ ┌─────────────────────────────┐ │

│ ┌─────────────────┐ │ │ [详细提示文本内容...] │ │

│ │ 随机种子 │ │ └─────────────────────────────┘ │

│ │ GGA (几何引导) │ │ │

│ │ 余弦相似度 │ │ │

│ │ 推理步数 │ │ │

│ │ 引导强度 │ │ │

│ └─────────────────┘ │ │

│ [ 🎬 生成视频 ] │ │

│ │ │

├─────────────────────────────────────────────────────────────┤

│ 🎞️ 生成结果 │

│ ┌─────────────────────────────────────────────────────┐ │

│ │ │ │

│ │ [生成的视频播放器] │ │

│ │ │ │

│ └─────────────────────────────────────────────────────┘ │

│ 状态信息: ✅ 视频生成成功! │

└─────────────────────────────────────────────────────────────┘

二、数据集说明

2.1 In-the-Wild 示例

数据集介绍: 包含来自电影、动画等多样化场景的视频示例。

适用场景:

- 创意视频制作

- 视角转换演示

- 风格化视频生成

2.2 Ego-Exo4D 示例

数据集介绍: 包含来自 Ego-Exo4D 数据集的真实活动视频,如足球、篮球、烹饪、舞蹈等。

适用场景:

- 体育视频分析

- 活动记录研究

- 第一人称视角生成

三、使用步骤

3.1 选择示例

- 在顶部 Tab 栏选择数据集类型(In-the-Wild 或 Ego-Exo4D)

- 点击"选择示例"下拉框

- 选择一个示例(格式:

索引: 示例名称)

自动加载内容:

- 外部视角视频预览

- 先验自我视角视频预览

- 对应的提示词文本

3.2 调整参数

随机种子 (Seed)

- 作用: 控制生成的随机性

- 说明: 相同种子会产生相同结果

- 默认值:

- In-the-Wild: 846514

- Ego-Exo4D: 42

- 建议: 保持默认值或随机修改

GGA (Geometry-Guided Attention)

- 作用: 利用几何信息引导视角转换

- 类型: 勾选框

- 默认值: ✓ 启用

- 建议: 保持启用状态以获得更好的视角转换效果

余弦相似度缩放因子

- 作用: 控制 GGA 注意力的强度

- 范围: 0.1 - 10.0

- 默认值: 3.0

- 建议:

- 较小值 (1.0-2.0): 几何约束较弱

- 默认值 (3.0): 平衡效果

- 较大值 (5.0-10.0): 几何约束较强

推理步数

- 作用: 扩散模型的去噪步数

- 范围: 10 - 100

- 默认值: 50

- 说明: 步数越多质量越好但越慢

- 建议:

- 快速预览: 20-30 步

- 标准质量: 50 步(推荐)

- 高质量: 70-100 步

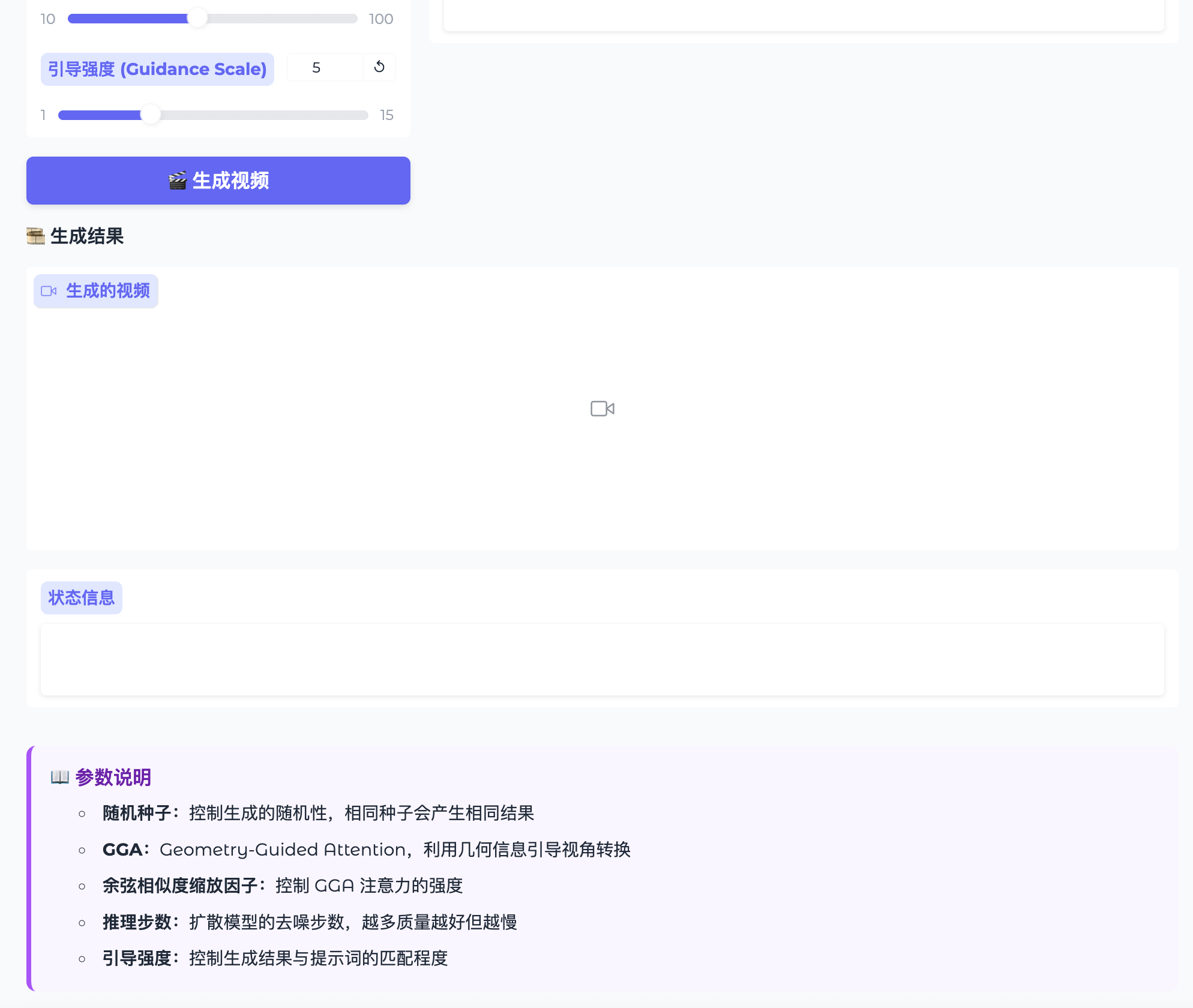

引导强度 (Guidance Scale)

- 作用: 控制生成结果与提示词的匹配程度

- 范围: 1.0 - 15.0

- 默认值: 5.0

- 建议:

- 较小值 (1.0-3.0): 创造性更强

- 默认值 (5.0): 平衡效果(推荐)

- 较大值 (7.0-15.0): 更严格遵循提示词

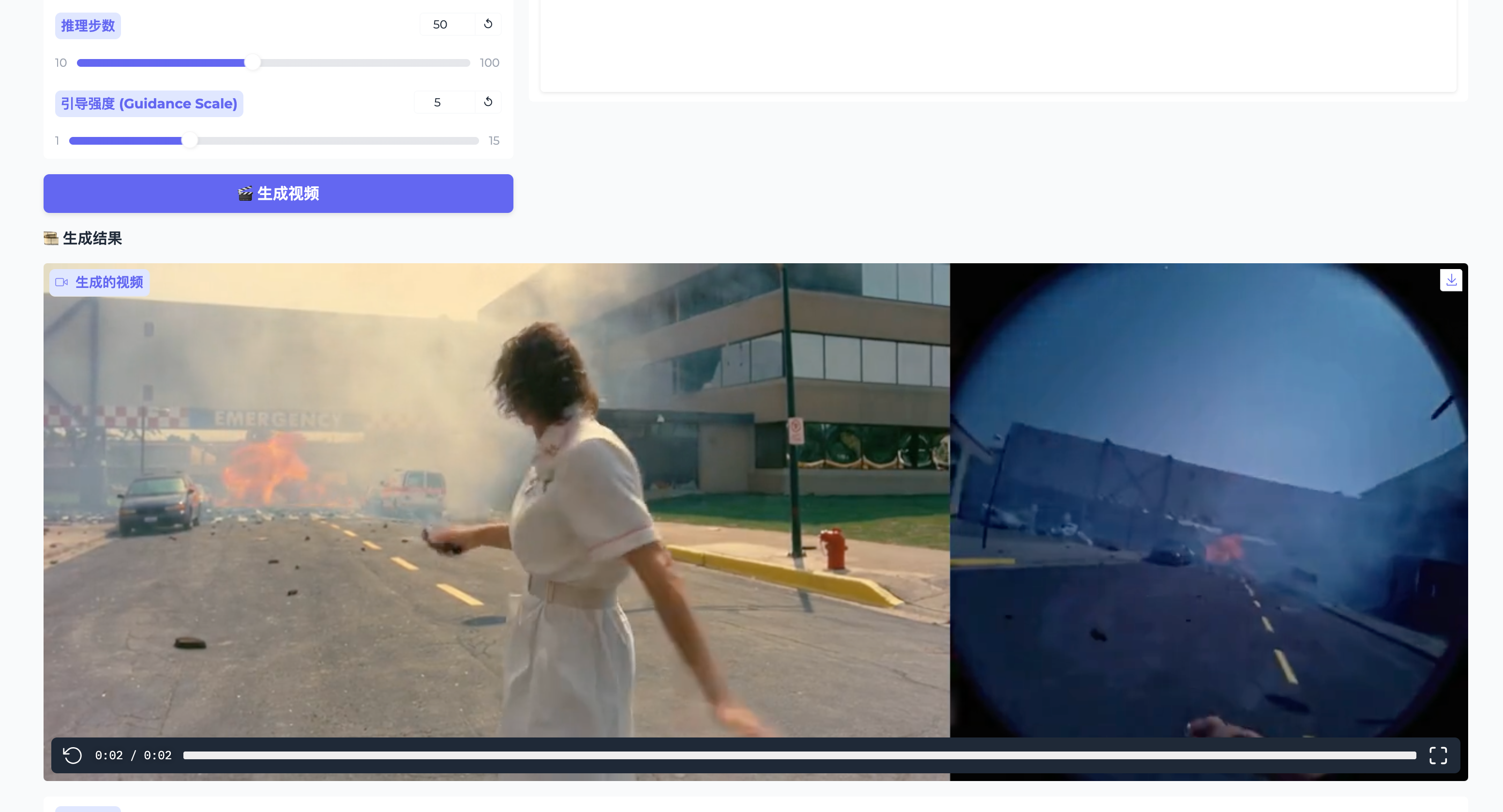

3.3 生成视频

- 确认选择的示例和参数设置

- 点击 "🎬 生成视频" 按钮

- 等待生成完成(约 5-10 分钟)

- 在"生成结果"区域查看输出视频

生成时间说明:

- GPU: NVIDIA A100 / H100

- 预计时间: 5-10 分钟

- 生成期间请勿关闭浏览器

3.4 查看结果

生成完成后:

- 视频会自动显示在"生成结果"区域

- 状态信息会显示生成结果和保存路径

- 点击视频播放器可查看生成的视频

四、参数调优指南

4.1 快速预览模式

推理步数: 25

引导强度: 3.0

余弦相似度: 2.0

适用场景: 快速查看效果,节省时间

4.2 标准质量模式(推荐)

推理步数: 50

引导强度: 5.0

余弦相似度: 3.0

适用场景: 日常使用,平衡质量和速度

4.3 高质量模式

推理步数: 80-100

引导强度: 7.0

余弦相似度: 5.0

适用场景: 需要最佳质量,不介意较长等待时间

五、使用技巧

5.1 如何获得更好的效果

- 选择合适的示例:选择与你目标场景相似的示例

- 启用 GGA:确保 GGA 选项已勾选

- 调整余弦相似度:根据需要调整几何引导强度

- 耐心等待:高质量视频需要足够的推理步数

5.2 常见使用场景

场景 1: 创意视频制作

- 选择 In-the-Wild 数据集

- 使用较高引导强度 (7.0)

- 推理步数 50+

场景 2: 体育活动分析

- 选择 Ego-Exo4D 数据集

- 使用标准参数设置

- 启用 GGA 获得更好的视角一致性

场景 3: 快速效果验证

- 降低推理步数到 25-30

- 保持其他参数为默认值

- 快速迭代查看效果

5.3 提示词说明

提示词包含两个部分:

[Exo view] - 外部视角描述:

- 场景概述

- 环境细节

- 动作描述

[Ego view] - 自我视角描述:

- 推断的第一人称视角

- 环境感知

- 交互细节

六、注意事项

6.1 使用限制

- 固定相机姿态: EgoX 训练时使用固定相机姿态,输入视频需要符合此条件

- 分辨率要求:

- 自我视角: 448x448

- 外部视角: 448x784

- 帧数: 49 帧

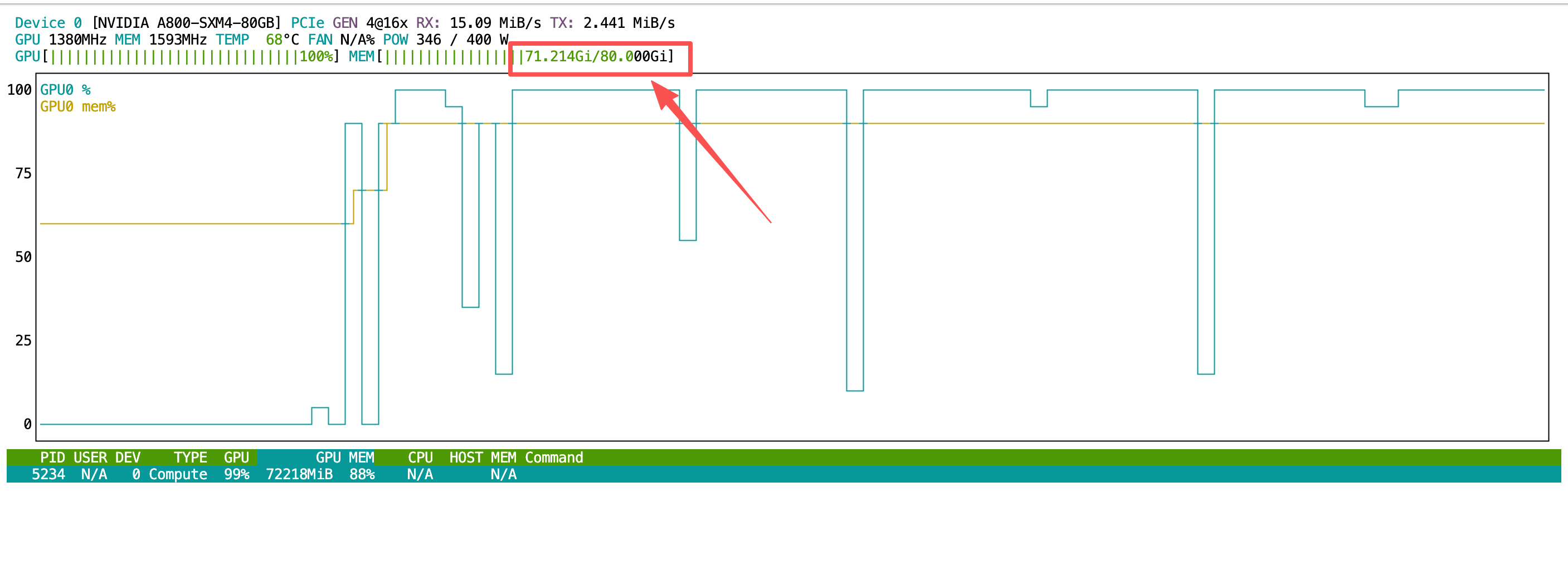

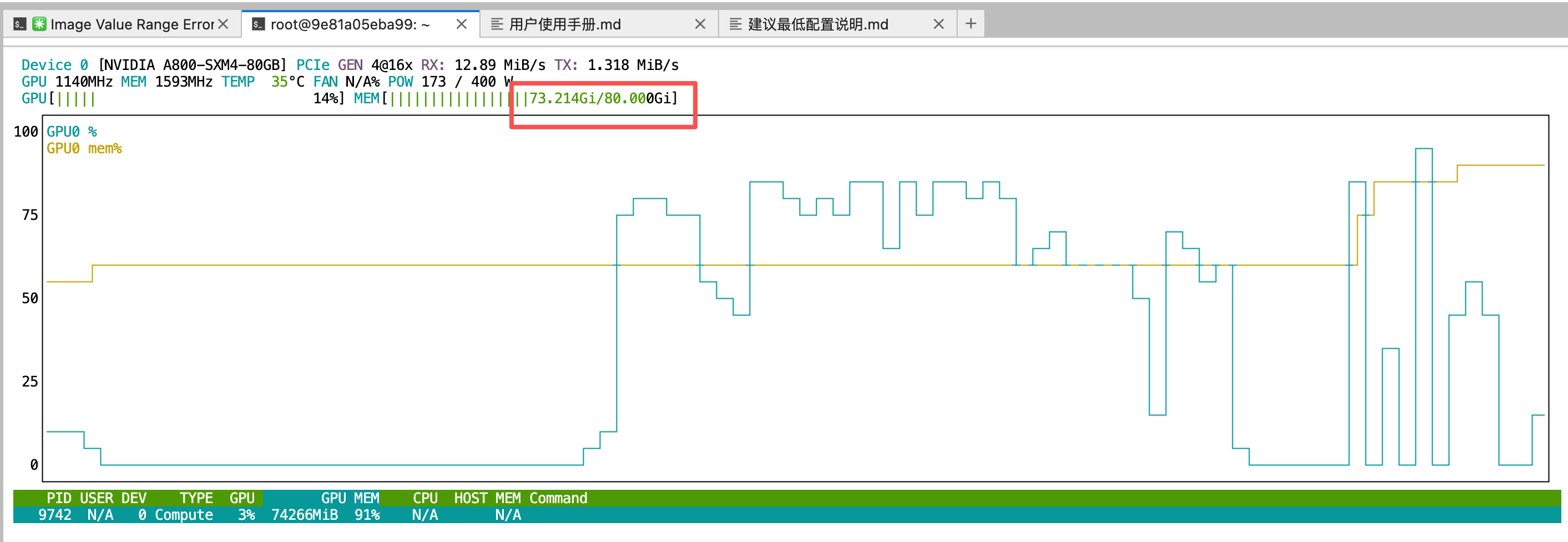

- GPU 需求: 建议使用 80GB 显存的 GPU

6.2 性能提示

- 首次生成可能较慢(模型加载)

- 生成期间避免同时运行其他 GPU 任务

- 关闭不必要的浏览器标签可释放内存

6.3 结果保存

- 生成的视频自动保存到

./results/gradio_outputs/目录 - 文件命名格式:

{示例名称}_{数据集类型}_{随机种子}.mp4 - 状态信息中会显示完整的保存路径

七、常见问题

Q1: 生成失败怎么办?

A: 检查以下几点:

- 模型是否正确加载(查看启动日志)

- 示例文件是否完整

- GPU 内存是否充足

Q2: 如何保存生成的视频?

A: 视频已自动保存到 ./results/gradio_outputs/ 目录,状态信息中会显示完整路径。

Q3: 可以生成多长时间的视频?

A: 当前模型固定生成 49 帧视频(约 1.6 秒 @ 30fps),这是模型的训练配置。

Q4: 生成的视频质量不满意?

A: 尝试以下方法:

- 增加推理步数到 70-100

- 调整余弦相似度缩放因子

- 选择更相似的示例数据

Q5: 如何使用自己的数据?

A: 请参考项目 README.md 中的数据准备指南,需要准备:

- 外部视角视频

- 自我视角先验视频

- 深度图

- 相机参数

- 元数据文件 (meta.json)

八、快捷操作

键盘快捷键

| 操作 | 快捷键 |

|---|---|

| 刷新页面 | Ctrl + R / F5 |

| 下载视频 | 右键视频 → 另存为 |

浏览器兼容性

| 浏览器 | 版本要求 | 支持状态 |

|---|---|---|

| Chrome | 90+ | ✅ 完全支持 |

| Firefox | 88+ | ✅ 完全支持 |

| Safari | 14+ | ✅ 完全支持 |

| Edge | 90+ | ✅ 完全支持 |

九、联系我们

开发: 科哥 微信: 312088415 项目: EgoX - 第一人称视角视频生成

技术支持:

- GitHub Issues: [项目地址]

- 论文引用: 见 README.md

文档最后更新: 2025-12-27

bug反馈可以加入科哥专属群交流➕ 广告勿进!

---

---

认证作者

认证作者

支持自启动

支持自启动