使用LangBot快速部署QQ、微信、飞书、钉钉机器人

LangBot 是一个开源的大语言模型(LLM)原生即时通信机器人平台,支持多种消息平台和模型供应商。并提供 WebUI 供用户快速部署和使用。支持QQ 、QQ频道、Discord、 WeChat、企业微信(个人微信)、 Telegram 、飞书、钉钉等。

使用 LangBot + Ollama 镜像

-

进入镜像地址 (opens in a new tab) ,选择最新版本。

-

点击“使用该镜像创建实例”后,在新页面根据自身需求选择GPU型号(教程使用3080TI 12g)和实例配置等。然后点击”立即部署”,之后等待实例状态变成”运行中”。

-

之后即可在浏览器访问

http://<实例外网ip>:5300进入 LangBot 管理后台,按照提示注册登录。

该镜像中,已配置好 Ollama + DeepSeek R1 14b 模型,并已添加到了 LangBot 模型设置,可直接使用。

WebChat 调试

不需要配置即时通信机器人即可调试,到流水线配置页,点击唯一的流水线,即可在页面上对话调试。

更换模型

使用 Ollama 拉取新模型

-

使用实例控制台中提供的"登录"功能,密码在"实例列表"中的"SSH登录"有显示。

-

使用命令

ollama pull 模型名称,拉取模型;例如:ollama pull deepseek-r1:32b拉取 DeepSeek R1 32b 模型,更多模型列表可在 https://ollama.com/library (opens in a new tab) 查看。 -

前往langbot的web 后台中的模型配置,并点击“+”号添加,在“供应商”下方的下拉菜单中,选择“Ollama”。“模型名称”处填写你刚刚下载运行完成的模型名称。

填写完成并保存后即可前往所用流水线中更改“AI能力”使用的模型

使用优云智算提供的模型API

-

前往新建apikey https://console.compshare.cn/light-gpu/api-keys (opens in a new tab)

-

创建并复制之后,前往 LangBot “模型”页面,添加模型,模型提供商使用优云智算,并在apikey处填写复制的apikey。可用模型名称可以前往 https://console.compshare.cn/light-gpu/model-center (opens in a new tab) 查看

填写完成并保存后即可前往所用流水线中更改“AI能力”使用的模型

接入即时通信机器人

本教程中以飞书机器人为例,更多平台(QQ、微信、Discord、飞书等)请根据文档配置 (opens in a new tab)。

创建机器人

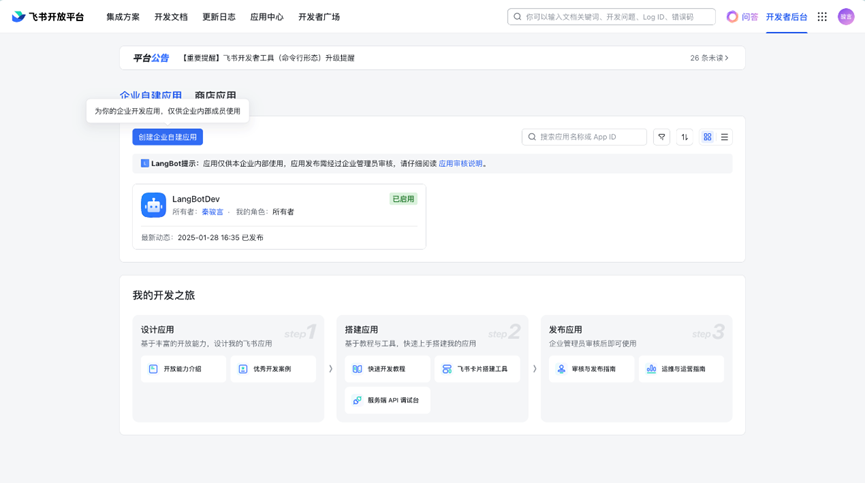

前往飞书开放平台 (opens in a new tab),登录后,创建企业自建应用。

(应用名称和应用描述根据自己实际填写)

为应用添加机器人能力,点击“机器人”下方的添加:

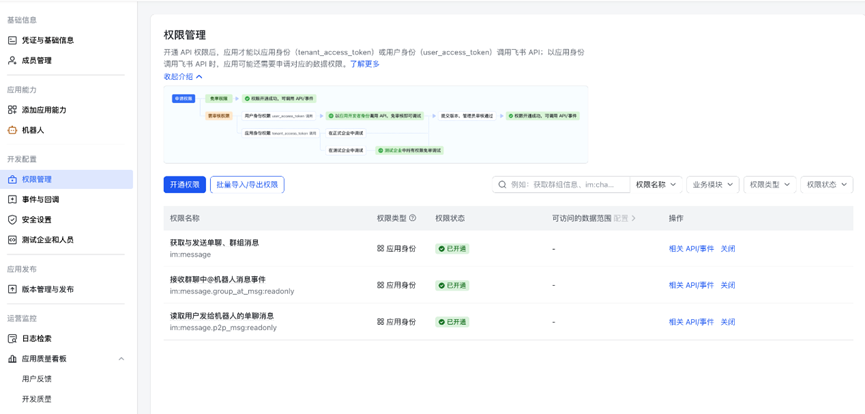

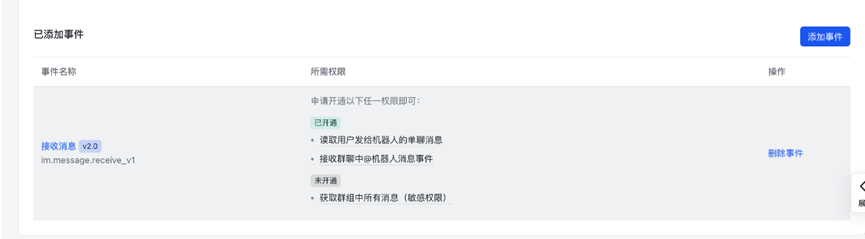

在权限管理中添加图中所示权限:

在权限管理中添加图中所示权限:

权限名称分别是:

权限名称分别是:

- 获取与发送单聊、群组消息

- 接收群聊中@机器人消息事件

- 读取用户发给机器人的单聊消息

对接 LangBot

在凭证与基础信息页找到 app_id 和 app_secret 并记录

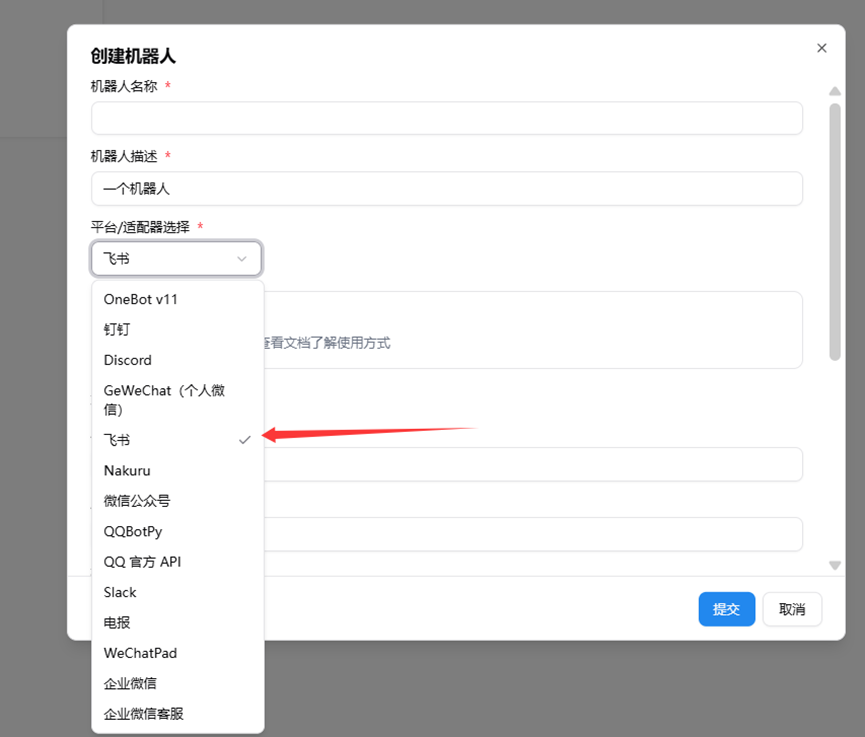

打开LangBot 的 Webui 配置页面,接入“机器人”界面后,点击“+”号,“平台/适配器选择”选择“飞书”

填写完成并点击“提交”,然后在“编辑机器人”窗口将“是否启用”打开,并点击“保存”来保存。

配置事件订阅

前往事件与回调页,配置订阅方式为长连接:

并添加事件:接收消息

并添加事件:接收消息

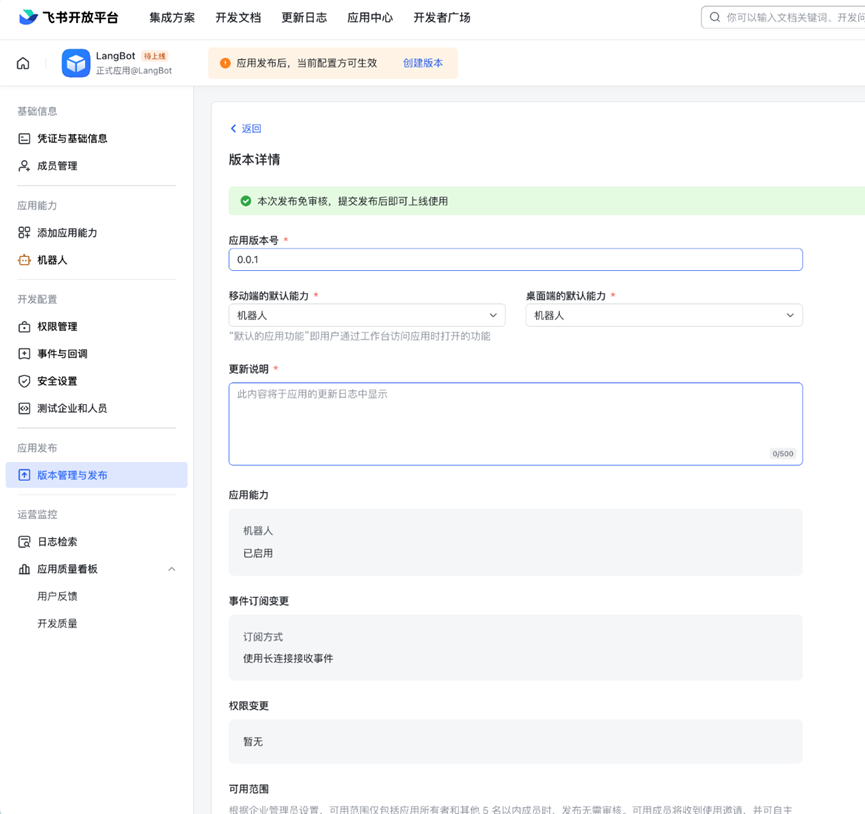

发布机器人

点击顶部创建版本,填写版本号等信息,点击下方保存。

发布机器人

点击顶部创建版本,填写版本号等信息,点击下方保存。

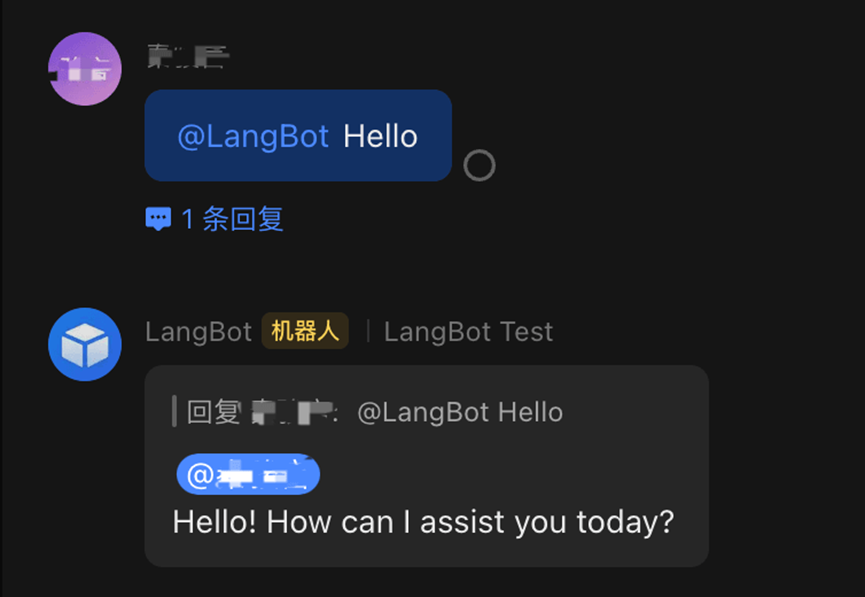

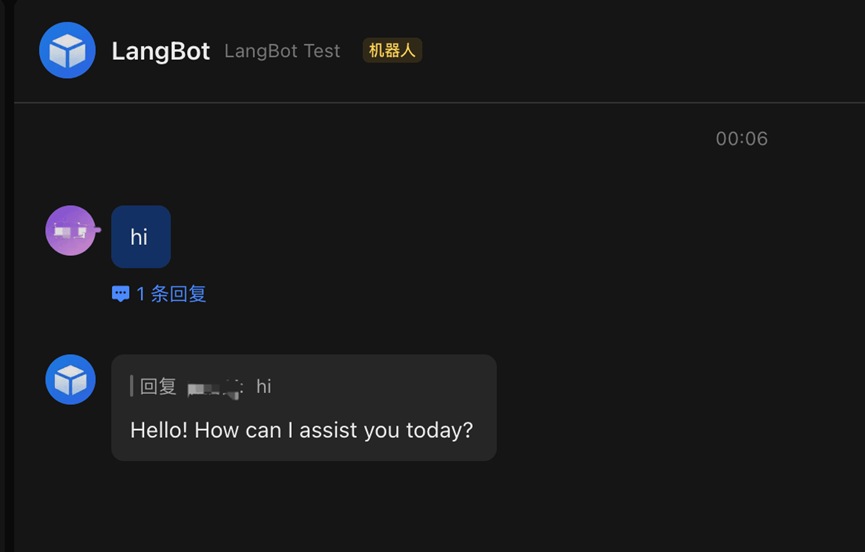

在飞书群中添加机器人,即可使用:

在飞书群中添加机器人,即可使用:

私聊也可以直接使用

私聊也可以直接使用